par Petank SORO | Avr 1, 2026 | Zoom Sur

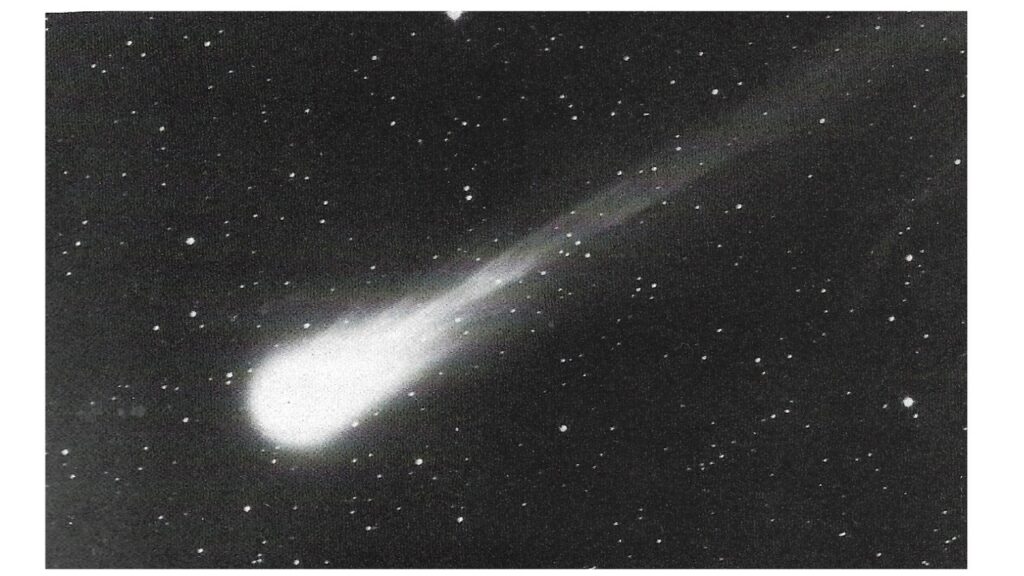

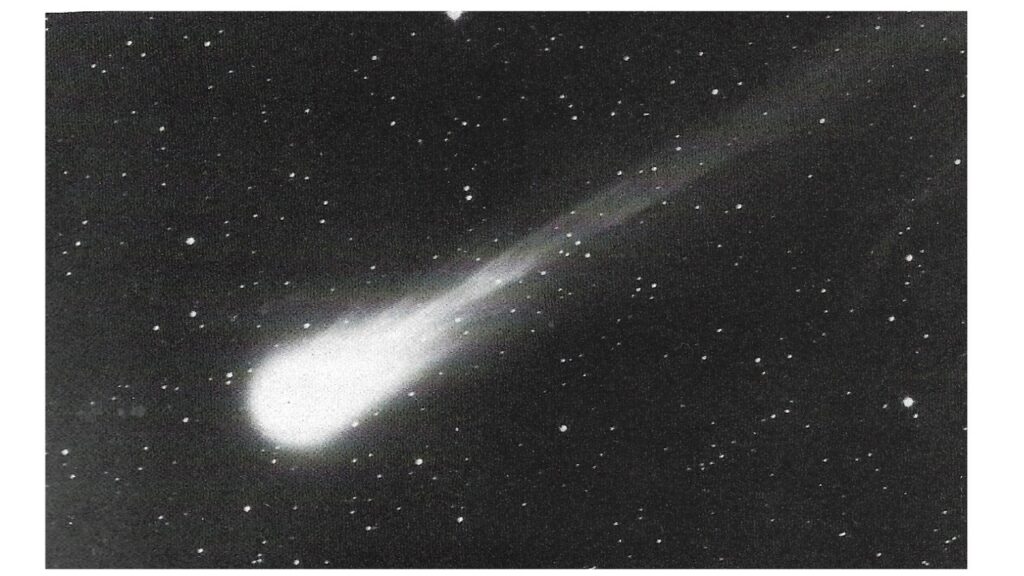

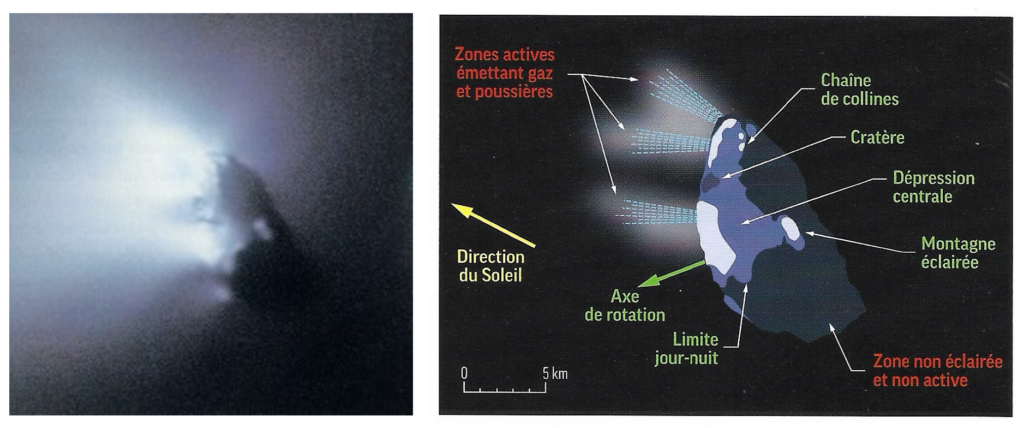

Fig 1. La comète de Halley, photographiée le 8 mai 1986 par W. Liller, île de Pâques, Large Scale Phenomena Network, IHW. (Crédit : NASA/NSSDC)

L’année 1986 a été marquée par l’apparition de la célèbre comète de Halley, connue depuis l’Antiquité, qui vient nous visiter tous les 76 ans. Lors de son passage au périhélie, le 11 février 1986, elle se trouvait malheureusement derrière le Soleil, et le spectacle a été décevant pour les observateurs terrestres. En revanche, la moisson scientifique a été exceptionnelle, grâce en particulier aux cinq sondes spatiales qui l’ont approchée.

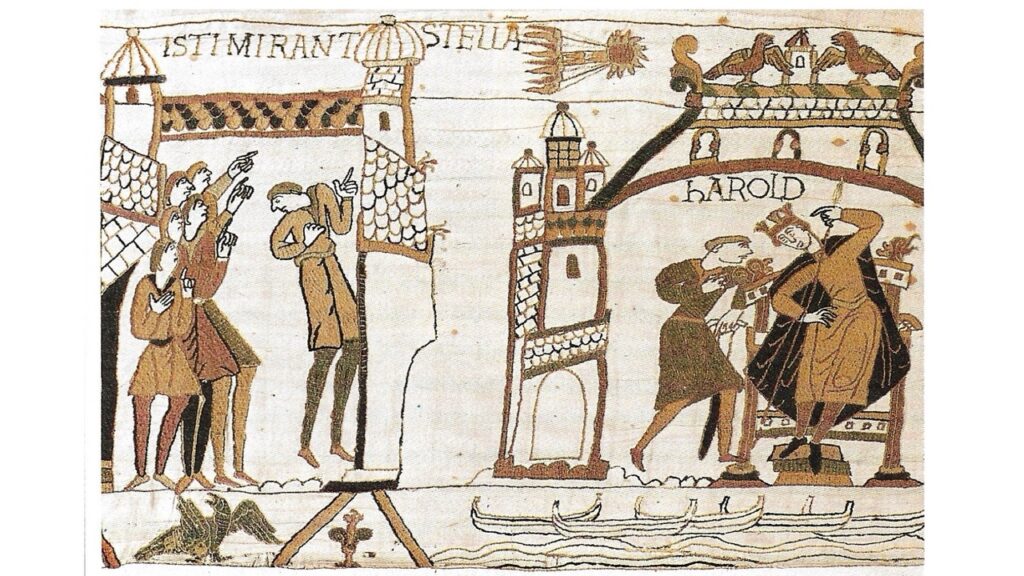

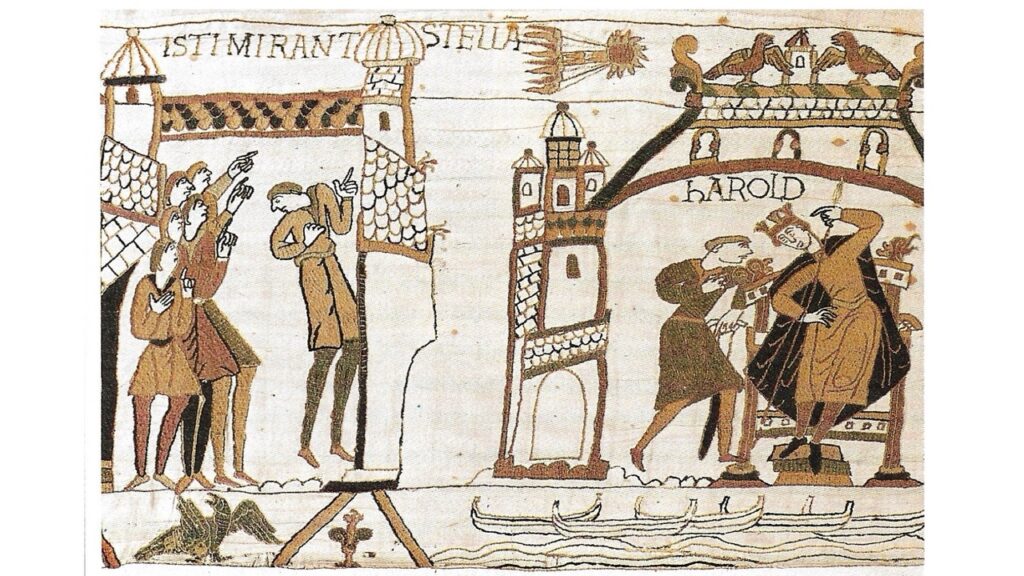

Aucune comète n’est aussi connue que la comète de Halley (1P/Halley, fig. 1). Elle doit sa célébrité à la sagacité de l’astronome anglais Edmond Halley qui, au début du xviiie siècle, a compris que les comètes brillantes apparues en 1305, 1380, 1456, 1531, 1607 et 1682 n’étaient en fait qu’un seul et même objet dont la période était de 76 ans. Il prédit avec succès pour 1759 le retour de la comète qui porte désormais son nom. Ensuite, on a retrouvé la trace de l’objet dans des archives plus anciennes, notamment en 1066 sur la tapisserie de Bayeux (fig. 2) et en 1301 sur la fresque peinte par Giotto à la chapelle des Scrovegni de Padoue. Les apparitions ultérieures de 1835 et de 1910 furent l’objet de toutes les attentions. En particulier, la configuration géométrique de 1910 était particulièrement favorable, la comète passant de nuit près de la Terre, ce qui a gratifié les astronomes d’images spectaculaires (fig. 3).

Fig 2. La comète de Halley, représentée sur la tapisserie de Bayeux. Elle est interprétée comme un mauvais présage par le roi Harold et son entourage (Harold sera tué peu après dans la bataille d’Hastings en 1066). (Crédit : Wikimedia Creative Commons/Myrabella)

Fig 3. La comète de Halley photographiée à l’observatoire du pic du Midi le 29 mai 1910. Elle était beaucoup plus brillante que lors de l’apparition de 1986. (Crédit : Observatoire de Bordeaux)

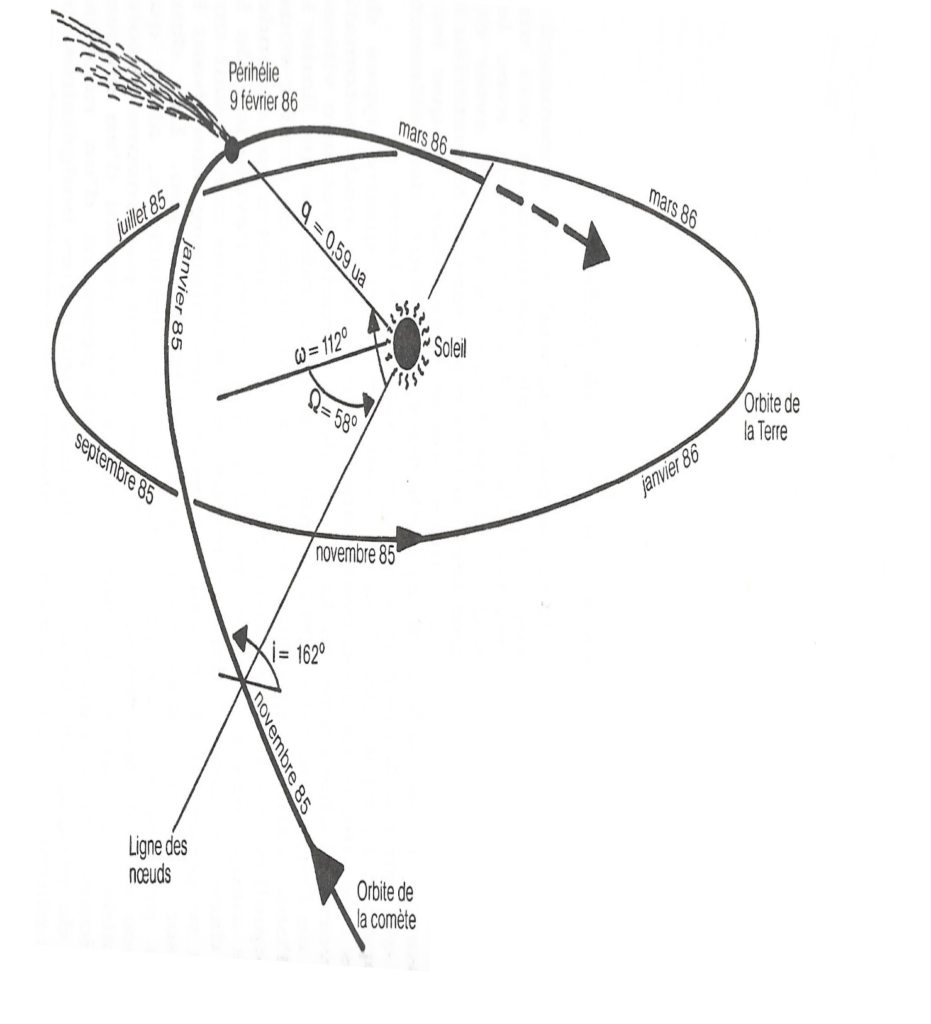

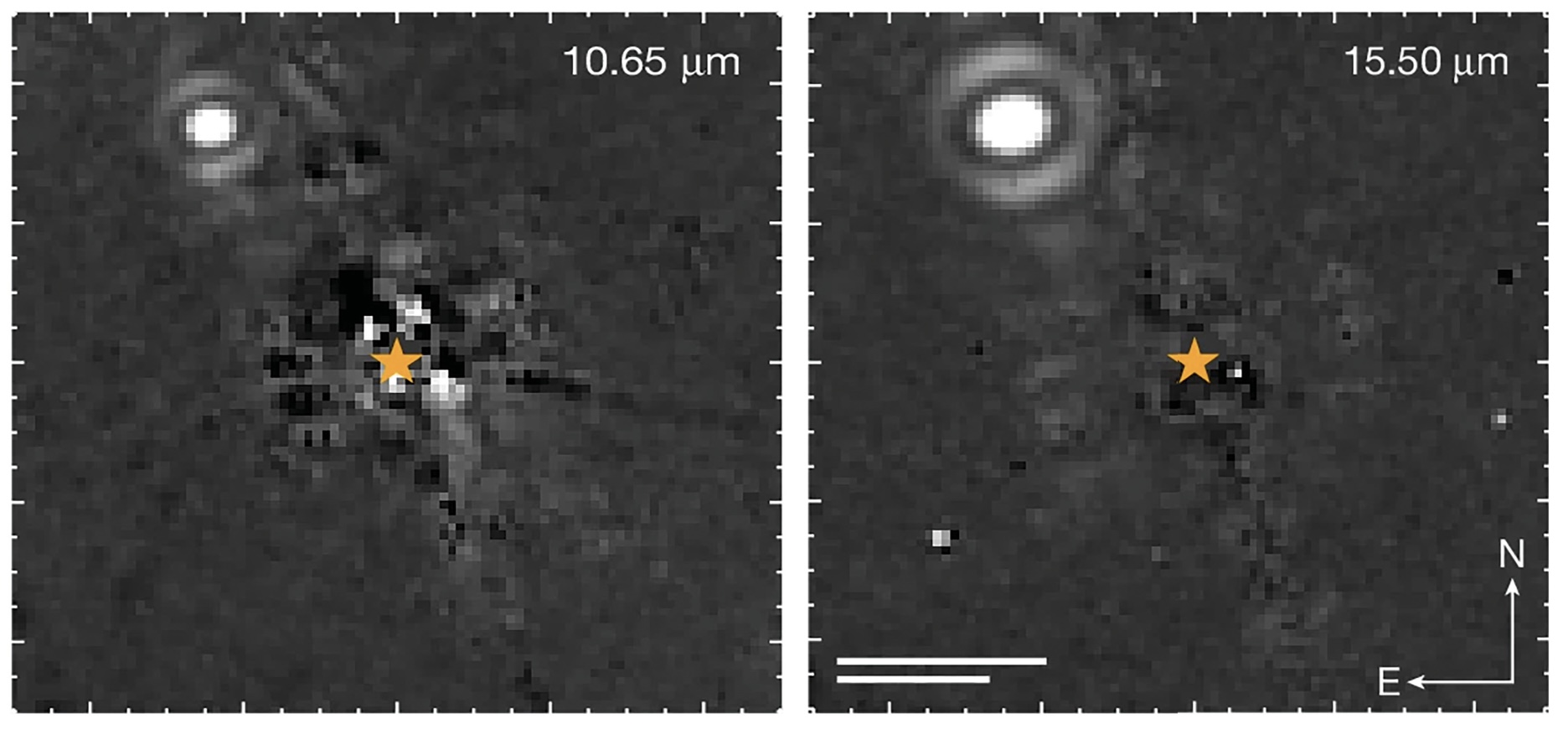

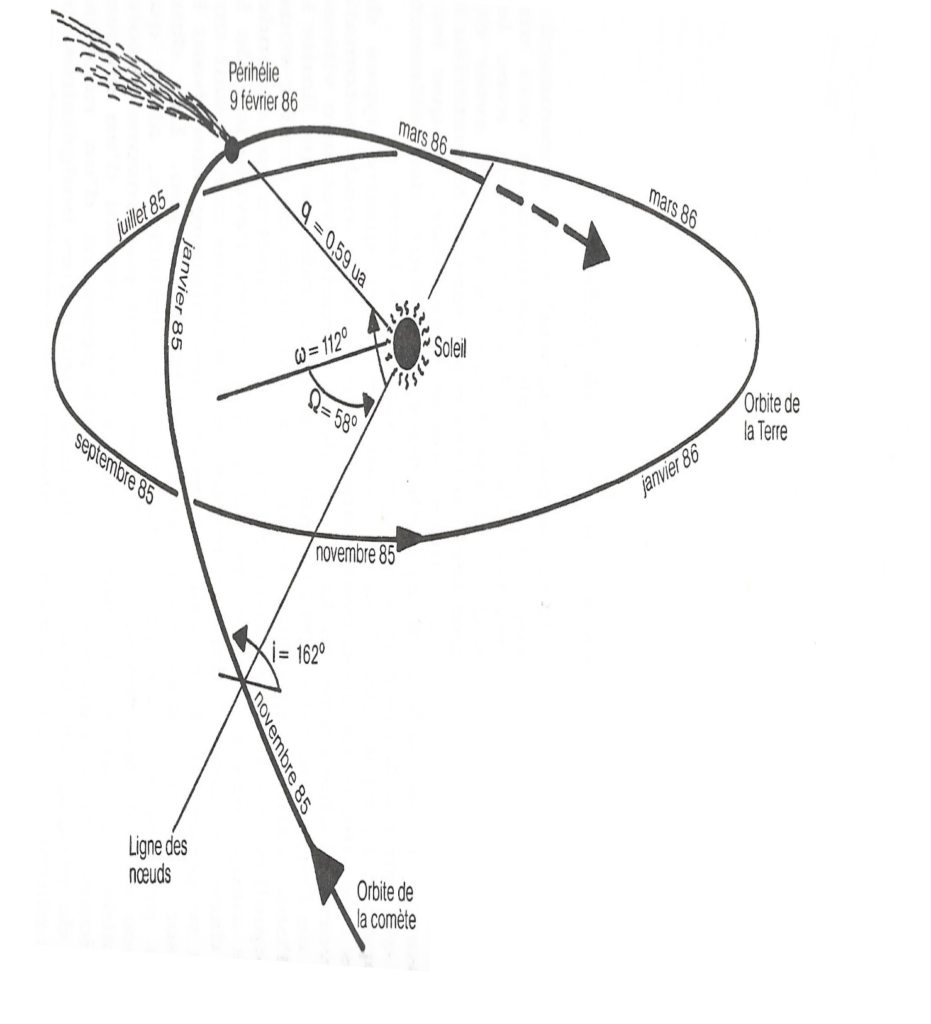

Les observateurs étaient donc mobilisés pour l’apparition de 1986. On savait que la géométrie ne favoriserait pas l’observation depuis la Terre (fig. 4) ; en revanche, on était entré dans l’ère de l’exploration spatiale. Dès 1974, les agences spatiales américaine et européenne ont commencé à étudier la possibilité d’envoyer un engin spatial à proximité de la comète. En effet, si le spectacle de celle-ci fascine le public, les scientifiques, quant à eux, veulent comprendre sa nature physique : les comètes sont les objets les plus primitifs du Système solaire car, du fait de leur petite taille, elles n’ont subi aucune modification depuis leur origine. La comète de Halley constitue la meilleure cible possible, et ce pour deux raisons : elle est brillante et sa trajectoire est parfaitement connue. Celle-ci présente toutefois un inconvénient : la comète se déplace dans le sens contraire de la révolution des planètes. Lors de la rencontre, les sondes croiseront donc la comète arrivant en sens inverse, ce qui limitera la durée d’observation. La rencontre aura lieu lorsque la comète traversera le plan de l’écliptique, celui de l’orbite terrestre.

Fig 4. La trajectoire de la comète de Halley en 1986. On voit qu’au moment de son périhélie (9 février 1986), elle est de l’autre côté du Soleil par rapport à la Terre. Les deux périodes les plus favorables pour l’observation au sol sont novembre 1985 et avril 1986. (Crédit : A.-C. Levasseur-Regourd et Ph. de la Cotardière, Halley, le roman des comètes, Denoël, 1986)

Les grandes manœuvres des agences spatiales

Du côté de la Nasa, le projet initial est très ambitieux : il vise à accompagner la comète sur son orbite, ce qui nécessite une source d’énergie indépendante des carburants traditionnels. Cependant, les développements nécessaires impliquent un gros budget que le Congrès américain refuse à la Nasa : après la réponse négative apportée en 1976 par la mission Viking à la question de l’existence de vie à la surface de Mars, l’enthousiasme pour la recherche spatiale est retombé et l’heure est à l’austérité. En 1979, la Nasa et l’Esa envisagent une mission commune visant à s’approcher de la comète de Halley pour rejoindre ensuite une autre comète périodique bien connue, 10P/Tempel 2. Mais là aussi, le projet échoue pour des raisons budgétaires, au grand dam des scientifiques américains et européens qui s’étaient investis dans la préparation des instruments.

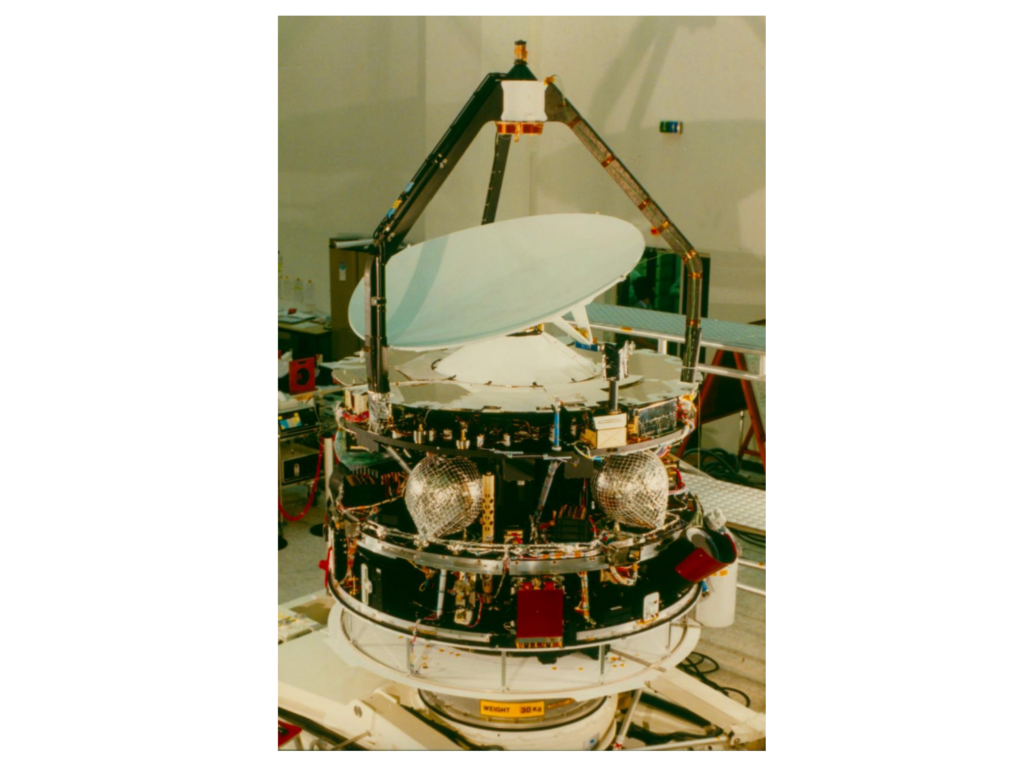

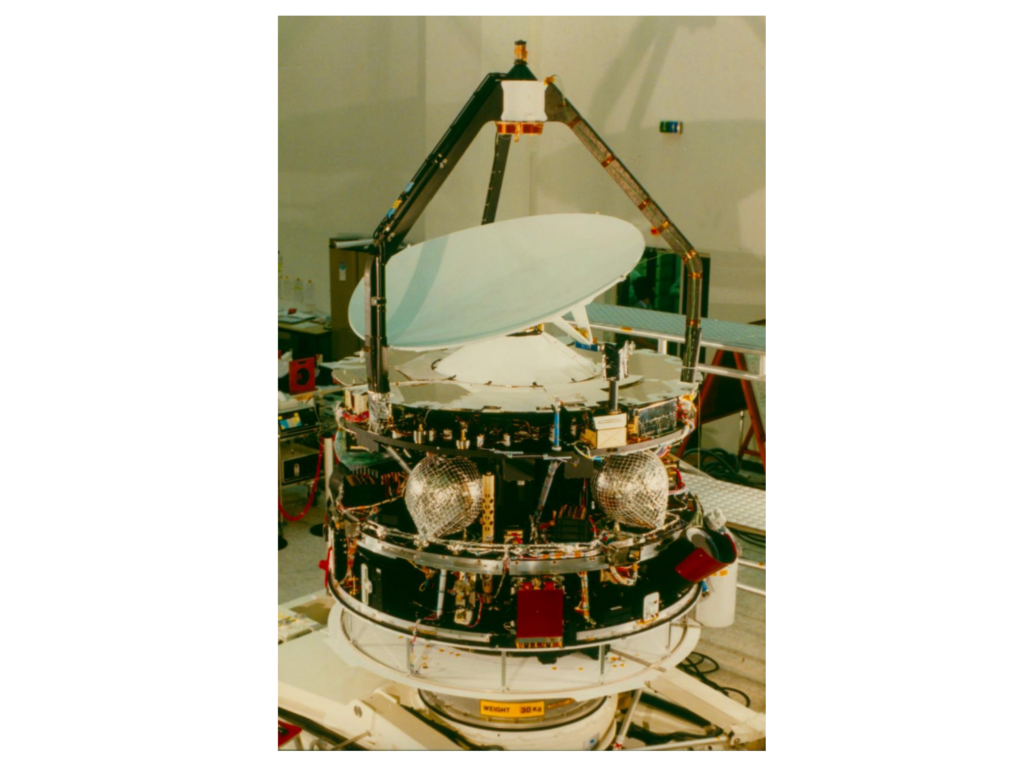

Les ingénieurs de l’Esa, toute jeune agence spatiale, créée en 1975, envisagent alors l’étude d’un projet indépendant et, du côté européen, l’Esa voit une occasion de lancer sa première mission vers le Système solaire : ce sera la mission Giotto qui s’approchera à moins de 1 000 km de la comète de Halley (fig. 5). Le projet est approuvé par les instances de l’Esa en juillet 1980. Il faut mettre les bouchées doubles, car le rendez-vous avec la comète ne peut être différé ! Au prix d’efforts acharnés, au sein de l’agence comme dans les laboratoires qui réalisent les instruments, le pari sera tenu et, le 2 juillet 1985, la mission Giotto sera lancée par une fusée Ariane depuis le centre spatial de Kourou, en Guyane.

Fig 5. La sonde Giotto. Le cylindre central, de 1,85 m de diamètre, est surmonté d’une antenne pour les télécommunications avec la Terre ; la hauteur de l’ensemble est de 2,85 m. Le cylindre est protégé par un double blindage pour assurer un maximum de protection contre les impacts cométaires. L’ensemble pèse 960 kg (ergol compris). (Crédit : ESA/Gerhardt Schwehm)

Troisième partenaire, l’Union soviétique va elle aussi se lancer dans l’aventure cométaire. Depuis les années 1960, la coopération spatiale franco-soviétique est très active, en particulier dans le cadre du programme Venera d’exploration de la planète Vénus. À la fin des années 1970, un nouveau projet est à l’étude, Venera-84, qui consiste à explorer l’atmosphère de Vénus au moyen d’un ballon. Ce projet est porté, côté français, par Jacques Blamont, alors directeur scientifique et technique du Cnes, l’agence française de l’espace. En septembre 1980, lors des journées franco-soviétiques qui se tiennent à Ajaccio, il est proposé d’utiliser l’orbiteur de Venera-84 pour larguer l’atterrisseur avec le ballon dans l’atmosphère de Vénus, puis de se rediriger vers la comète de Halley. Roald Sagdeev, directeur de l’Institut de recherche spatial de Moscou, saisit la balle au bond et mesure d’emblée l’impact scientifique, médiatique et politique d’un tel projet, à l’heure où la Nasa a été contrainte de se retirer : ce sera la mission Vega (contraction en russe de Venera-Halley). S’engage alors une course contre la montre, rendue encore plus difficile par l’ouverture à l’ensemble de la communauté internationale de l’appel d’offres à réaliser les instruments scientifiques (fig. 6).

Fig 6. Modèle des deux sondes Vega1 et 2. Dérivé des sondes Venera, il est beaucoup plus volumineux que Giotto et pèse près de 5 tonnes. Les grands rectangles bleus sont les panneaux solaires. L’antenne de télécommunication est visible sur le côté à droite. La sphère rouge est l’atterrisseur qui sera déposé sur le sol de Vénus avant la rencontre avec la comète. (Crédit : Wikimedia Creative Commons/Daderot)

Enfin, l’agence spatiale japonaise Isas rejoint elle aussi le ballet des sondes cométaires en mettant sur pied une double mission de survol éloigné de la comète, destinée à étudier l’interaction de celle-ci avec le vent solaire. Les sondes Suisei et Sakigake seront lancées successivement en janvier et août 1985. C’est donc une armada de cinq sondes spatiales qui s’approchera de la comète de Halley entre le 6 et le 13 mars 1986, avec le plus grand succès.

La physique cométaire avant 1986

Que sait-on des comètes avant l’apparition de 1986 ? Ce sont de petits corps glacés, de quelques kilomètres de diamètre, situés sur des orbites très elliptiques qui les font voyager du plus loin au plus près du Soleil. Depuis les travaux d’Ernst Öpik en 1932, puis de Jan Oort en 1950, on sait que les comètes proviennent de deux réservoirs distincts : 1) le nuage de Oort, vaste coquille sphérique située à quelque 50 000-100 000 ua, d’où proviennent les comètes nouvelles, ou de très longue période, qui sont les plus brillantes ; 2) la ceinture de Kuiper, située au-delà de Neptune, entre 30 et 100 ua, d’où sont issues les comètes de courte période, de faible inclinaison, qui deviennent peu actives en raison de leurs multiples passages à proximité du Soleil.

Lorsqu’une comète s’approche de son périhélie, la glace de sa surface se sublime sous l’effet du rayonnement solaire et les molécules gazeuses libérées, entraînant avec elles des grains de poussière, forment la coma ou chevelure. Selon le modèle de la « boule de neige sale » proposé par l’astronome américain Fred Whipple en 1950, la comète est constituée essentiellement de glace d’eau. La molécule d’eau n’a pas été directement identifiée, mais son radical OH (résultant de la dissociation de l’eau par le rayonnement ultraviolet solaire) a été observé en abondance par spectrométrie à la fois dans l’ultraviolet et dans le domaine radio, ce qui suggère que l’eau est un constituant majoritaire des comètes. L’enjeu de l’exploration de la comète de Halley est donc d’abord de détecter directement la molécule d’eau, mais aussi d’identifier les autres molécules présentes dans le noyau de la comète (on les appelle les molécules mères).

La redécouverte

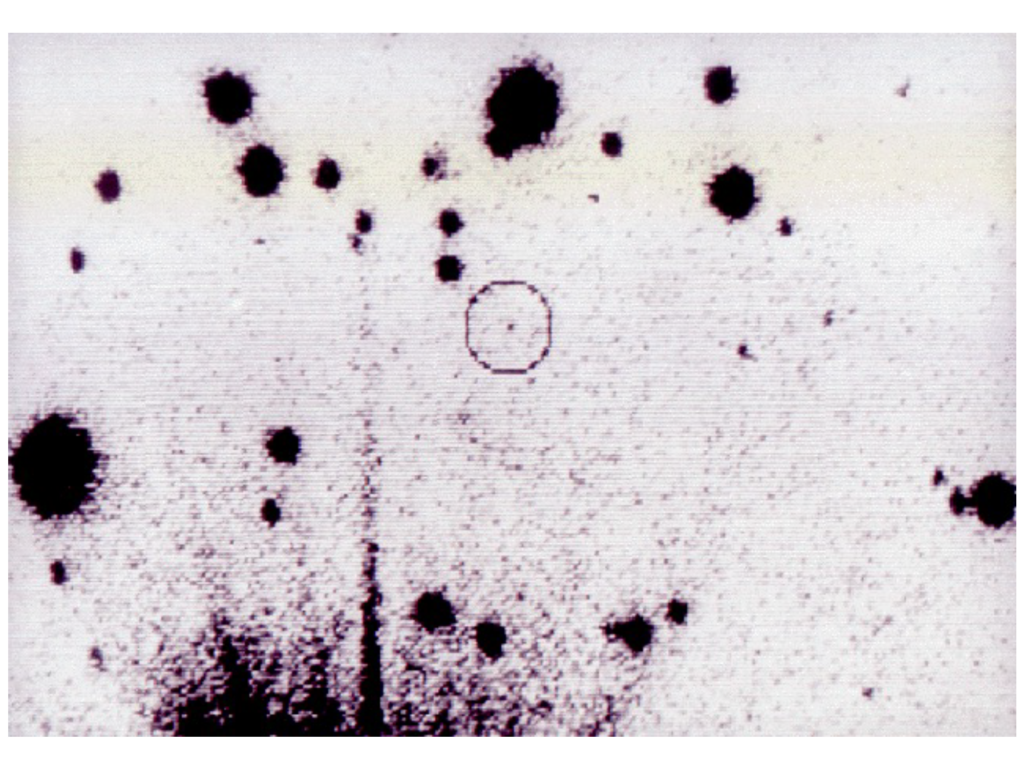

Revenons au début des années 1980. La comète, alors située à plus de 10 ua, n’est constituée que de son noyau et est donc très difficile à détecter. Les observateurs se lancent à sa recherche, d’abord sans succès, jusqu’à ce qu’en octobre 1982, elle apparaisse enfin sur une image prise par une caméra numérique à transfert de charge (CCD) d’un nouveau modèle, installée au Mont Palomar en Californie (fig. 7). Les capteurs CCD deviendront rapidement l’élément sensible des systèmes d’imagerie de l’astronomie, mais aussi de tous les appareils photographiques modernes. La comète a été retrouvée à moins de 10 secondes d’arc de la position prédite par les éphémérides du Jet Propulsion Laboratory, ce qui illustre la qualité du travail des astrométristes.

Fig 7. Image de la redécouverte de la comète de Halley au Mont Palomar le 16 octobre 1982. La comète est le petit point noir au centre du cercle. La caméra CCD qui a enregistré cette image sera montée sur le télescope spatial Hubble qui sera lancé en 1989. (Crédit : D. Jewitt et G. E. Danielson, JPL/California Institute of Technology)

Dès lors, la comète de Halley est régulièrement observée par les grands télescopes. Une structure internationale, l’IHW (International Halley Watch), pilotée par la Nasa, se met en place dès 1980 afin d’assurer la meilleure coordination possible entre les observateurs. L’IHW jouera un rôle très bénéfique pour structurer la communauté cométaire et pour rallier les astronomes amateurs qui jouent un rôle très actif dans les observations aux côtés des professionnels. Au début de 1985, la comète devient accessible aux télescopes de petite taille. Le premier spectre visible obtenu en Arizona, en mars 1985, montre les bandes de CN dans le proche ultraviolet et de C2 dans le visible.

La campagne d’observation au sol et en orbite terrestre

Nous l’avons vu, les conditions d’observation sont peu favorables. Les deux fenêtres les plus propices, correspondant au moment où la comète est le plus près de la Terre, se situent en novembre 1985 et avril 1986, cette dernière fenêtre n’étant accessible que depuis l’hémisphère Sud. En revanche, les astronomes disposent d’un avantage notoire par rapport à leurs prédécesseurs en 1910 : ils disposent de nouvelles techniques. Depuis les années 1970, la spectroscopie s’est ouverte aux domaines infrarouge et millimétrique. Or, ces domaines spectraux sont précieux, car ils portent les signatures spectrales des molécules mères, alors que les domaines ultraviolet et radio ne donnaient accès qu’aux radicaux et aux ions, produits de dissociation de ces molécules.

Dès l’automne 1985, les astronomes sont à pied d’œuvre et les télescopes prêts à pointer la comète. Le temps, malheureusement, est généralement médiocre, en Europe comme aux États-Unis et au Chili. De plus, en novembre 1985, la comète, vue de la Terre, se présente de face, peu brillante et très peu spectaculaire. Il n’empêche, chacun veut voir la comète et les associations d’astronomes, amateurs et professionnels, sont parfois dépassées par la demande du public. À l’Observatoire de Paris, les coups de téléphone affluent et sont parfois cocasses : « Vous avez vu la comète ? Vous êtes damné !!! » ou bien : « À quelle heure la comète passera-t-elle au-dessus de Tarbes ? »… Souvent, il faut faire face à la déception du public qui a longuement attendu pour voir l’objet au télescope et le trouve finalement fort décevant !

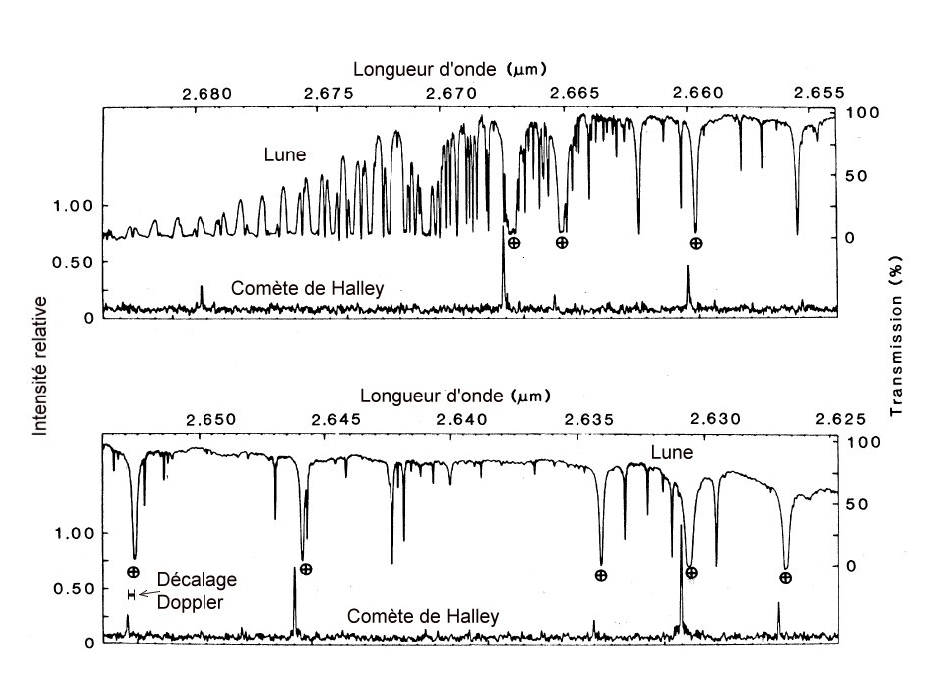

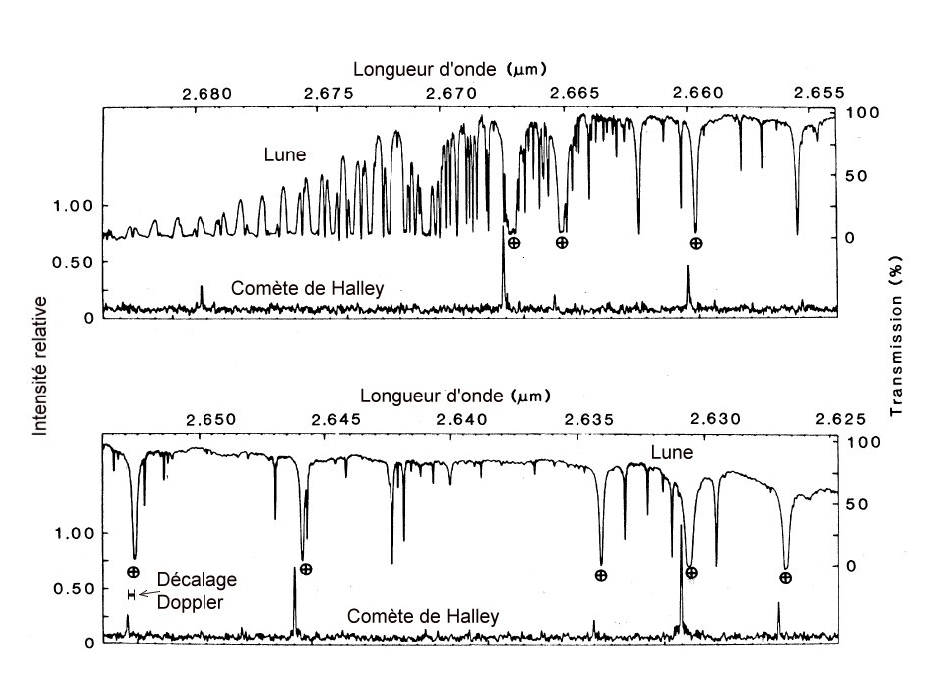

Heureusement, les radioastronomes ne sont pas gênés par la météo et la station de radioastronomie de Nançay, en Sologne (fig. 8), peut observer régulièrement le radical OH qui est un bon indicateur de l’activité de la comète, c’est-à-dire de son taux de dégazage. Les radioastronomes français découvrent la molécule HCN grâce à la nouvelle antenne de 30 m de l’Iram (Institut de radioastronomie millimétrique) fonctionnant dans le domaine millimétrique à Pico Veleta, en Espagne. De leur côté, en décembre 1985, des astronomes américains réalisent une très belle observation de la comète dans l’infrarouge proche, depuis l’avion stratosphérique KAO (Kuiper Airborne Observatory). Ils détectent enfin la bande spectrale de la vapeur d’eau (fig. 9), apportant la première preuve de l’existence de cette molécule, principal constituant cométaire. Les dernières observations depuis le sol sont faites en janvier 1986 ; la comète est maintenant vue de profil et sa queue est visible sur les images (fig. 10). Puis elle disparaît derrière le Soleil ; elle ne réapparaîtra qu’en avril, et sera observée par les télescopes du Chili. Entre-temps, elle aura été visitée par la flottille des sondes spatiales.

Fig 8. Le radiotélescope de Nançay, en Sologne. L’observation quotidienne de la comète de Halley à la longueur d’onde de 18 cm a permis de mesurer l’abondance du radical OH dans la coma, et donc d’en déduire l’évolution du taux de production de H2O de la comète en fonction du temps. (Crédit : Jean-Philippe Letourneur, CRDP Orléans)

Fig 9. Première détection de la vapeur d’eau dans une comète (Halley) par spectroscopie infrarouge à haute résolution depuis l’avion stratosphérique KAO (Kuiper Airborne Observatory), en décembre 1985. En haut : spectre de la Lune, montrant la transmission atmosphérique (les raies d’absorption sont surtout dues au CO2 terrestre) ; en bas : le spectre de Halley. Les raies de la vapeur d’eau apparaissent en émission. (Crédit : M. J. Mumma et al., Science, 232, 1986, 1523)

Fig 10. Image de la comète de Halley prise avec le télescope de Schmidt du Cerga (observatoire de la Côte d’Azur) le 12 janvier 1986. (Crédit : T. Lavergé/CERGE-CNRS)

L’exploration spatiale

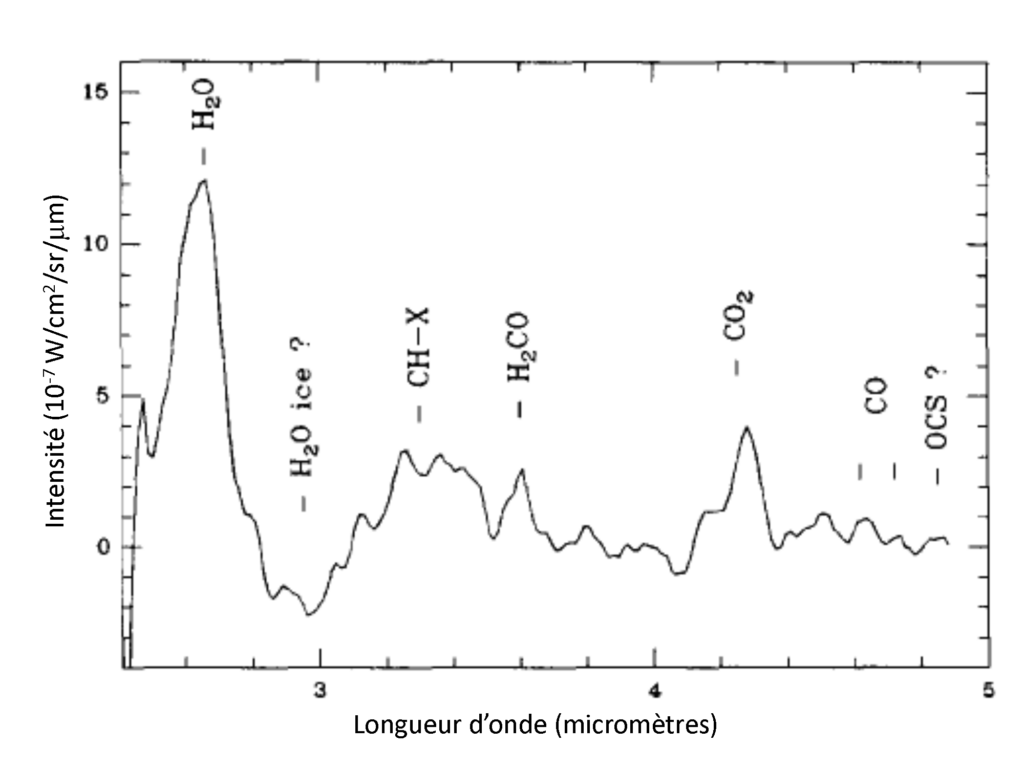

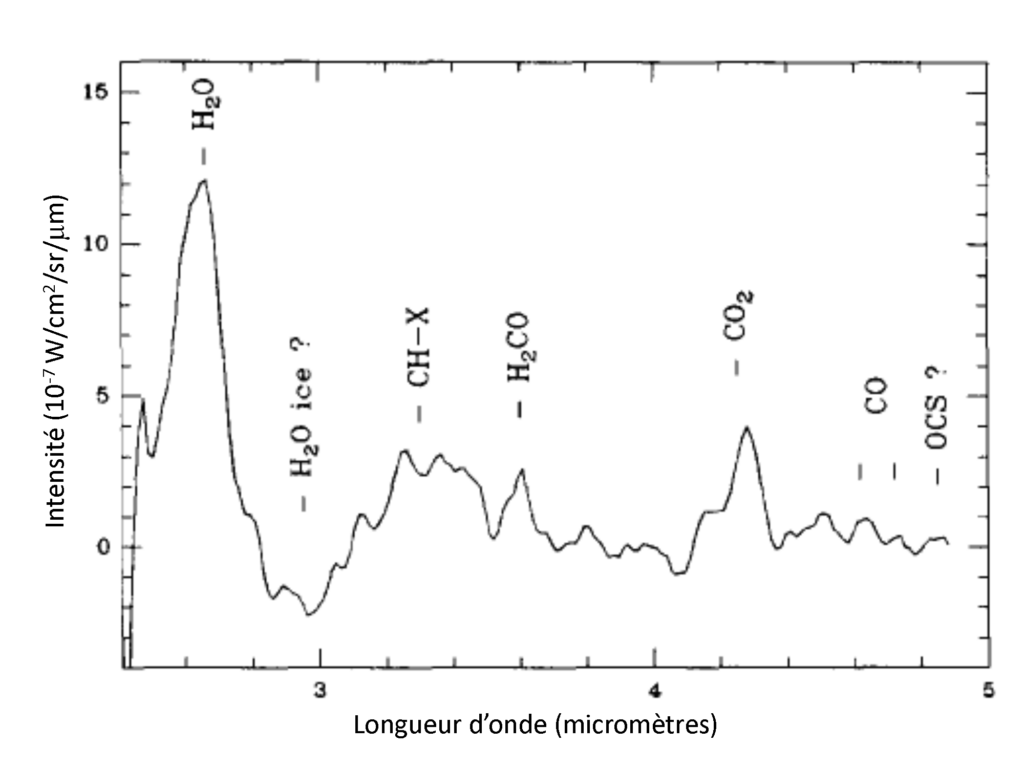

Les sondes spatiales arrivent toutes les cinq à proximité de la comète entre les 6 et 14 mars 1986. Entre le 4 et le 10 mars, toute la communauté scientifique est réunie à Moscou pour assister au survol de la comète par les deux sondes identiques Vega 1 et 2. C’est une première, rendue possible par l’arrivée au pouvoir de Mikhaïl Gorbatchev qui, en entreprenant un programme de libéralisation économique, politique et culturelle (la perestroïka), a permis l’ouverture à l’Ouest. Tous les instruments ont fonctionné, au moins sur l’une des deux sondes, et les résultats s’accumulent ; c’est une heure de gloire – peut-être la dernière – pour les scientifiques soviétiques. Premier résultat marquant, les images du noyau cométaire, bien que floues, montrent déjà une structure allongée, voire bilobée. La première expérience de spectroscopie infrarouge, réalisée par des laboratoires français, montre la présence de plusieurs molécules mères : il y a l’eau, bien sûr, mais aussi CO, CO2, H2CO, et aussi un ensemble complexe de molécules à base d’hydrocarbures dont la présence n’était pas attendue (fig. 11). Ce sont les fameux « CHON », les éléments légers C, H, O et N qui seront détectés en abondance par les spectromètres de masse de Vega, puis de Giotto. Voilà de quoi alimenter les débats et les recherches à venir !

Fig 11. Premier spectre infrarouge d’une comète (Halley) entre 2 et 5 mm, enregistré par le spectromètre français IKS de la sonde Vega. Comme sur la figure 9, les bandes spectrales cométaires apparaissent en émission, car elles sont excitées par fluorescence. Le spectre montre la signature de H2O à 2,7 mm (c’est, à basse résolution, la même bande spectrale que celle de la figure 9), les bandes de H2CO, CO2 et CO, ainsi que la bande notée CH-X, correspondant à des composés hydrocarbonés aussi présents dans la matière interstellaire, dont la présence dans la comète était inattendue. (Crédit : M. Combes et al., Icarus, 76, 40, 1988)

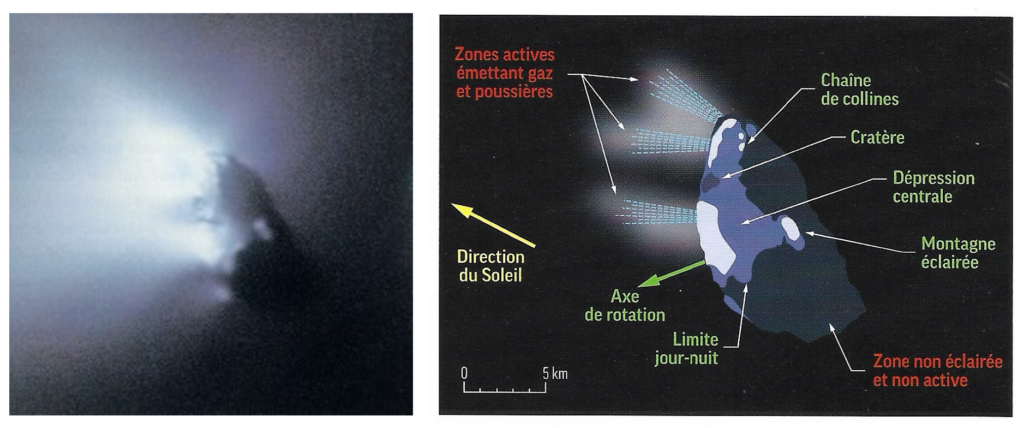

Le 13 mars, c’est la sonde européenne Giotto qui s’approche au plus près de la comète, à une distance d’environ 600 km. Là aussi, le succès est complet et l’image du noyau (fig. 12), de qualité bien supérieure à celle des sondes Vega, fait rapidement le tour du monde. Le noyau y apparaît allongé et recouvert partiellement de matériau carboné, avec des régions actives, couvertes de glace d’eau qui se sublime, et d’où s’échappent des jets de gaz et de poussière. Le passage des sondes japonaises, le 8 et le 11 mars, est plus discret, car les survols sont beaucoup plus éloignés (150 000 km et 7 millions de km respectivement), mais les données recueillies seront précieuses pour l’étude de l’interaction entre la comète et le vent solaire.

Fig 12. Le noyau de la comète de Halley vu par la caméra de la sonde Giotto, depuis une distance de 16 400 km le 14 mars 1986 (à gauche) et le schéma explicatif (à droite). (Crédit : ESA/Max-Planck-Institut für Astronomie, Lindau/J. Lequeux et T. Encrenaz, À la rencontre des comètes, Belin, 2015)

Qu’avons-nous appris ?

Au second semestre de l’année 1986, trois conférences internationales se tiennent en Europe, permettant aux scientifiques d’échanger leurs découvertes. La première, organisée par le Cospar (Comité pour la recherche spatiale) en juillet 1986, se concentre sur les missions spatiales et sur l’étude de l’interaction de la comète de Halley avec le vent solaire. La deuxième est organisée par l’Esa à Heidelberg en octobre 1986, et la troisième se tient à Paris, sous l’égide de la division des sciences planétaires de l’Association américaine d’astronomie (AAS-DPS). Ces réunions sont l’occasion d’une large confrontation entre les observations, acquises depuis le sol et dans l’espace, et les modèles théoriques de physique cométaire, mais aussi de formation stellaire ; il y règne une grande excitation et une ambiance de fête.

Premier résultat : le modèle de la « boule de neige sale » de Fred Whipple est bien confirmé. Le noyau de la comète de Halley est constitué d’eau à 80 % en masse. Mais il est aussi beaucoup plus sombre que prévu, car il est partiellement recouvert d’une couche de matériau carboné réfractaire, probablement formée par l’irradiation, par le rayonnement ultraviolet solaire, des produits organiques contenus dans les glaces du noyau. Au fur et à mesure des passages successifs de la comète à proximité du Soleil, les glaces de sa surface se subliment et sa fraction « active » diminue au profit de la couche réfractaire. La présence d’éléments légers (H, C, N, O), les « CHON », dans les grains cométaires a aussi été mise en évidence par les spectromètres de masse des sondes Vega et Giotto, ce qui souligne l’analogie entre le matériau cométaire, formé à l’origine du Système solaire, et la matière interstellaire dont il est issu. Autre résultat important obtenu par le spectromètre de masse de la sonde Giotto, la mesure du rapport D/H (deutérium/hydrogène) indique un enrichissement en deutérium de la comète d’un facteur de l’ordre de 2 par rapport à la valeur D/H des océans terrestres qui sert de référence (VSMOW = 1,6 10–4). Cet enrichissement, qui sera ultérieurement confirmé sur d’autres comètes, est un diagnostic de l’origine de l’eau sur Terre et suggère que celle-ci provient majoritairement des corps glacés du Système solaire extérieur, dans lesquels le rapport D/H est enrichi par rapport à la phase gazeuse.

Les résultats de la campagne d’observation de Halley vont occuper les scientifiques pendant plus d’une décennie. L’observation des comètes va se poursuivre avec l’apparition de deux comètes nouvelles particulièrement brillantes, C/1996 B2 Hyakutake et C/1995 O1 Hale-Bopp qui passera au périhélie en 1997. Dans les décennies qui suivent, plusieurs comètes de courte période (19P/Borrelly, 81P/Wild 2, 9P/Tempel 1, 103P/Hartley 2) seront survolées par des sondes spatiales américaines. En 2004, l’Agence spatiale européenne lance l’ambitieuse mission Rosetta qui explorera la petite comète 67P/Churyumov-Gerasimenko (« Choury ») entre 2014 et 2016, déposant à sa surface le petit robot Philae.

Il y a deux ans, vers la fin de l’année 2023, la comète de Halley est passée à l’aphélie de sa trajectoire, au-delà de l’orbite de Neptune, à plus de 35 ua du Soleil. Elle revient donc vers nous, et sa prochaine apparition interviendra en juillet 2061. Alors s’écrira un nouveau chapitre de l’exploration de cet astre qui n’en finit pas de fasciner les humains et de passionner les astronomes.

Article écrit par Thérèse ENCRENAZ │ LIRA, Observatoire de Paris

par Petank SORO | Avr 1, 2026 | Zoom Sur

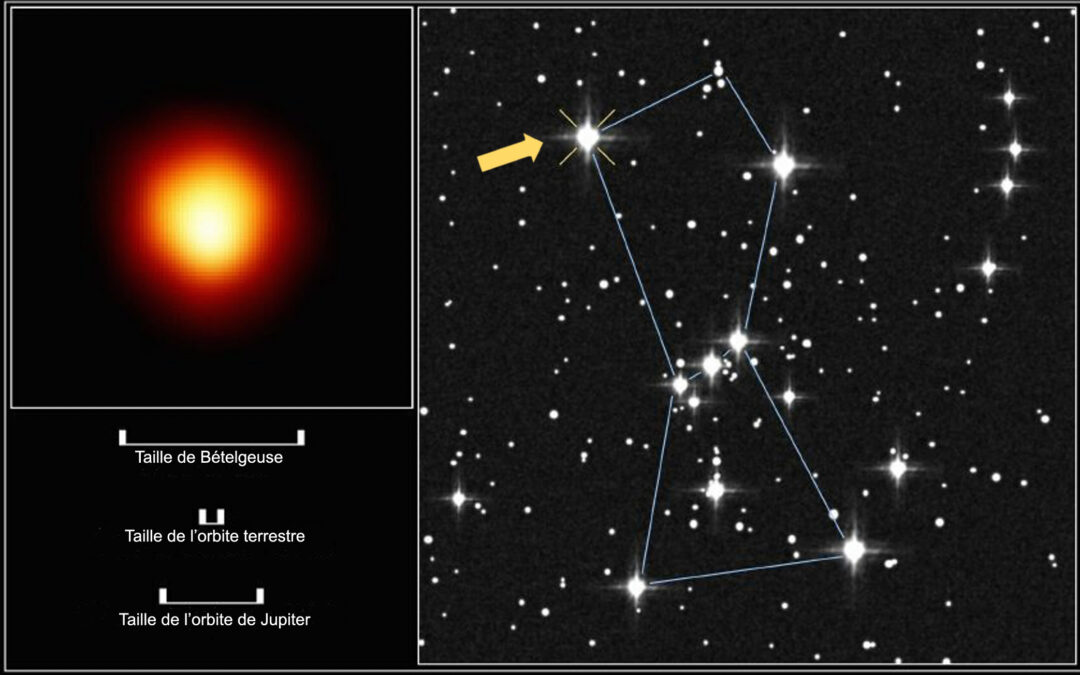

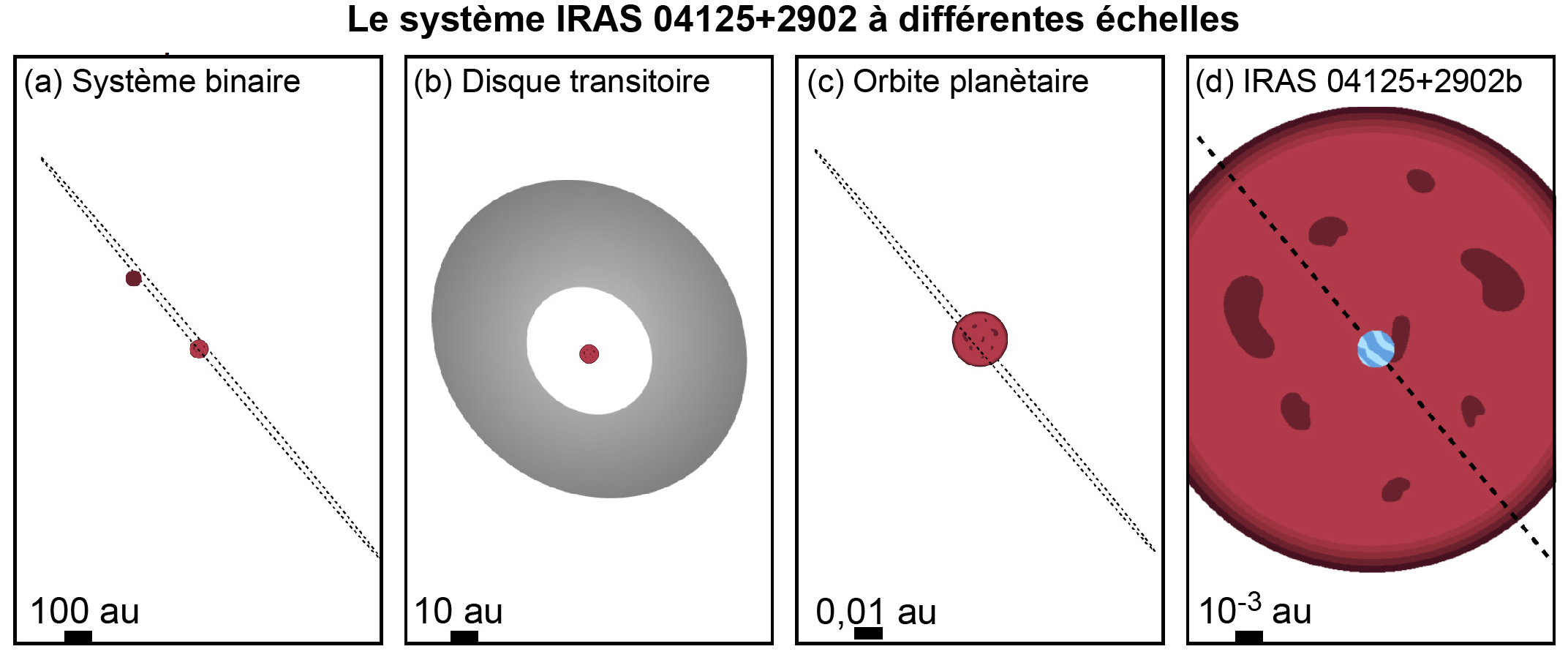

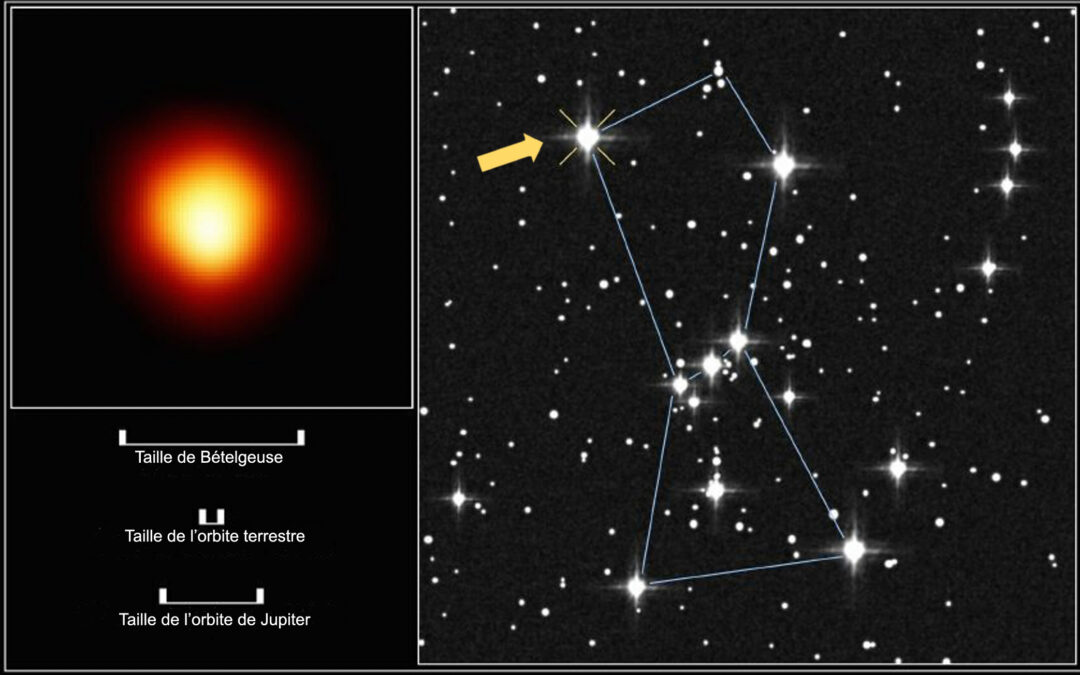

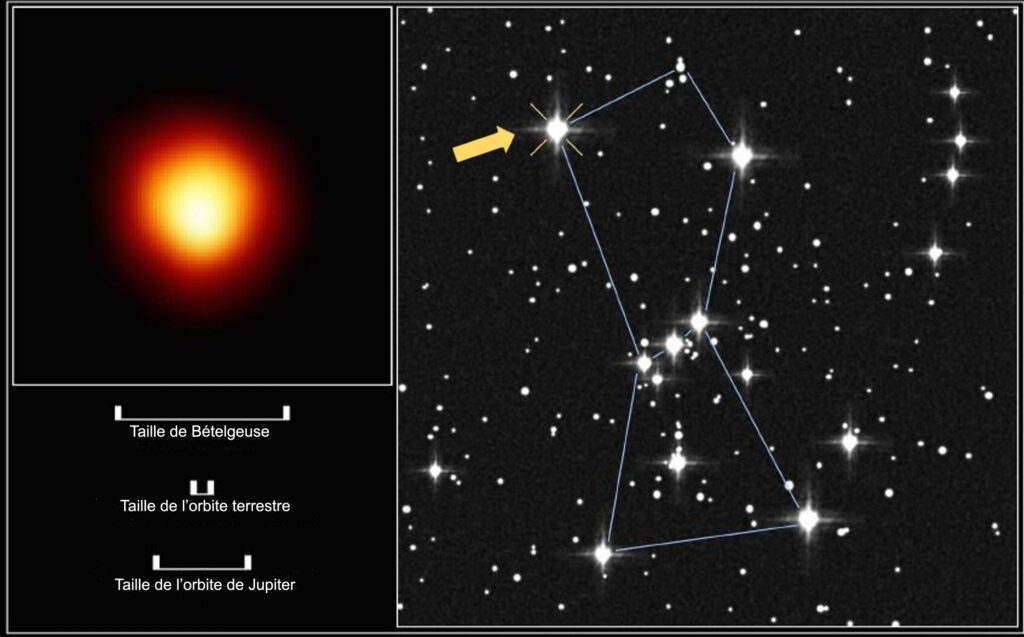

Première image directe d’une étoile autre que le Soleil, la supergéante rouge Bételgeuse, obtenue avec le télescope spatial Hubble. (Crédit : d’après Andrea Dupree [Harvard-Smithsonian CfA], Ronald Gilliland [STScI], NASA et ESA)

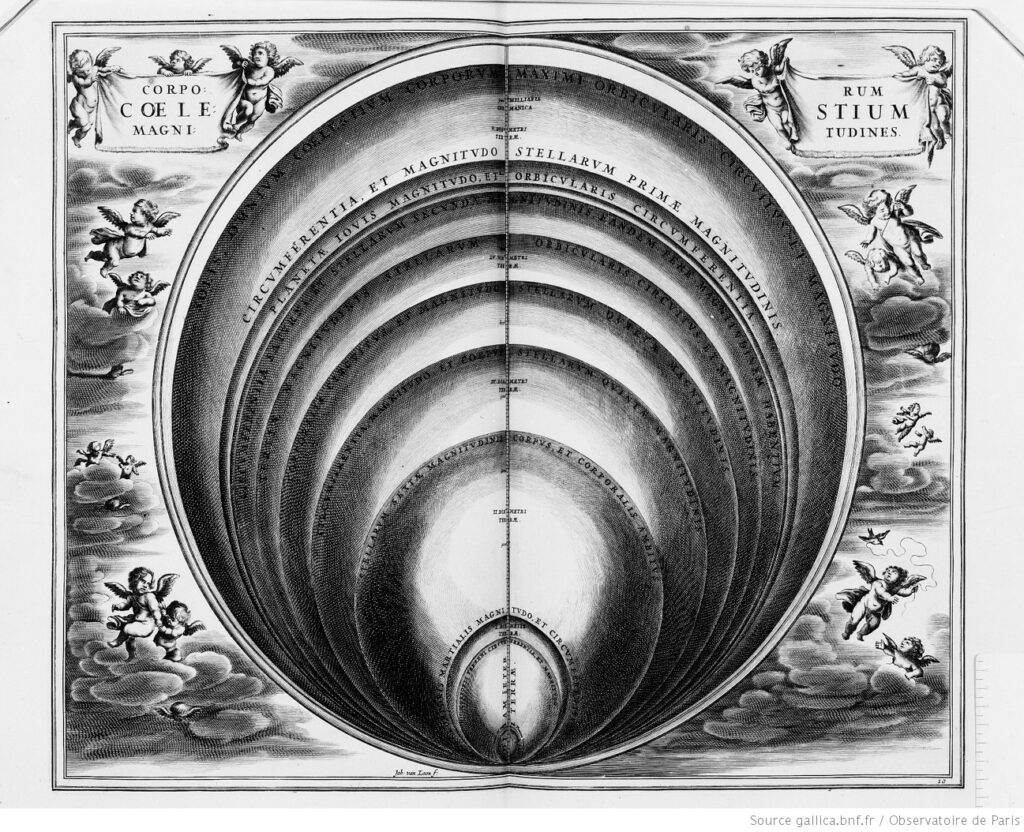

Depuis l’Antiquité jusqu’au xviie siècle, où l’on n’avait aucune idée de la distance des étoiles, que l’on supposait généralement réparties sur une sphère dont nous occupons le centre – la sphère céleste –, on pensait que les étoiles les plus brillantes étaient les plus grosses. Il faut probablement voir là l’origine du terme de grandeur, par lequel on désignait il y a peu de temps encore l’éclat apparent des étoiles. Il est vrai que les étoiles les plus brillantes nous paraissent plus grosses que les petites, en raison de la diffusion de la lumière à l’intérieur de l’œil. Il a fallu longtemps pour nous débarrasser de ces préjugés et aboutir à des déterminations du diamètre des étoiles dénuées d’ambiguïté. C’est cette démarche que nous allons suivre.

Premières estimations

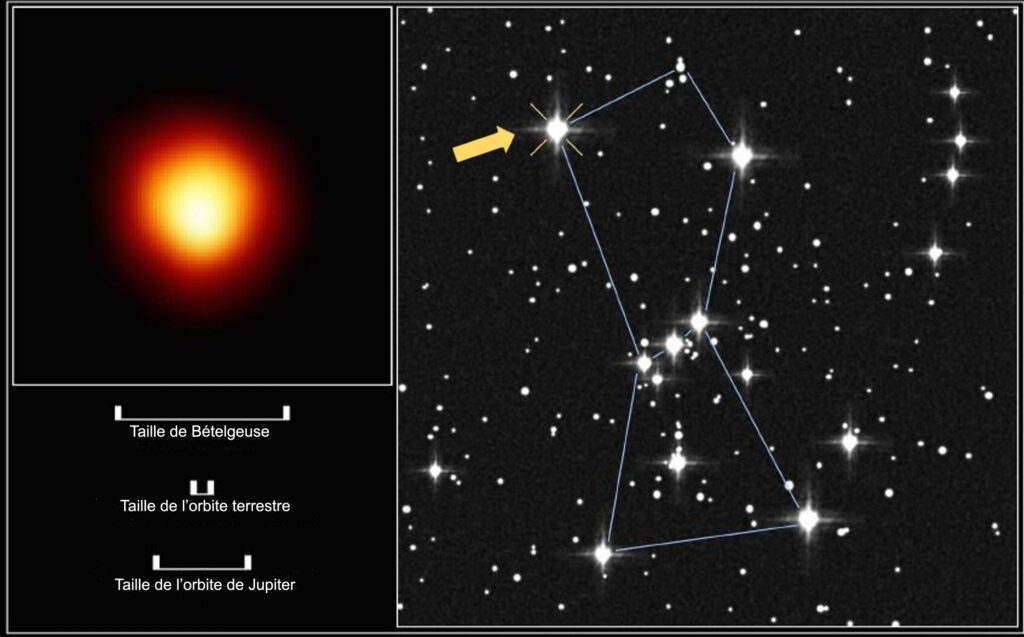

On peut trouver dans la littérature scientifique ancienne des estimations du diamètre apparent des étoiles. Ainsi, Tycho Brahe (1546-1601) attribuait à Sirius un diamètre angulaire de 4 minutes de degré, alors que les étoiles les plus faibles lui paraissaient avoir un diamètre de l’ordre de la minute. De son côté, Pierre Gassendi (1592-1655), muni d’une lunette que ne connaissait pas Tycho, trouvait pour Sirius un diamètre de 10 secondes de degré, que Jean-Dominique Cassini (1625-1712), qui avait de meilleurs objectifs, réduisit ultérieurement à 5 secondes. En attribuant aux étoiles des distances totalement sous-estimées, plusieurs astronomes du xviie siècle pensaient que les étoiles de première grandeur avaient un diamètre linéaire de l’ordre de celui de Jupiter. Le diamètre de Jupiter était d’ailleurs lui-même sous-estimé d’un bon facteur 10, comme toutes les distances dans le Système solaire, jusqu’à ce que Jean Richer (1630-1696) et Cassini en fournissent une estimation assez bonne vers 1672. La figure 1 montre qu’Andreas Cellarius (1596-1665) donnait en 1661 des dimensions des étoiles de l’ordre de 1 à 5 fois celles de la Terre.

Fig 1. Dimensions des étoiles de la première à la sixième grandeur, d’après Andreas Cellarius, dans Harmonia macrocosmica seu Atlas universalis et novus… (1661). L’échelle verticale est graduée de 0 à 5 diamètres de la Terre. (Crédit : Bibliothèque de l’Observatoire de Paris)

Les estimations suivantes sont un peu moins fantaisistes. Par exemple, William Herschel (1738-1822) mesurait en 1781 un diamètre apparent de 0,36 seconde de degré pour Véga, et à travers le brouillard, de 0,2 seconde pour Arcturus : c’était évidemment la dimension de la tache de diffraction de son télescope, plus ou moins affectée par la turbulence atmosphérique. Ce sont d’ailleurs les meilleures images directes que l’on puisse obtenir à partir du sol, dans des conditions atmosphériques exceptionnelles.

Dans son Astronomie populaire, François Arago (1786-1853) commente comme suit ces estimations, vers 1850 : « En prenant ces dimensions comme réelles, et d’après les distances les plus petites que l’on puisse supposer de ces étoiles à la Terre (distances telles que leur lumière arrive en trois ans), leurs diamètres réels seraient respectivement de 14 millions et de 8 millions de lieues [1 lieue = environ 4 km]. Ces diamètres sont probablement fort exagérés. » Rappelons-nous que la première distance d’une étoile, 61 Cygni, avait été mesurée en 1838 par Bessel (1784-1846), qui l’avait trouvée de 10,3 années-lumière.

Il est cependant possible de faire mieux. Dès 1829, Arago avait repris un raisonnement de l’Anglais William Wollaston (1766-1828), qui avait comparé les éclats apparents du Soleil et de Sirius et trouvé que le Soleil est 20 milliards de fois plus brillant. Si Sirius est comparable au Soleil, il doit se trouver à une distance plus grande que le Soleil dans un rapport égal à la racine carrée de 20 milliards, soit à 141 000 unités astronomiques. Le diamètre angulaire réel de l’étoile doit donc être dans le même rapport avec celui du Soleil, 30 minutes de degré, ce qui donne 0,013 seconde de degré, bien moins que les chiffres pour lesquels Herschel avait donné un ordre de grandeur. Il est curieux qu’Arago, en écrivant plus tard son Astronomie populaire, n’ait pas refait le calcul en utilisant la parallaxe de Sirius mesurée entre 1832 et 1835 par les Écossais Thomas Henderson (1798-1844) et Thomas Maclear (1794-1879), soit 0,15” (valeur moderne : 0,38”). Il aurait alors trouvé un diamètre angulaire encore 10 fois plus petit.

Les premiers essais de mesures directes

On est maintenant persuadé, au milieu du xixe siècle, que le diamètre apparent réel des étoiles est très petit, et que leur image est étalée par la turbulence de l’atmosphère, ainsi que par la diffraction par l’instrument d’observation et les défauts de l’œil. Mais comment mesurer un diamètre aussi petit ? C’est le physicien français Hippolyte Fizeau (1819-1896) qui donnera la solution en 1851 dans un écrit intitulé « Sur un moyen de déduire le diamètre des étoiles de certains phénomènes d’interférence » qu’il n’a pas publié, mais dont il a seulement donné un résumé succinct en 1868.

L’idée est très simple : si l’on observe l’étoile à travers un écran opaque percé de deux trous, elle produira des franges d’interférence si elle est pratiquement ponctuelle. Mais si elle a un diamètre apparent suffisamment grand, les franges produites par les différents points de sa surface seront brouillées et on ne les verra plus. Par exemple, si les deux trous sont distants de 60 cm, le calcul montre que les franges en lumière blanche disparaîtront si le diamètre de l’étoile atteint approximativement un sixième de seconde de degré.

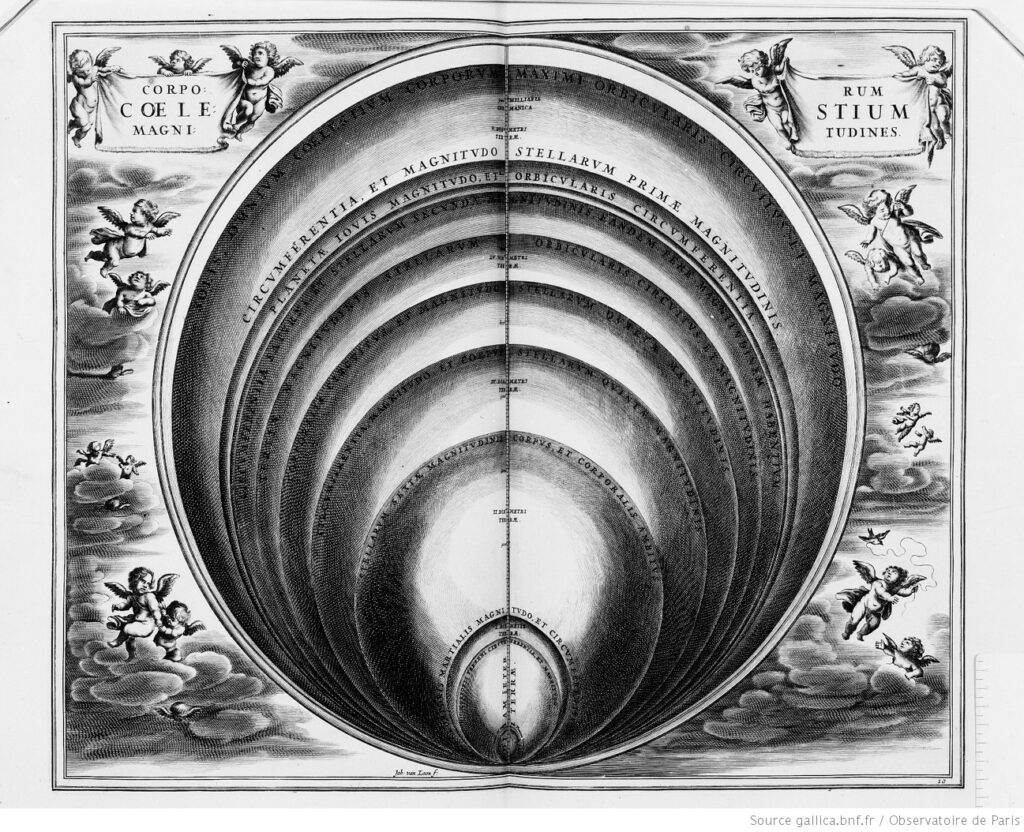

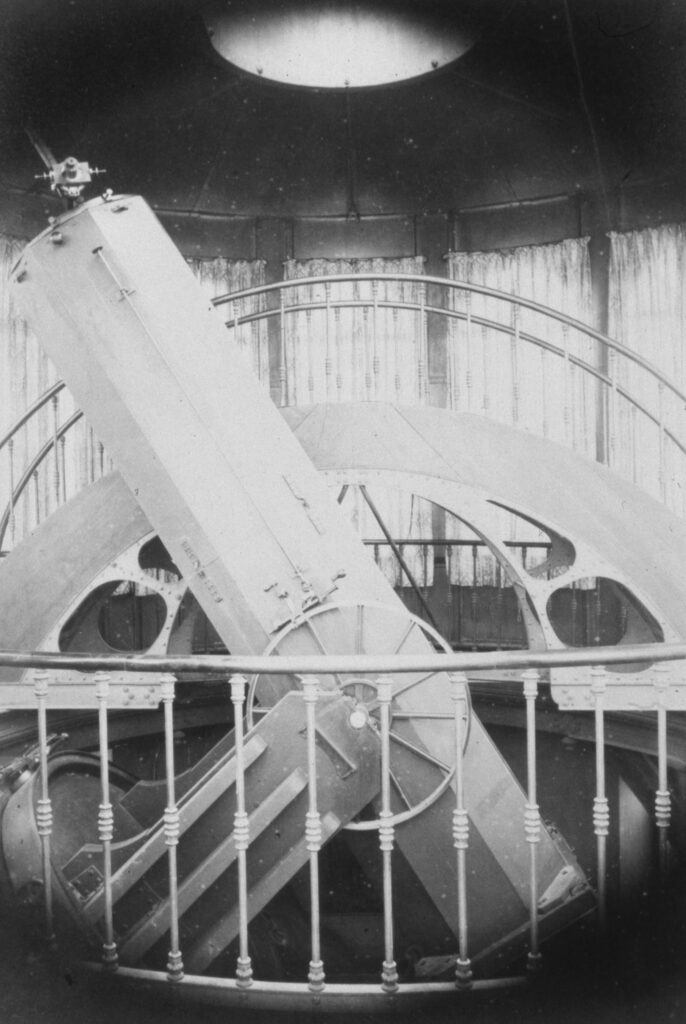

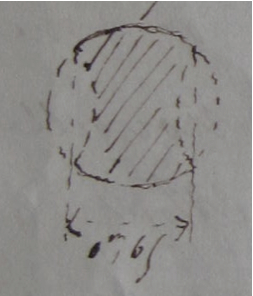

Fizeau n’aura pas de difficulté à convaincre Édouard Stephan (1837-1923), le directeur de l’observatoire de Marseille, lequel possède alors le plus grand télescope du monde à miroir de verre argenté (les autres ont des miroirs de bronze, bien moins réfléchissant), de tenter l’observation. Cet instrument (fig. 2), dont le diamètre est de 80 cm, a été construit par Foucault et Secretan et est d’excellente qualité optique. Stephan va placer sur son miroir un diaphragme représenté figure 3, qui ne laisse passer la lumière que par deux lunules distantes de 65 cm. Puis il va regarder avec ce dispositif, au début des années 1870, les étoiles les plus brillantes du ciel, jusqu’à la troisième magnitude. Déception ! Elles donnent toutes des franges d’interférence, et Stephan écrit à Fizeau : « Ainsi, le diamètre apparent de toutes les étoiles observées est considérablement inférieur à 1/6 de seconde d’arc. Si je ne me trompe, c’est là une notion bien acquise, la première qui ait encore été obtenue en la matière. Un tel résultat n’est pas sans importance. […] Le principe de la méthode subsiste, l’instrument est encore trop petit, voilà tout. » Stephan espère que le télescope de 120 cm de diamètre alors en construction à l’Observatoire de Paris pourra résoudre quelques étoiles, mais sa qualité optique sera si mauvaise qu’il ne sera pas utilisable à cette fin.

Fig 2. Le télescope de 80 cm de Foucault à l’observatoire de Marseille. La coupole originale de Foucault que l’on voit sur cette photographie a disparu, mais ce superbe instrument est toujours visible. (Crédit : Bibliothèque de l’Observatoire de Paris)

Fig 3. Dessin par Stephan du diaphragme qu’il a posé sur le miroir de 80 cm du télescope de Foucault. (Crédit : Académie des sciences, fonds 64J, Hippolyte Fizeau)

En 1890 et 1891, Albert Michelson (1852-1931) publie deux articles où il explique que l’on peut mesurer avec précision le diamètre apparent des astres en plaçant deux fentes devant l’objectif d’une lunette et en examinant les franges d’interférence ainsi produites. C’est la même idée que celle de Fizeau, mais il ne le cite nulle part alors qu’il avait admiré certaines expériences faites par celui-ci. Il ne mentionne pas non plus les essais de Stephan. Quoi qu’il en soit, ces articles très complets décrivent le principe de la mesure, et Michelson applique à titre d’essai cette méthode à la détermination du diamètre apparent des satellites de Jupiter, une opération répétée en 1898 par Maurice Hamy (1861-1936) avec le grand équatorial coudé de l’Observatoire de Paris. Mais la résolution angulaire, limitée par la taille de l’objectif, est insuffisante pour mesurer le diamètre des étoiles.

Michelson et Pease mesurent le diamètre de Bételgeuse

Il faut attendre 1919 pour que Michelson et son collaborateur Francis G. Pease (1881-1938) reçoivent une subvention pour mesurer par interférométrie le diamètre de Bételgeuse. Cette fois, on ne part pas de zéro, car la connaissance des étoiles s’est beaucoup améliorée : en 1900, Max Planck (1858-1947) a publié sa théorie du rayonnement du corps noir, bientôt vérifiée par l’expérience. Si l’on assimile le rayonnement d’une étoile à celui d’un corps noir, ce qui n’est pas une mauvaise approximation en général, on peut obtenir sa température de surface en observant la distribution en longueur d’onde de l’énergie rayonnée, puis calculer sa brillance par unité de surface en lumière visible, et enfin, connaissant son éclat, estimer son diamètre apparent. Le problème, c’est que le rayonnement des étoiles relativement froides comme Bételgeuse est principalement dans l’infrarouge, où les mesures à l’époque sont difficiles et rares : aucune mesure dans l’infrarouge n’avait été faite jusqu’alors pour Bételgeuse, et c’est tout l’intérêt de la tentative de Michelson et Pease.

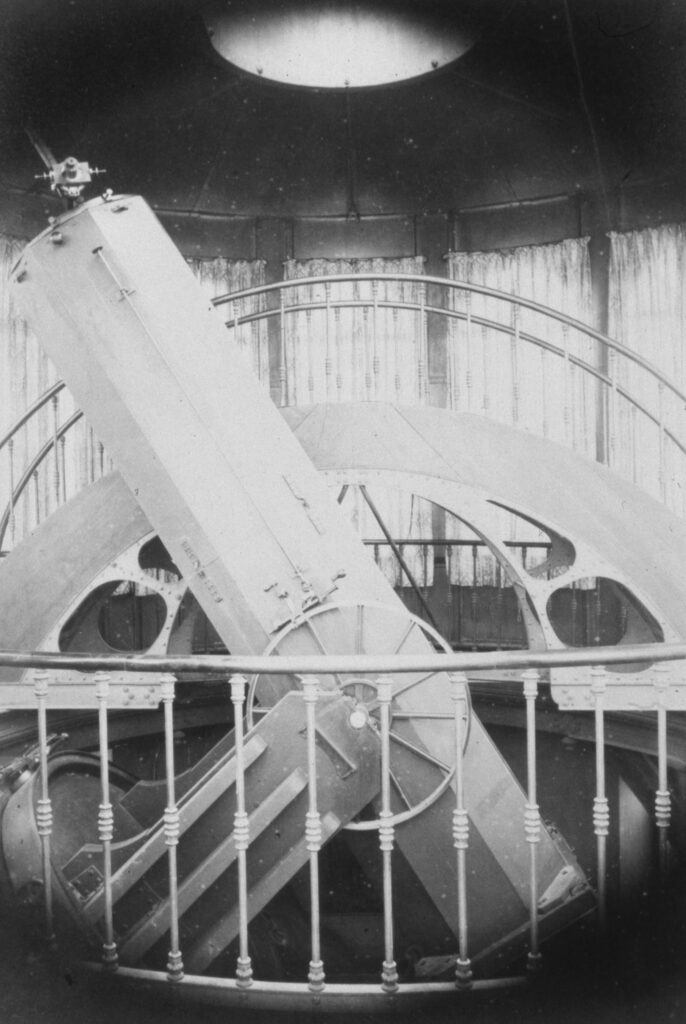

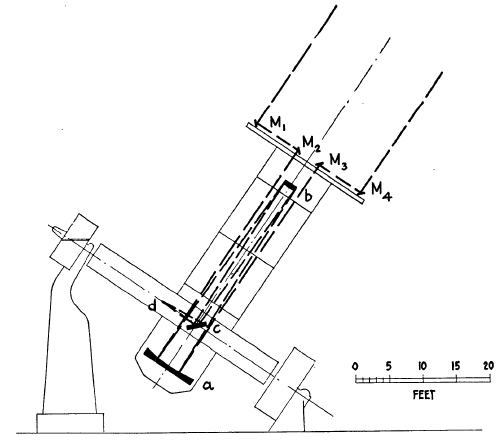

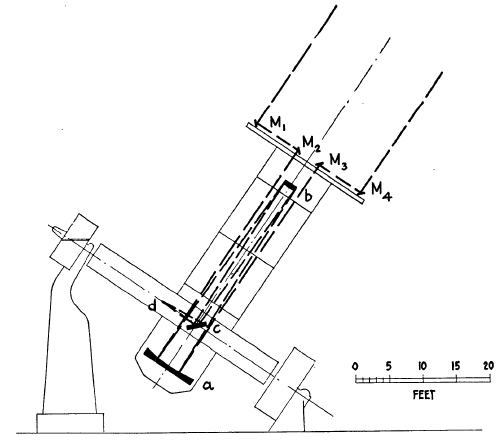

Ceux-ci installent donc sur le télescope de 2,5 m du Mont Wilson une poutre sur laquelle on peut déplacer des miroirs de renvoi, formant ainsi un interféromètre de base variable assez longue (fig. 4). Ils trouvent ainsi, en observant la première annulation des franges lorsqu’ils écartent les miroirs de renvoi, un diamètre apparent de 0,047 seconde de degré. La distance de Bételgeuse est encore mal connue, mais il est néanmoins déjà évident qu’il s’agit d’une supergéante, qui remplirait l’orbite de Mars.

Fig 4. Le dispositif de Michelson pour mesurer le diamètre de Bételgeuse. Sur une poutre montée sur le télescope de 2,5 m du Mont Wilson, les miroirs mobiles M1 et M4 à 45° reçoivent la lumière de l’étoile, la renvoient sur les miroirs fixes M2 et M3 également à 45°, qui la renvoient eux-mêmes sur le miroir primaire du télescope, puis le miroir secondaire convexe b du montage Cassegrain et le miroir de renvoi c. Les franges d’interférence se forment en d. Ce dispositif avait déjà été imaginé par Fizeau, qui ne l’avait cependant pas mis en pratique. (Crédit : d’après Michelson et Pease, 1921)

Pease déterminera ensuite le diamètre d’Arcturus, mais la longueur de la base est encore insuffisante pour résoudre d’autres étoiles. Il construira un autre interféromètre à plus grande base, mais n’obtiendra avec lui aucun résultat valable et l’abandonnera en 1938.

Stagnation et renouveau de la mesure du diamètre des étoiles

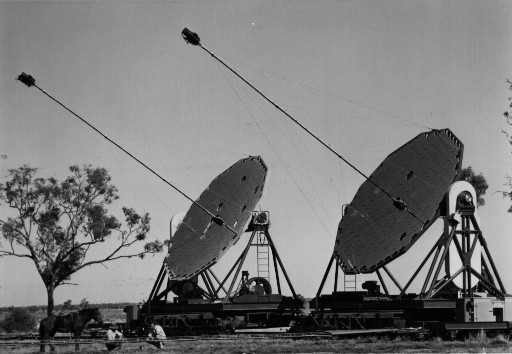

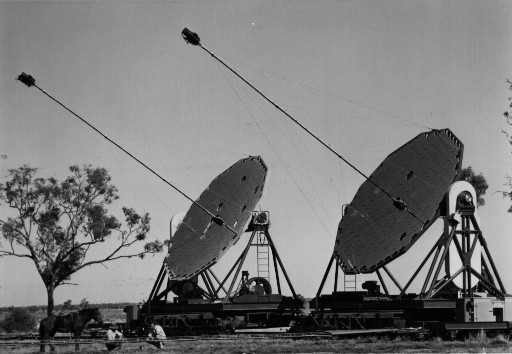

L’échec de Pease va décourager les astronomes qui espéraient continuer ce travail, jusqu’à ce qu’une nouvelle technique interférométrique apparaisse en 1956. C’est l’interférométrie d’intensité, initialement développée par les radioastronomes et que les chercheurs anglais Robert Hanbury Brown (1916-2002) et Richard Q. Twiss (1925-2005), un génial physicien amateur, adapteront au domaine visible. Cette fois, on se contente de détecter le signal de l’étoile avec deux télescopes, et de corréler électroniquement entre eux les signaux issus des détecteurs (en l’occurrence des cellules photoélectriques à multiplicateurs d’électrons). Bien que les physiciens aient eu initialement des difficultés à comprendre ce qui se passe, cela fonctionne et nos deux chercheurs mesurent ainsi le diamètre apparent de Sirius avec deux petits télescopes. Ce succès va les encourager à construire à Narrabri, en Australie, un grand interféromètre d’intensité (fig. 5) avec lequel ils mesureront le diamètre apparent des 32 étoiles les plus brillantes accessibles du site.

Fig 5. L’interféromètre d’intensité de Narrabri. Il était formé de deux miroirs mosaïque de 6,5 m de diamètre, mobiles sur une voie ferrée circulaire de 188 m de diamètre. La lumière de l’étoile visée était concentrée sur une cellule photoélectrique portée par le long mât. L’instrument est aujourd’hui démonté. (Crédit : photographie communiquée par le professeur John Davis (1932-2010), université de Sydney)

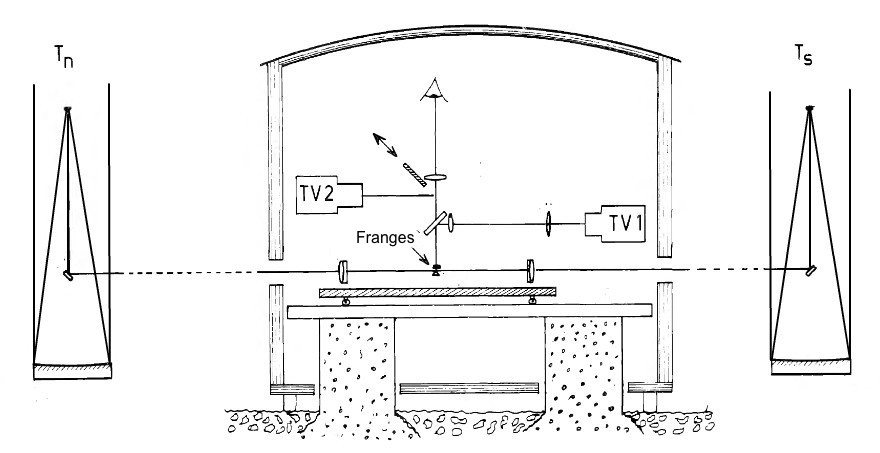

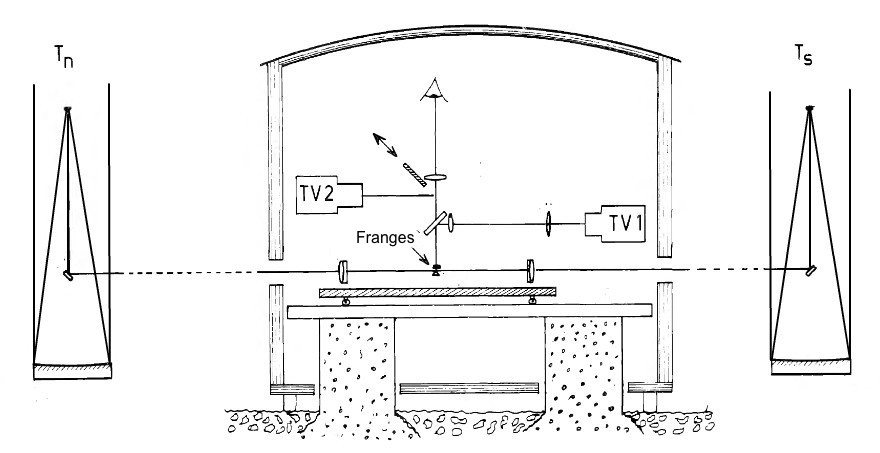

Cependant, l’interférométrie d’intensité manque de sensibilité, et ses auteurs eux-mêmes considèrent qu’elle n’a pas d’avenir. Il faut revenir à la technique classique de Fizeau et de Michelson, qui est bien plus sensible. Elle est reprise en 1974 par Antoine Labeyrie, d’abord avec deux petits télescopes séparés de 12 mètres, puis avec des télescopes plus grands. La figure 6 montre le dispositif qu’il a employé initialement, avec lequel il a déterminé le diamètre apparent de Véga. Tous les interféromètres ultérieurs seront construits selon le même principe, sauf que l’égalité des trajets optiques nécessaire pour obtenir des franges d’interférence peut être réalisée de façon différente par des lignes à retard optiques, sans avoir à déplacer la table où se forment ces franges.

Fig 6. Principe du premier interféromètre de Labeyrie. La lumière de l’étoile est reçue par les deux télescopes Cassegrain de 25 cm de diamètre Tn (au nord) et Ts (au sud), et renvoyée dans le laboratoire central où les franges d’interférence se forment après réflexion sur un petit prisme et superposition des deux faisceaux. On peut les observer directement, ou les projeter sur la caméra TV2 en insérant un miroir à 45°. La caméra TV1 sert au guidage des télescopes. La table d’expérience est déplacée afin d’assurer l’égalité des trajets optiques avant leur interférence. La base avait initialement une longueur de 12 m ; elle a été portée ultérieurement jusqu’à 60 m. (Crédit : adapté de Labeyrie A., Astrophysical Journal 196, p. L71-L75)

L’interférométrie optique est aujourd’hui florissante, mais pratiquement toujours dans l’infrarouge où tout est moins critique que dans le domaine visible, car la turbulence atmosphérique est moins gênante aux grandes longueurs d’onde. Il y a actuellement dans le monde une dizaine d’interféromètres optiques opérationnels. Les premiers n’avaient que de petits télescopes, mais il est maintenant possible d’utiliser des télescopes de plus grand diamètre à condition de les équiper d’optique adaptative. Un bel exemple est l’instrument GRAVITY de l’Observatoire européen austral (Eso), qui combine la lumière infrarouge, soit des quatre télescopes de 8,2 m du VLT, soit de quatre télescopes auxiliaires de 1,8 m de diamètre, tous avec optique adaptative (fig. 7).

Fig 7. Vue aérienne du site du Very Large Telescope de l’Eso au Paranal (Chili). On y voit entre autres les 4 coupoles cylindriques des télescopes de 8,2 m, les 4 coupoles hémisphériques des télescopes mobiles de 1,8 m destinés à l’interférométrie, et sur le sol, en blanc, les différentes pistes sur lesquelles peuvent être déplacés ces télescopes. (Crédit : J. L. Dauvergne & G. Hüdepohl [atacamaphoto.com]/ESO)

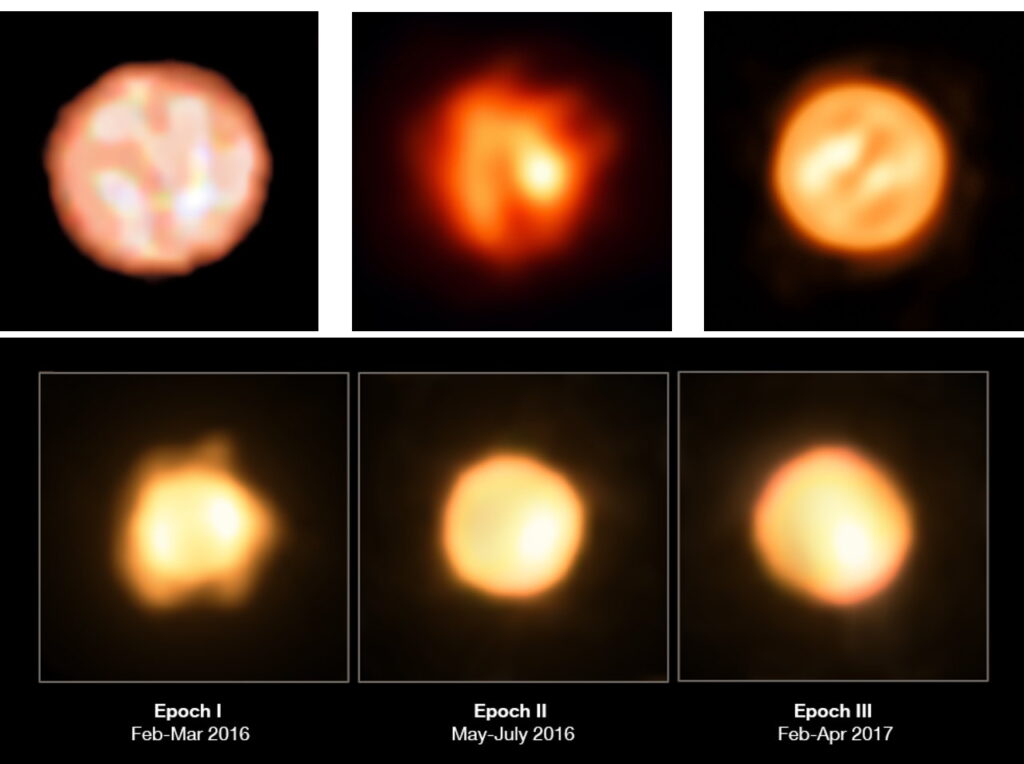

Fig 8. Images d’étoiles obtenues en infrarouge avec le Very Large Telescope Interferometer (VLBI) de l’Eso (fausses couleurs). En haut à gauche : π1 Gruis, géante rouge ; diamètre apparent 0,018 seconde de degré. (Crédit : ESO, C. Paladini) – En haut au milieu : R Sculptoris, géante de la branche asymptotique ; diamètre apparent 0,015 seconde de degré. (Crédit : ESO/M. Wittkowski) – En haut à droite : Antarès, supergéante rouge ; diamètre apparent 0,0376 seconde de degré. (Crédit : ESO, K. Ohnaka) En bas : variations temporelles de V766 Centauri, supergéante jaune à forte perte de masse ; diamètre apparent 0,045 seconde de degré. (Crédit : ESO/M. Wittkowski) Sur toutes ces images, les structures sont d’immenses cellules de convection (pour π1 Gruis) ou des éjections massives.

Article écrit par James LEQUEUX │ Observatoire de Paris-PSL

Pour en savoir plus :

– Lequeux J., Hippolyte Fizeau – Physicien de la lumière, EDP Sciences, 2014.

– https://www.eso.org/public/images/ (voir les textes accolés aux images).

par Sylvain Bouley | Avr 30, 2025 | Zoom Sur

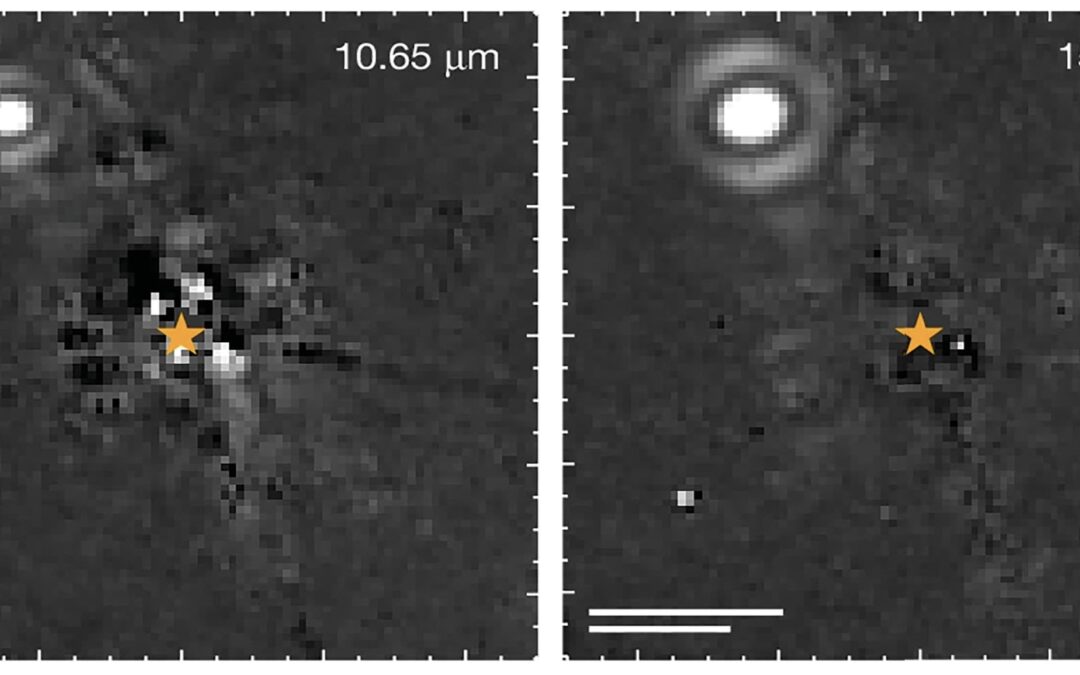

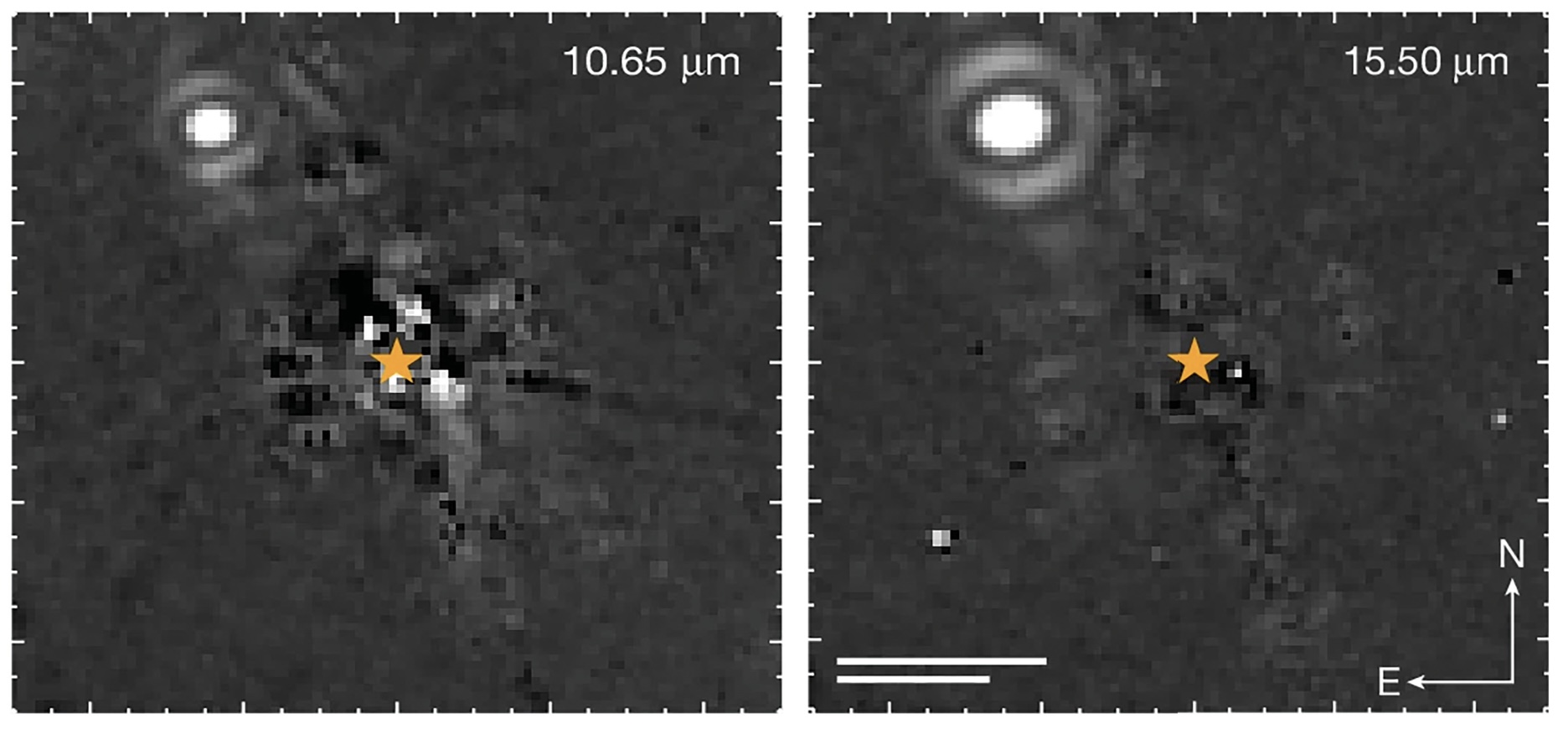

Une équipe internationale vient de détecter une planète géante autour d’une étoile âgée de seulement 3 millions d’années. Cette observation confirme que la formation des planètes est un processus très rapide.

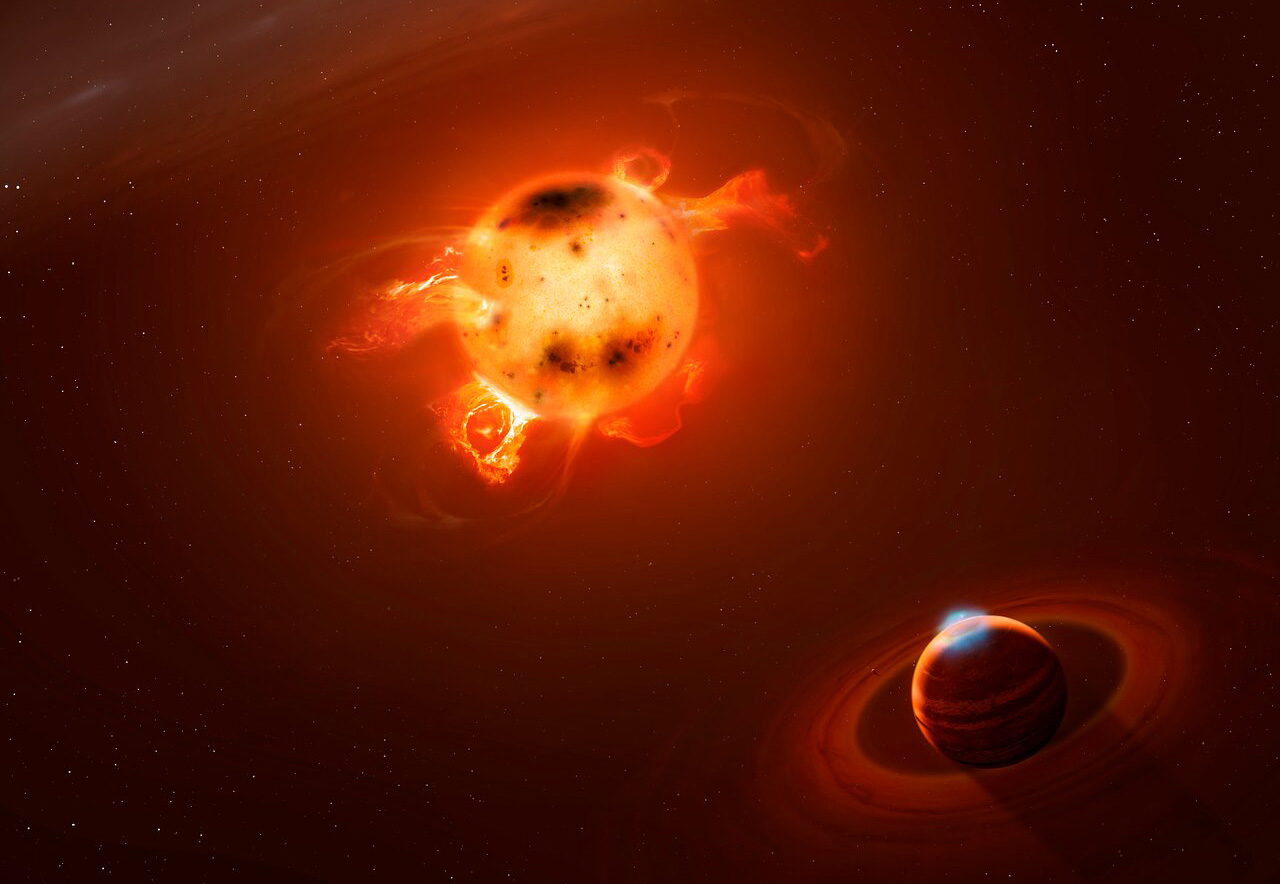

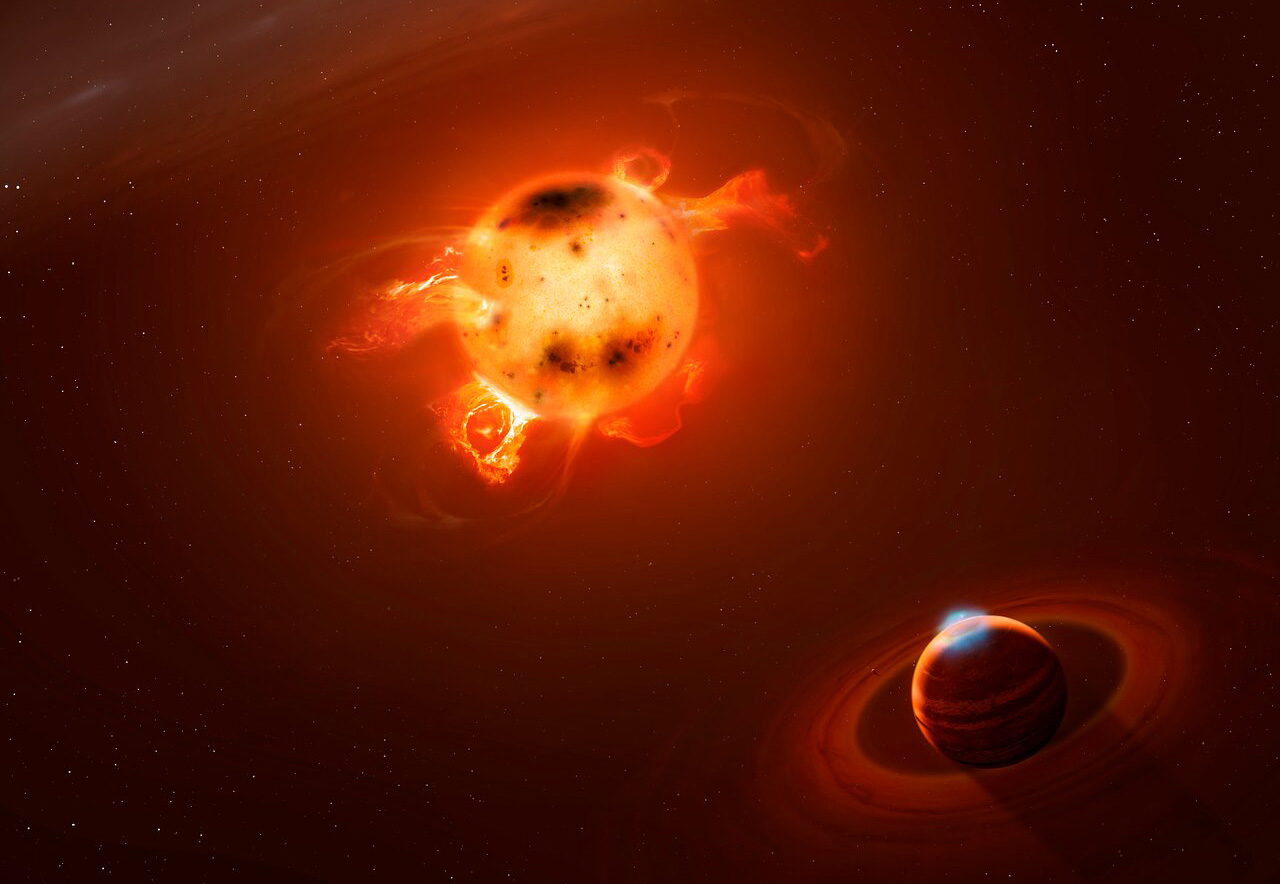

Vue d’artiste d’une planète orbitant autour d’une étoile de type T Tauri. (Crédit : Mark A. Garlick)

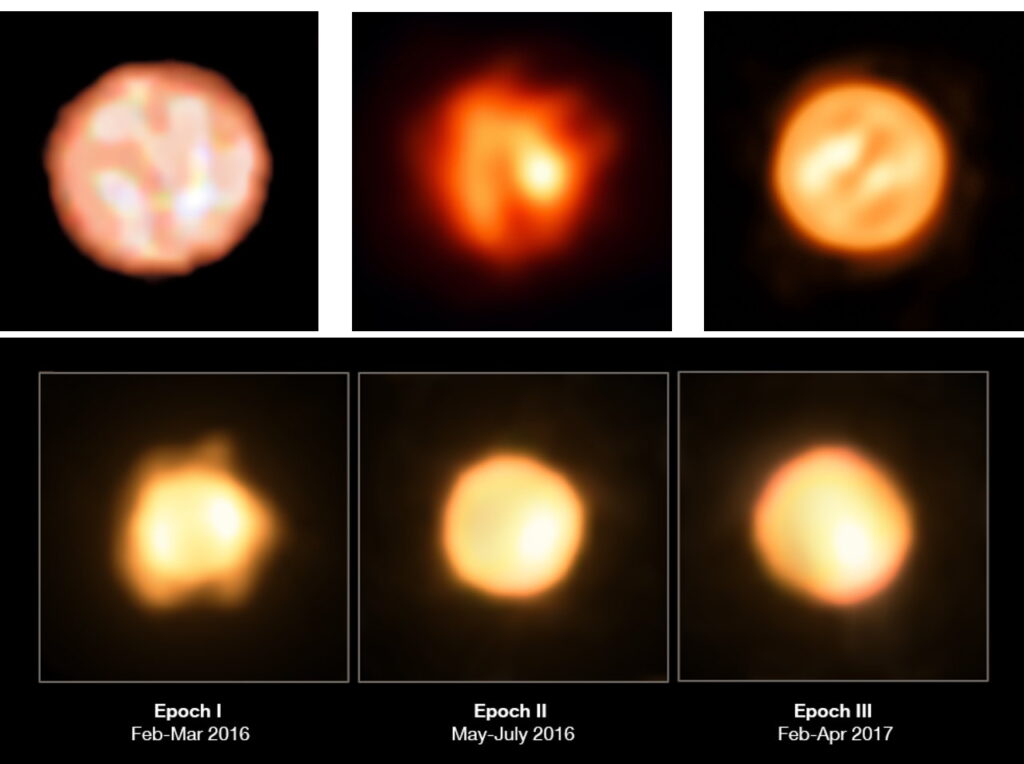

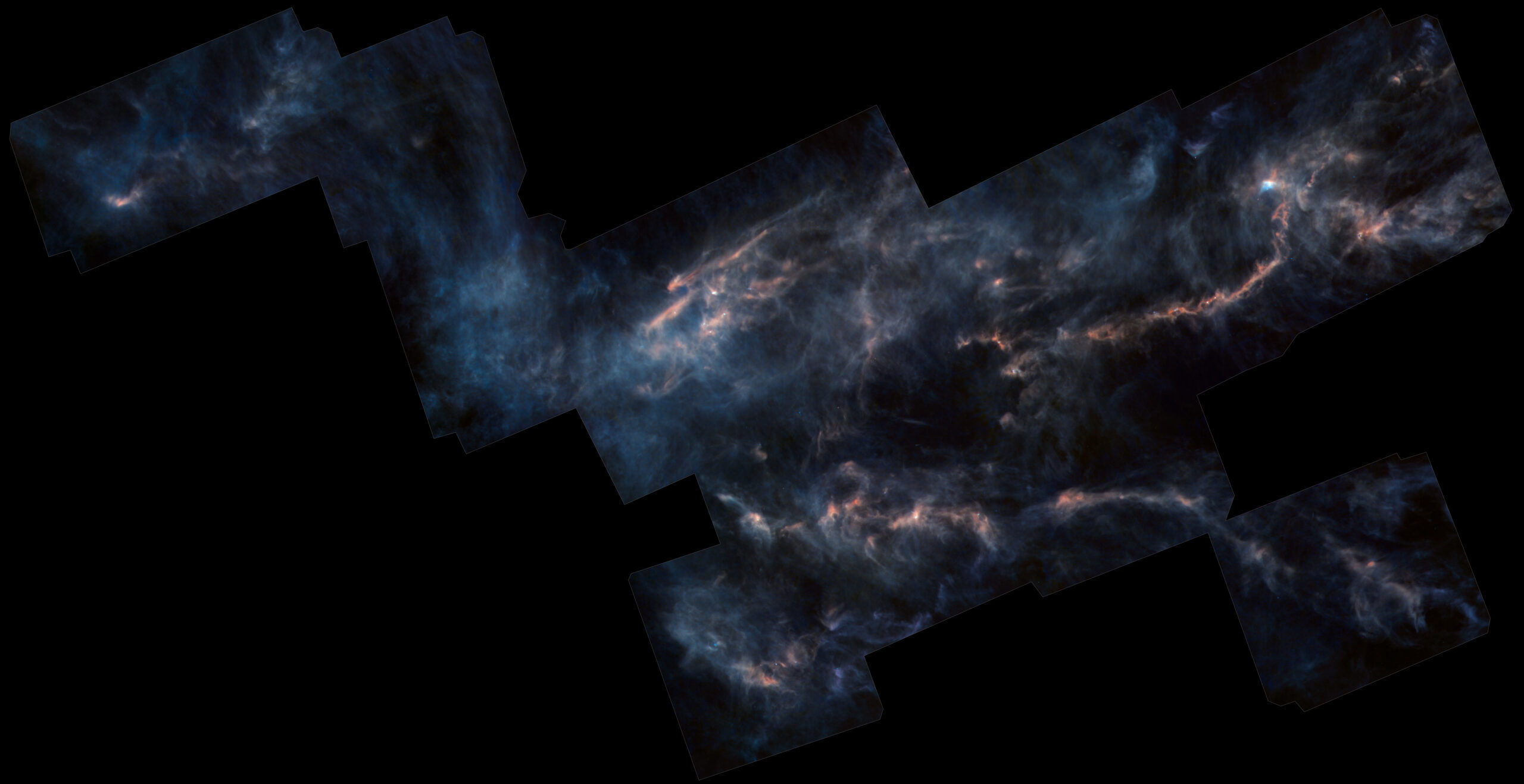

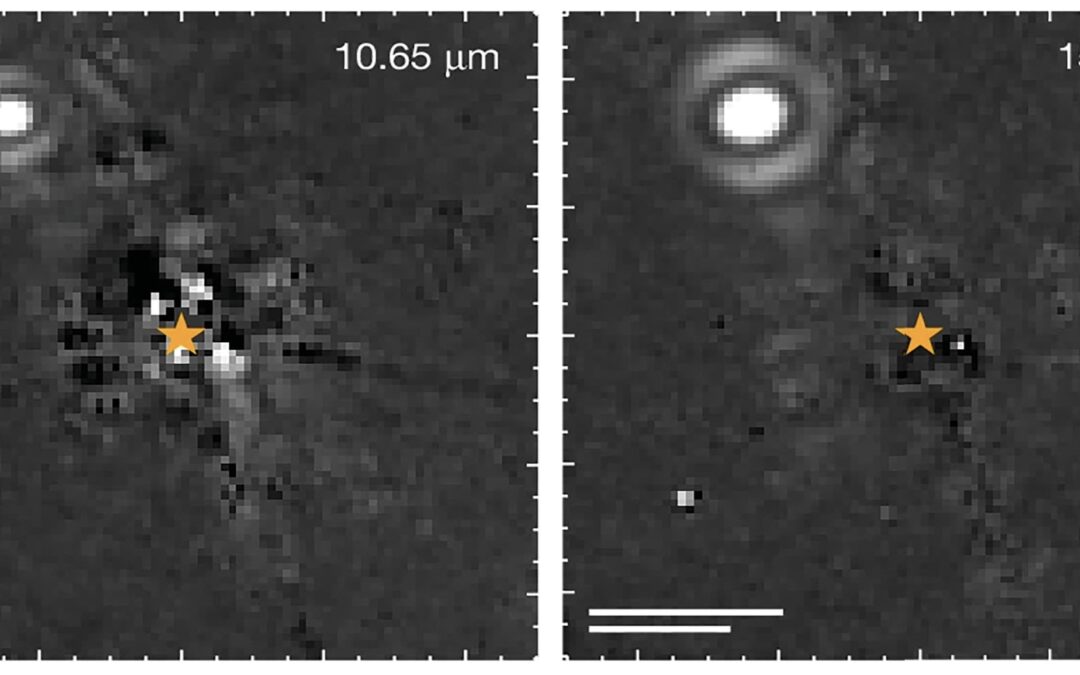

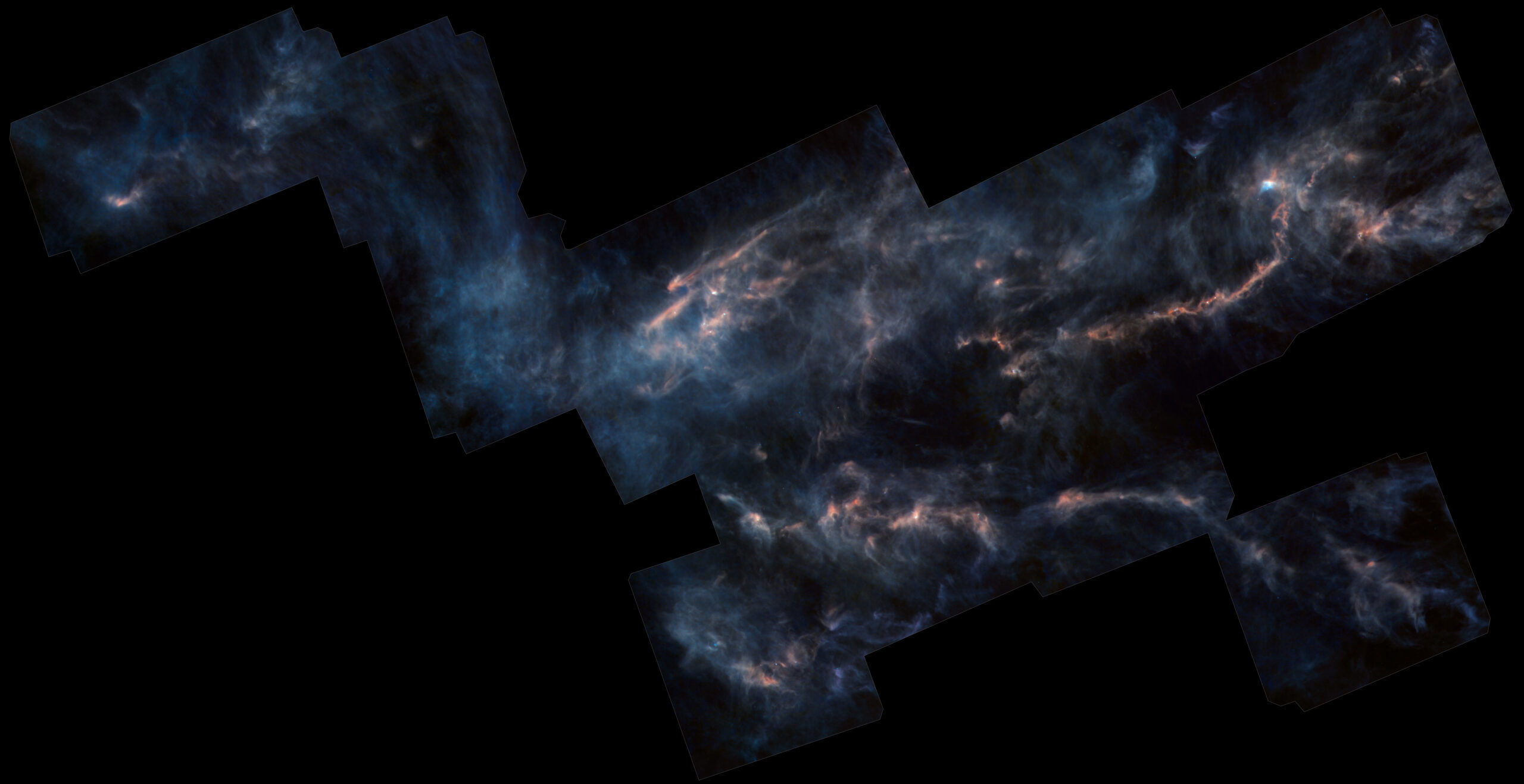

IRAS 04125+2902 est un système binaire (fig. 1) situé dans la constellation du Taureau à environ 520 années-lumière de nous, et dont la composante principale est une très jeune étoile légèrement moins massive que le Soleil (0,7 masse solaire). Elle appartient au nuage Taurus-Auriga, véritable pouponnière d’étoiles (fig. 2). Ses propriétés spectrales et sa luminosité confirment sa grande jeunesse, seulement 3,3 millions d’années (Myr), et la classe parmi les étoiles (ou protoétoile) de type T Tauri. Ces étoiles sont des cibles de choix pour étudier les premières étapes de l’évolution des systèmes stellaires et de la formation des planètes. Des disques stellaires ont ainsi été détectés autour de plusieurs étoiles de Taurus-Auriga âgées de 1 à 3 Myr, ainsi que la présence, jusqu’à présent non confirmée, de quelques planètes. Une étude publiée dans la revue Nature vient de montrer qu’une planète géante orbite bien autour d’IRAS 04125+2902 [1].

1. Le système binaire IRAS 04125+2902 vu par Pan-STARRS. La composante principale, au centre, est une étoile de type T Tauri légèrement moins massive que le Soleil. (Crédit : Pan-STARRS & Meli Thev)

Une planète géante autour d’IRAS 04125+2902

IRAS 04125+2902 a fait l’objet d’une campagne d’observation menée avec le télescope TESS (Transiting Exoplanet Survey Satellite) de la Nasa dès novembre 2019. Par la suite, TESS a détecté une vingtaine de transits sur cette étoile, c’est-à-dire de légères baisses périodiques de sa luminosité trahissant la présence d’une planète autour d’elle. L’analyse de ces transits, combinée avec d’autres observations réalisées avec les instruments de l’observatoire de Las Cumbres (un réseau international de télescopes robotisés répartis sur la planète), a permis de confirmer l’existence d’une planète, IRAS 04125+2902b, autour de la jeune étoile. Cette planète est légèrement plus petite que Jupiter (son rayon est estimé à 0,96 fois celui de Jupiter), et elle accomplit une orbite en un peu moins de 9 jours. Sa masse a pu, elle aussi, être estimée et se situerait autour de 0,3 fois la masse de Jupiter. Pour autant, IRAS 04125+2902b n’est sans doute pas une géante gazeuse analogue à Jupiter ou Saturne. On s’attend en effet à ce que les planètes géantes évoluent beaucoup au début de leur histoire, et notamment que leur rayon diminue fortement pendant les premières centaines de millions d’années de leur existence. Les observations disponibles semblent montrer que les planètes âgées de 10 à 700 Myr sont plus grosses et moins denses que les planètes plus anciennes. Par exemple, le rayon d’une planète de masse équivalente à celle de Jupiter pourrait, quelques dizaines de millions d’années après sa formation, atteindre jusqu’à 2 fois le rayon actuel de Jupiter avant de décroître jusqu’à sa valeur actuelle. Les astronomes pensent donc qu’IRAS 04125+2902b évoluera vers une planète de type mini-Saturne (de 4 à 7 fois le rayon de la Terre) ou mini-Neptune (de 1,5 à 4 rayons terrestres).

2. Le nuage moléculaire Taurus-Auriga, dans lequel de nombreuses étoiles sont en cours de formation. (Crédit : ESA/Herschel/JPL-CalTech, R. Hurt)

La détection d’IRAS 04125+2902b accrédite l’hypothèse que les planètes (et notamment les planètes géantes) se sont formées très rapidement, en seulement quelques millions d’années. Elle accrédite aussi le scénario de formation par « accrétion de petits grains », qui prévoit justement une formation très rapide (de 3 à 5 Myr au maximum) des planètes (voir encadré). Ce scénario est basé sur l’accrétion initiale (et rapide) de petits grains de matière conduisant à la formation de petits objets de quelques centaines de kilomètres de diamètre. Passé cette étape, ces objets grossissent en aspirant les grains de matière situés dans leur entourage. L’efficacité de ce modèle repose en grande partie sur la migration de grains de matière de la partie externe du disque protoplanétaire vers sa partie interne, migration rendue possible par les forces de frottement induites par les gaz contenus dans le disque.

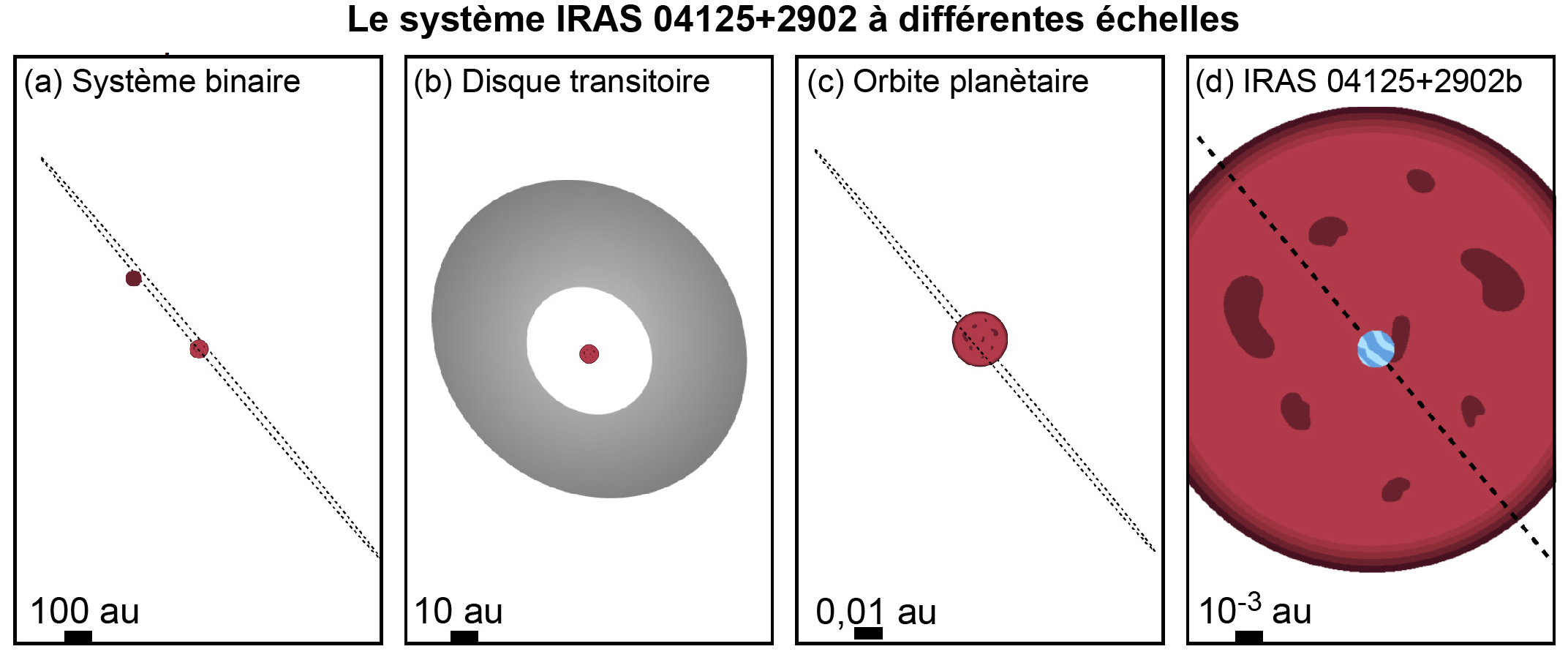

3. Configuration du système IRAS 04125+2902. De gauche à droite : (a) la composante principale et la composante binaire ; (b) le disque transitoire avec sa cavité centrale ; (c) l’orbite de la planète IRAS 04125+2902b ; et (d) IRAS 04125+2902b en transit. Fait important, pour une raison encore inexpliquée, les orbites du compagnon binaire et d’IRAS 04125+2902b ne sont pas alignées avec le plan du disque transitoire. (Crédit : Barber et al., 2024)

Un disque transitoire gauchi

Au cours du temps, les disques protoplanétaires se dissipent de l’intérieur vers l’extérieur. Cela crée, autour de l’étoile, une cavité temporaire dont le diamètre peut atteindre quelques dizaines d’unités astronomiques, étape aussi appelée « disque transitoire ». Les observations réalisées dans le domaine radio montrent que le disque d’IRAS 04125+2902 est justement en cours de dissipation. Aucune planète n’a pu cependant être observée par imagerie directe dans la cavité. On s’attend bien entendu à ce que les orbites des planètes formées à partir du disque protoplanétaire soient plus ou moins alignées avec le plan de ce disque. Au passage, cela rend la détection de ces planètes très difficile tant que le disque est toujours présent, ce dernier bloquant les rayonnements visibles et infrarouges. Or, si l’orbite d’IRAS 04125+2902b est bien vue par la tranche (de profil, ce qui permet d’observer ses transits), le disque transitoire est, lui, vu de face (fig. 3). Autrement dit, l’orbite de la première n’est pas alignée avec le plan du second. Ce décalage n’est, pour le moment, pas bien compris. Il est possible qu’au moment de sa formation, IRAS 04125+2902b ait été alignée avec le disque, mais qu’elle ait perdu cet alignement lors de sa migration vers la partie interne du système d’IRAS 04125+2902. Cette solution nécessiterait la présence d’un autre objet, relativement massif, dans ce système. Une autre hypothèse, que des simulations numériques semblent étayer, est que le disque ait été déformé et gauchi en interagissant avec son environnement extérieur, par exemple lors de la chute de matière depuis le nuage moléculaire environnant.

Deux scénarios de formation planétaire Il est aujourd’hui admis que les planètes (dont celles de notre Système solaire) se forment par accumulation (ou accrétion) de petits grains de matière contenus dans les disques de gaz et de poussières qui entourent les étoiles au tout début de leur histoire. Dans le cas du Système solaire, les météorites, dont la plupart proviennent de corps parents de quelques dizaines à quelques centaines de kilomètres de diamètre formés très tôt après l’allumage du Soleil, fournissent des informations clés sur les processus qui ont conduit à leur formation. Pour autant, il n’y a toujours pas de consensus quant aux détails de ces processus, et deux principaux scénarios sont toujours en compétition. Selon un premier scénario, connu sous le nom d’accrétion oligarchique, les collisions entre les petits grains de matière conduisent dans un premier temps à la formation de planétésimaux de quelques kilomètres, puis, en l’espace de quelques centaines de milliers d’années, à de petites planètes de tailles intermédiaires entre celles de la Lune et de Mars. Les collisions entre ces objets aboutissent in fine à des planètes rocheuses comme Mercure, Vénus, la Terre et Mars dans le Système solaire. Cette dernière phase est relativement longue, de 50 à 100 millions d’années (Myr), car si elles sont inévitables sur le long terme, les collisions entre petites planètes nécessitent également une part de hasard. Les planètes gazeuses, parce qu’elles sont situées au-delà de la ligne des glaces, se sont sans doute formées plus rapidement, en moins de 10 Myr. Dans ces régions, en effet, des noyaux solides plus volumineux et plus massifs que dans le Système solaire interne ont pu se former, précisément grâce à la présence de différents types de glaces (eau, méthane, etc.). Ces noyaux ont ensuite absorbé les gaz (hydrogène, hélium) présents dans leur environnement. Le second scénario, connu sous le nom de formation par accrétion de petits grains (pebble accretion), est beaucoup plus rapide, de 3 à 5 Myr au maximum. Il s’achève donc avant que les gaz du disque protoplanétaire se soient dissipés. Au départ, il est lui aussi basé sur l’accrétion rapide de petits grains de matière conduisant à la formation de petits objets de quelques centaines de kilomètres de diamètre. Ces derniers continuent ensuite à grossir en aspirant, sous l’effet de leur gravité, les poussières et les gaz présents autour d’eux. Comme dans le scénario d’accrétion oligarchique, les planètes géantes ont, dans un premier temps, acquis des noyaux solides plus volumineux, avant d’absorber les gaz environnants. En revanche, pour expliquer la présence de planètes rocheuses dans la partie interne des systèmes planétaires (comme dans le cas du Système solaire), le scénario par accrétion de petits grains suppose qu’une grande quantité de poussières a pu migrer du système externe vers le système interne. Cette migration est rendue possible par les forces de frottement induites par les gaz encore présents dans le disque, et qui ont pour effet de précipiter des poussières vers étoile centrale. Ces deux scénarios de formation se différencient ainsi par le mode d’accrétion lors de la phase finale (collisions entre planétésimaux vs absorption de grains), par leur durée, mais aussi par les compositions isotopiques des planètes et des météorites qu’ils impliquent. Plus précisément, les rapports d’abondance entre les isotopes de certains éléments dépendent de l’origine des matériaux utilisés pour former les planètes et les corps parents des météorites (voir l’Astronomie 177, décembre 2023). Toutefois, là aussi, les mesures disponibles ne permettent pas de conclure en faveur de l’un des deux scénarios : certaines analyses penchent pour l’accrétion oligarchique, tandis que d’autres favorisent l’accrétion de petits grains.

À ce jour, les observations disponibles ne permettent pas d’estimer la fréquence de ce type de configuration. On ne sait pas si le gauchissement du disque d’IRAS 04125+2902 est un cas plutôt commun ou, au contraire, très rare. De nouvelles mesures dans le domaine radio devraient toutefois apporter des précisions quant à l’alignement de ce disque.

Frédéric Deschamps, IESAS, Taipei, Taïwan

1. Barber M. G. et al., « A giant planet transiting a 3-Myr protostar with a misaligned disk », Nature, 635, 2024, 574-577.

Publié dans le magazine l’Astronomie

par Sylvain Bouley | Avr 30, 2025 | Zoom Sur

Le lancement du télescope spatial Hubble (HST, pour Hubble Space Telescope), le 24 avril 1990, a marqué le début d’une longue et fructueuse période scientifique, qui se poursuit de nos jours. Un rapide rappel en ce mois d’avril 2025 permet de retracer quelques grandes lignes de son histoire et des avancées permises en astronomie.

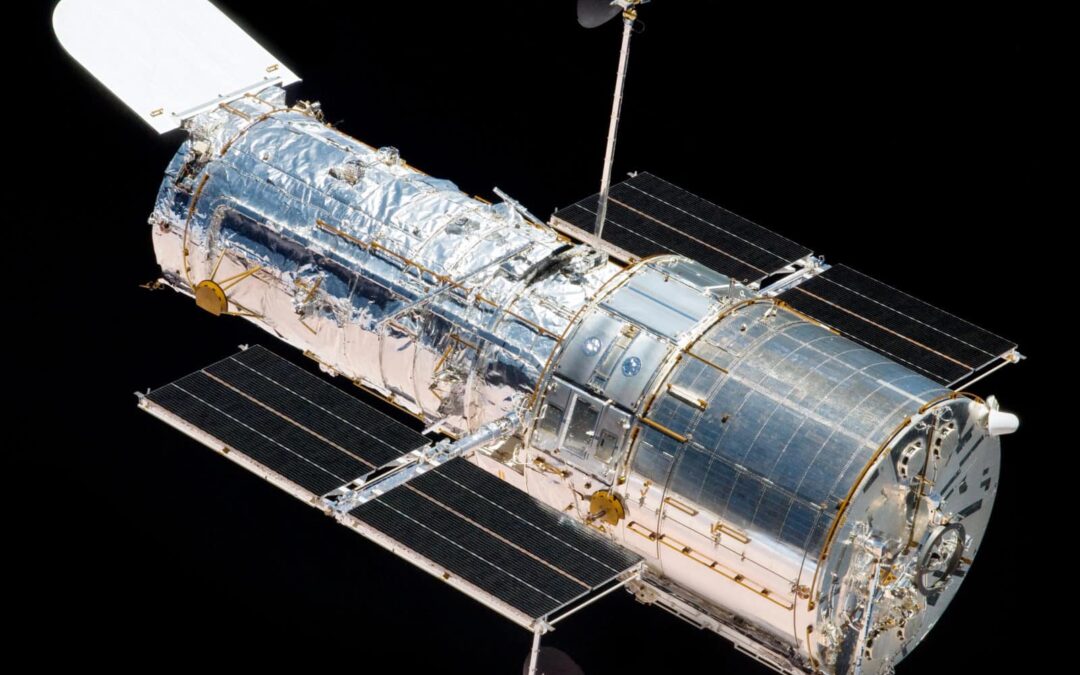

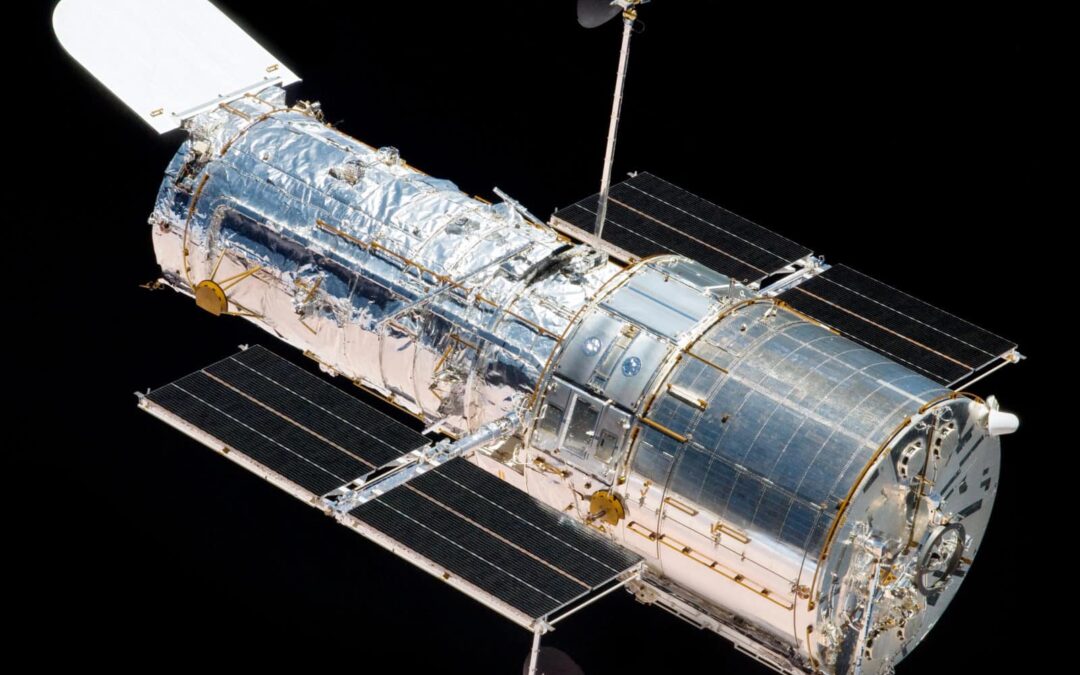

1. Photo du télescope Hubble prise durant la mission STS-125 depuis la navette spatiale Atlantis, le 19 mai 2009. (Crédit : NASA)

Le lancement du HST fait suite à la proposition en 1946 de l’astronome Lyman Spitzer de mettre un télescope en orbite autour de la Terre, avec deux avantages majeurs : tout d’abord, ne pas être perturbés par les turbulences atmosphériques qui limitent la résolution angulaire ; ensuite, avoir la possibilité d’observer les rayonnements infrarouge (IR) et ultraviolet (UV), qui sont pratiquement complètement interceptés par l’atmosphère.

Le démarrage, les soucis

Le HST a été conçu par la Nasa avec une participation de l’Esa (15 %) dans le cadre de son programme des Grands Observatoires (Great Observatories) [1] ; son développement a démarré en 1970, mais son lancement prit beaucoup de retard, pour des raisons de financement, à cause de mises au point techniques, mais surtout de l’accident de la navette Challenger en janvier 1986 [2]. Il fut donc repoussé jusqu’en 1990 (fig. 1). Dès le départ, il était prévu d’intervenir sur le télescope et de l’améliorer régulièrement, une fois placé sur son orbite à 515 km d’altitude, altitude suffisamment basse pour que des astronautes puissent intervenir rapidement. Cette orbite a varié au cours du temps entre 515 et 618 km.

Très rapidement après le décollage, des opérations de maintenance et d’entretien ont été nécessaires et la navette spatiale fut mise à contribution cinq fois, en 1993, 1997, 1999 (STS-103 avec le cosmonaute français Jean-François Clervoy, voir l’Astronomie 141, septembre 2020), 2002 et 2009. Pour chacune de ces opérations, plusieurs longues sorties extravéhiculaires furent nécessaires pour réparer ou remplacer équipements ou instruments défaillants. Cela fut rendu impossible après 2011 et l’arrêt de la navette spatiale américaine qui permettait les allers-retours réguliers entre la Terre et l’ISS. La dernière mission de maintenance, STS-125, en mai 2009, permit à Hubble de fonctionner encore de nombreuses années.

Qui dit télescope dit miroirs. Le miroir principal de Hubble a un diamètre de 2,4 m, ce qui permet une résolution angulaire inférieure au dixième de seconde d’arc, puisque Hubble évolue loin de la turbulence atmosphérique. Toutefois, très vite, une aberration optique fut découverte sur l’un des deux miroirs, qui empêchait d’obtenir des images nettes. En 1993, la première mission d’entretien, STS-61, avait pour but de réparer ce défaut ; il fallut ensuite remplacer le spectrographe haute résolution et le spectrographe pour objets faibles (STS-82) ; enfin fut rajoutée une nouvelle caméra infrarouge à un spectrographe multi-objets (Near Infrared Camera/Multi-Object Spectrograph, NICMOS), pour observer les galaxies très lointaines.

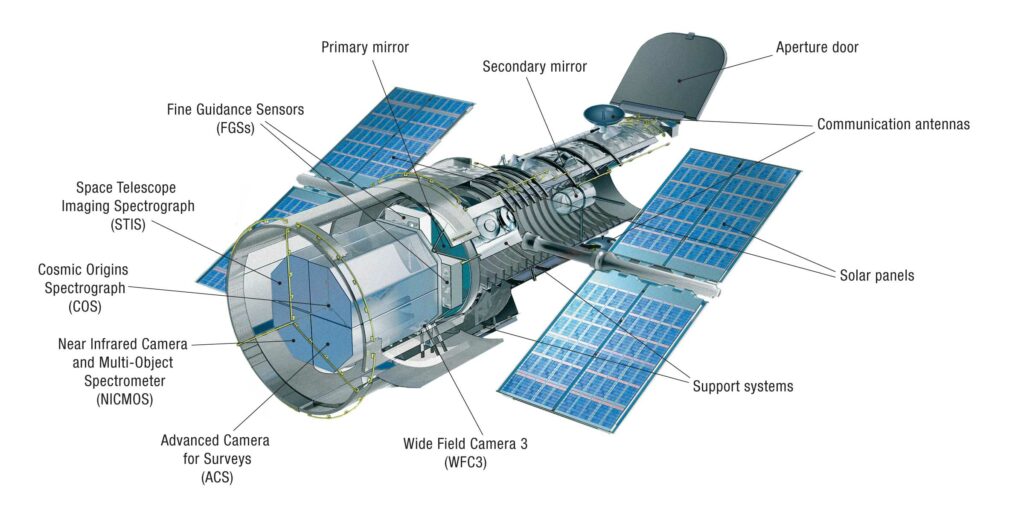

Les instruments à bord

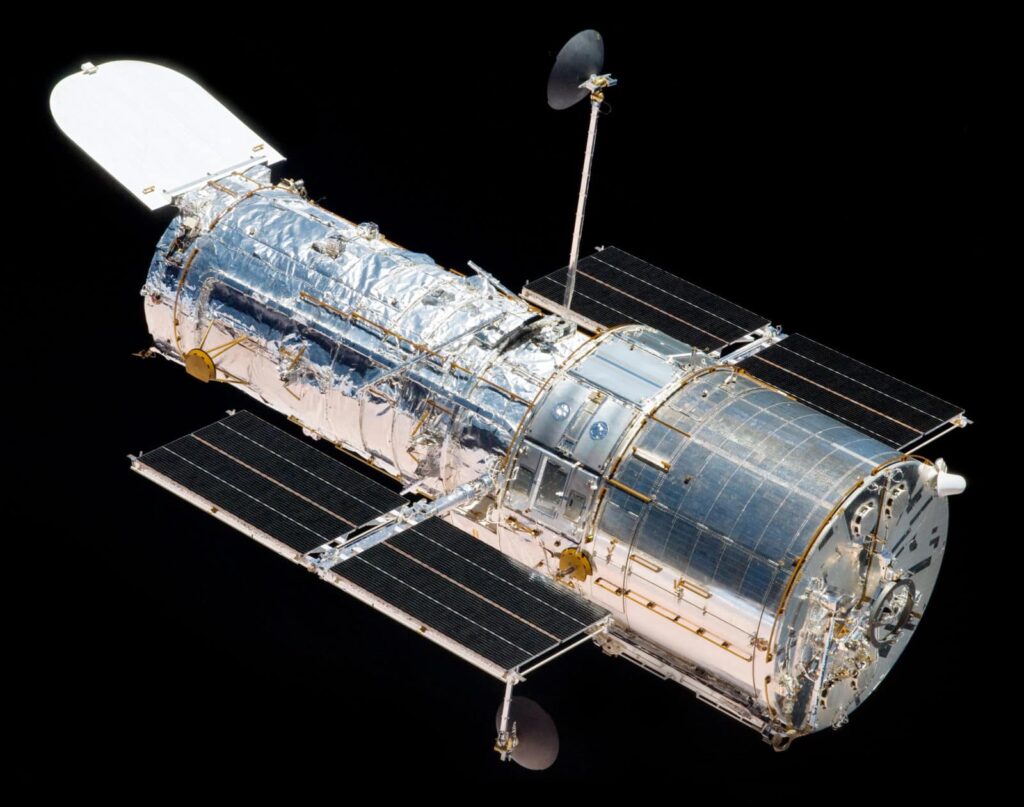

Le télescope spatial est un assemblage de pièces mécaniques et optiques d’une trentaine de mètres de longueur (fig. 2) ; sa partie optique est un dispositif à deux miroirs, qui permet de réfléchir la lumière incidente reçue par le miroir primaire vers le miroir secondaire pour enfin atteindre le plan focal du télescope où elle est collectée ; de là, un jeu de miroirs permet de renvoyer la lumière vers les instruments qui analysent les différentes longueurs d’onde de la lumière reçue, de l’UV au visible et au proche IR : comme des caméras ou des spectrographes, qui font de Hubble un véritable observatoire capable d’examiner les objets célestes avec une extrême finesse. Une caméra infrarouge couplée à un spectrographe multi-objets (NICMOS, susmentionné) permet d’observer les galaxies très lointaines.

2. Schéma précisant la disposition des instruments à l’intérieur du HST. Ils sont dans des conteneurs aisément déplacés. Légendes depuis le panneau de protection du télescope (aperture door), dans le sens des aiguilles d’une montre : antennes de communication, panneaux solaires, cases à équipements, caméra à large champ WFC3, caméra ACS, caméra et spectromètre NICMOS, spectromètre ultraviolet COS, caméra et spectromètre STIS, capteurs fins de guidage, miroir primaire, miroir secondaire. (Crédits : NASA & ESA)

Comme dit plus haut, la grande taille du miroir primaire permet d’obtenir des images avec une excellente résolution angulaire inférieure au dixième de seconde d’arc ; les observations à l’aide de caméras et de spectrographes vont de l’IR proche à l’UV. Les données collectées par Hubble ont contribué à des découvertes de grande portée dans le domaine de l’astrophysique. Chaque instrument a été conçu pour observer l’Univers, à l’aide de caméras. Le détail des instruments peut être retrouvé sur le site de la Nasa [3].

L’apport de Hubble

Les apports scientifiques de Hubble sont immenses dans tous les domaines de l’astronomie ; il suffit pour s’en convaincre de survoler les numéros de l’Astronomie de ces dernières années, il est rare que n’y figure pas un article s’appuyant sur des observations de ce télescope, que ce soit en imagerie ou en spectroscopie ; très souvent, l’image du mois est une illustration issue de Hubble, comme dans le numéro 191 de mars dernier où figurent LEDA 1313424 et ses anneaux.

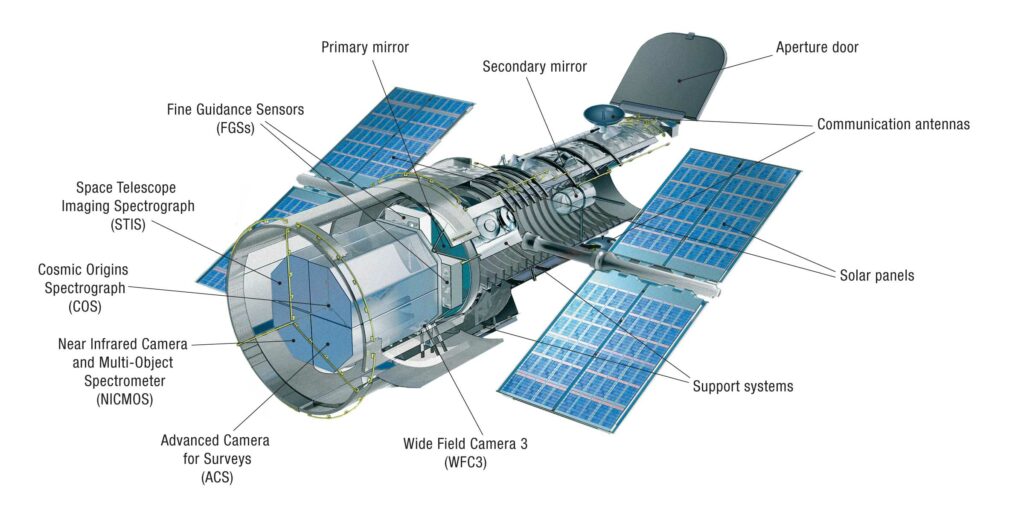

Dès les années 1980 avaient été définis par la Nasa et un collectif d’astronomes trois thèmes à traiter en priorité : l’étude du milieu intergalactique proche, une étude des champs profonds, c’est-à-dire des régions stellaires les plus reculées, et la détermination de la constante de Hubble. Le contrat a été rempli au-delà des espérances. Mais Hubble est aussi à l’origine de découvertes importantes concernant les exoplanètes et notre Système solaire ; chacun se souvient des photos de la comète Shoemaker-Levy 9 se disloquant et entrant en collision avec la planète Jupiter (fig. 3). En plus de l’imagerie, la spectroscopie a permis des avancées importantes dans la connaissance des atmosphères des exoplanètes ou des pépinières d’étoiles.

3. Impacts de la comète Shoemaker-Levy 9 sur Jupiter en juillet 1994. Image prise avec la caméra WFPC de Hubble. (Crédits : NASA & ESA/Hubble)

La collaboration avec le JWST

Le télescope spatial James-Webb (JWST), lancé depuis la base spatiale de Kourou le 25 décembre 2021, a été conçu pour prendre la suite de Hubble. Ses premières observations sont arrivées à l’été 2022 ; il est dix fois plus sensible, collecte une image plus rapidement que Hubble, effectue ses observations depuis l’orange de la lumière visible jusqu’à l’IR moyen et élargit ainsi la gamme de longueurs d’onde au-delà du visible, ce qui doit permettre de nouvelles observations de quantité d’objets : les galaxies, lointaines ou pas, les atmosphères d’exoplanètes ou encore les planètes du Système solaire. Un exemple de cette complémentarité est illustré sur les figures 4a et 4b, représentant la galaxie de la Roue du chariot qui se trouve à 500 millions d’années-lumière de la Terre, immortalisée à la fois par Hubble en 2010 (fig. 4a) et par le JWST en 2022 (fig. 4b). Sur l’image fournie par Hubble en 2010, on devinait sans la voir précisément, dans les zones noires à l’intérieur du grand cercle bleu, de la poussière, résultat d’une collision entre la galaxie de la Roue du chariot et une autre galaxie.

4a. Image de la galaxie de la Roue de chariot obtenue grâce à Hubble publiée en 2010. On devine de la poussière à l’intérieur du grand cercle bleu. (Crédits : NASA & ESA)

4b. Image de la galaxie de la Roue de chariot obtenue grâce au JWST, publiée le 2 août 2022, qui montre les zones denses en gaz et en poussière beaucoup plus explicitement. De plus, des dizaines de galaxies lointaines ont été rendues visibles dans le fond qui apparaissait noir sur le cliché pris par Hubble. (Crédit : NASA)

L’association Hubble-JWST et leur complémentarité ont ouvert une ère très riche d’avancées en astronomie.

Janet BORG | Institut d’astrophysique spatiale

Notes

- Le programme des Grands Observatoires de la Nasa comprend quatre grands et puissants télescopes spatiaux lancés entre 1990 et 2003, couvrant un large domaine de longueurs d’onde : Hubble (UV, visible et proche IR), Compton Gamma-Ray Observatory (rayonnement gamma), Chandra (rayons X mous) et Spitzer (IR).

- Accident astronautique qui eut lieu le 28 janvier 1986 et qui se traduisit par la désintégration de la navette spatiale Challenger de la Nasa, 73 secondes après son décollage, et la mort des sept astronautes de l’équipage de la mission STS-51-L.

- [https://hubblesite.org/mission-and-telescope/instruments].

Publié dans le magazine l’Astronomie

par Sylvain Bouley | Avr 30, 2025 | Zoom Sur

L’âge du Système solaire est aujourd’hui estimé à 4,567 milliards d’années. La détermination de cet âge, ainsi que les datations d’autres événements très anciens ont été rendues possibles grâce à la mise au point de chronomètres géochimiques très précis basés sur la désintégration de certains isotopes radioactifs.

Vue d’artiste de la nébuleuse protosolaire. (Crédit : NASA/JPL-Caltech)

On sait aujourd’hui que la Terre est âgée d’environ 4,55 milliards d’années (Ga). La naissance du Système solaire est nécessairement antérieure, et on l’estime à 4,567 Ga (un chiffre particulièrement facile à retenir…). À l’échelle de la vie humaine, ou même de la durée d’une civilisation, il est difficile d’imaginer ce que représentent ces âges plus que canoniques. Et comme pour accentuer le caractère insondable de ces durées, on ne disposait pas, jusque vers le début du xxe siècle, de méthode fiable pour les évaluer. Comme nous allons le voir, les datations du Système solaire, de la Terre, ainsi que celles d’autres événements très anciens découlent de la découverte de la radioactivité au tournant des xixe et xxe siècles. Toutefois, si les scientifiques ont vite compris qu’ils pourraient établir des chronomètres à partir de la désintégration radioactive de certains éléments, la mise au point de ces chronomètres a pris plusieurs décennies [1], et la précision actuelle des mesures nécessite des appareils extrêmement performants.

Isotopes radioactifs et chronomètres géochimiques

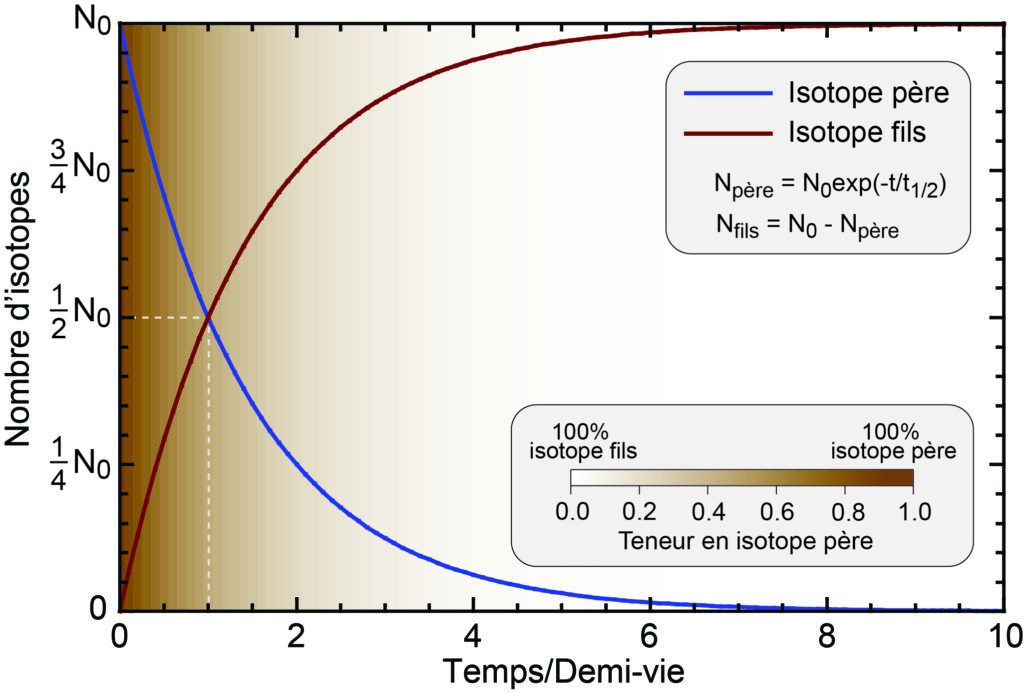

Avant d’entrer plus en détail dans les méthodes de datation, il est important de revenir sur la notion d’isotope radioactif. Rappelons pour commencer que les isotopes d’un élément donné sont des atomes qui possèdent le même nombre de protons (et donc le même numéro atomique, qui définit l’élément en question), mais un nombre de neutrons différent, et donc une masse différente. Certains isotopes sont instables, c’est-à-dire qu’ils se transforment en un autre élément (leur numéro atomique change) soit par émission d’un noyau d’hélium (radioactivité α ; le numéro atomique de l’élément diminue de deux unités), soit par transformation d’un neutron en proton avec émission d’un électron (radioactivité β–, l’isotope « monte » d’un numéro atomique) ou d’un proton en neutron avec émission d’un positron (radioactivité β+ ; l’isotope « descend » un numéro atomique). C’est par exemple le cas du célébrissime isotope 14C du carbone (qui se désintègre par radioactivité β–), ainsi que des isotopes 26Al de l’aluminium (radioactivité β+), 40K du potassium (radioactivité β– et β+) et de tous les isotopes de l’uranium, dont le 235U et le 238U (radioactivité α). On ne peut pas prédire quand exactement un noyau particulier va se désintégrer. En revanche, on peut calculer précisément le temps nécessaire pour que la moitié d’une population initiale d’isotopes d’un élément donné se désintègre. Ce temps, appelé demi-vie, est différent pour chaque isotope. Il est par exemple de 5 700 ans pour le 14C et de 717 000 ans pour l’26Al, ce qui peut sembler très long, mais est très court à l’échelle des temps géologiques et en comparaison des demi-vies du 238U (0,7 Ga), du 40K (1,25 Ga) et du 238U (4,47 Ga) [2].

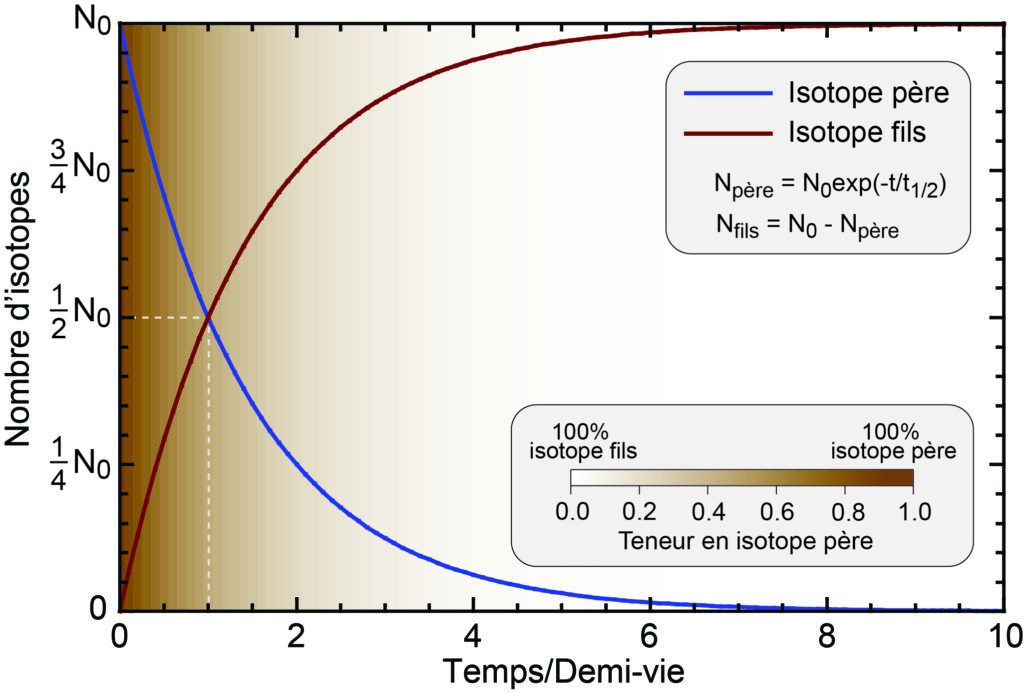

C’est cette propriété statistique : la demi-vie étant à la base des méthodes de datation (on parle aussi de chronomètre) géochimique, l’idée est que, si l’on connaît la quantité d’un isotope dans un échantillon de roche (ou autre) à l’instant où l’événement que l’on souhaite dater se produit, on peut, en mesurant la quantité de cet isotope encore présente aujourd’hui, en déduire le temps écoulé depuis cet événement (fig. 1). En fonction de l’ancienneté supposée d’un événement, on aura recours à des isotopes (chronomètres) de demi-vie plus ou moins longue. Le 14C est très prisé par les archéologues, car il permet de dater des échantillons préhistoriques (os, bois ou tout autre résidu de matière organique) jusqu’à environ 50 000 ans dans le passé. Pour les événements géologiques remontant à des millions, voire des milliards d’années, il faudra faire appel à des chronomètres impliquant des isotopes à longue durée de vie, comme les isotopes de l’uranium (235U et 238U), le 40K ou encore l’isotope 87Rb du rubidium, dont la demi-vie est de 49,7 Ga. Dit comme cela, tout paraît simple. Ça l’est beaucoup moins en pratique, la difficulté principale (mais pas unique) étant de déterminer les teneurs initiales des isotopes impliqués dans les chaînes de désintégration que l’on souhaite utiliser. Pour contourner cette difficulté, les scientifiques ont recours à différentes astuces. Avant d’illustrer cela avec un chronomètre particulièrement important, remontons le temps jusqu’au début du xxe siècle.

-

1. Décroissance radioactive d’un isotope père (courbe bleue) en un isotope fils (courbe rouge). L’axe des abscisses est gradué en unités de temps divisé par la demi-vie de l’isotope père, et le fond de couleur représente la teneur en élément père en fonction du temps. Le nombre d’isotopes pères diminue exponentiellement au cours du temps à partir d’une population initiale (de N0 atomes dans cet exemple). Ce nombre est divisé par deux après un temps égal à une demi-vie de l’isotope père (ligne en tirets), et au bout d’un temps égal à une dizaine de fois cette demi-vie, l’isotope père a quasiment disparu tandis que le nombre d’isotopes fils est très proche de N0. (Crédit : Frédéric Deschamps)

Un peu d’histoire

C’est Pierre Curie qui, le tout premier, a compris que la radioactivité pourrait être utilisée pour dater les roches de façon absolue. En 1902, alors que ce phénomène venait juste d’être découvert, il avait en effet remarqué que l’activité du radium diminuait de moitié tous les 4 jours environ [3]. Ernest Rutherford et Frédéric Soddy lui ont vite emboîté le pas, d’une part en montrant que le phénomène de radioactivité correspond à la transformation d’un élément père en un élément fils accompagnée de l’émission d’une particule énergétique (par exemple, un noyau d’hélium dans le cas de la radioactivité α), d’autre part en définissant le concept de demi-vie. Ils identifient également des chaînes de désintégration radioactives (plus précisément certaines étapes de celles-ci), en particulier celles de l’uranium et du thorium. En 1905, ces découvertes amènent Robert Strutt (Lord Rayleigh) à proposer une méthode de datation basée sur la mesure de la quantité d’hélium contenu dans les roches, méthode vite abandonnée, car il s’aperçoit que l’hélium contenu dans les roches peut facilement s’échapper vers l’atmosphère. De son côté, Bertram Boltwood parvient à établir que le produit final de la désintégration de l’uranium est le plomb. Il en déduit que la mesure des teneurs en ces éléments dans une roche devrait permettre de dater cette dernière. Les mesures qu’il réalise sur différents types de roches s’échelonnent entre 400 millions d’années (Ma) et 2,2 Ga. Un peu plus tard, entre 1908 et 1913, Soddy identifie des étapes supplémentaires des chaînes de désintégration, et propose le concept d’isotope, concept rapidement validé, notamment pour l’uranium et le plomb. Les travaux de Soddy ont aussi permis de clarifier les chaînes de désintégration radioactives en identifiant certains produits de ces chaînes à des isotopes d’éléments déjà connus [4]. Tous les ingrédients (ou presque) sont désormais en place pour mettre au point les méthodes de datation radioactive fiables et établir des échelles de temps géologiques (et planétologiques) absolues.

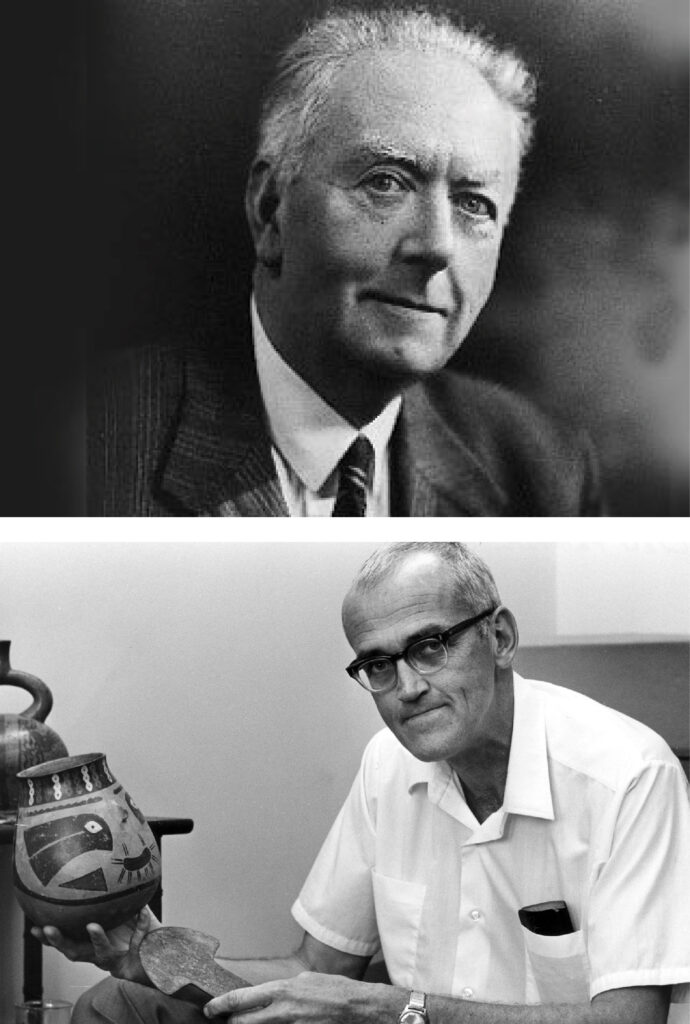

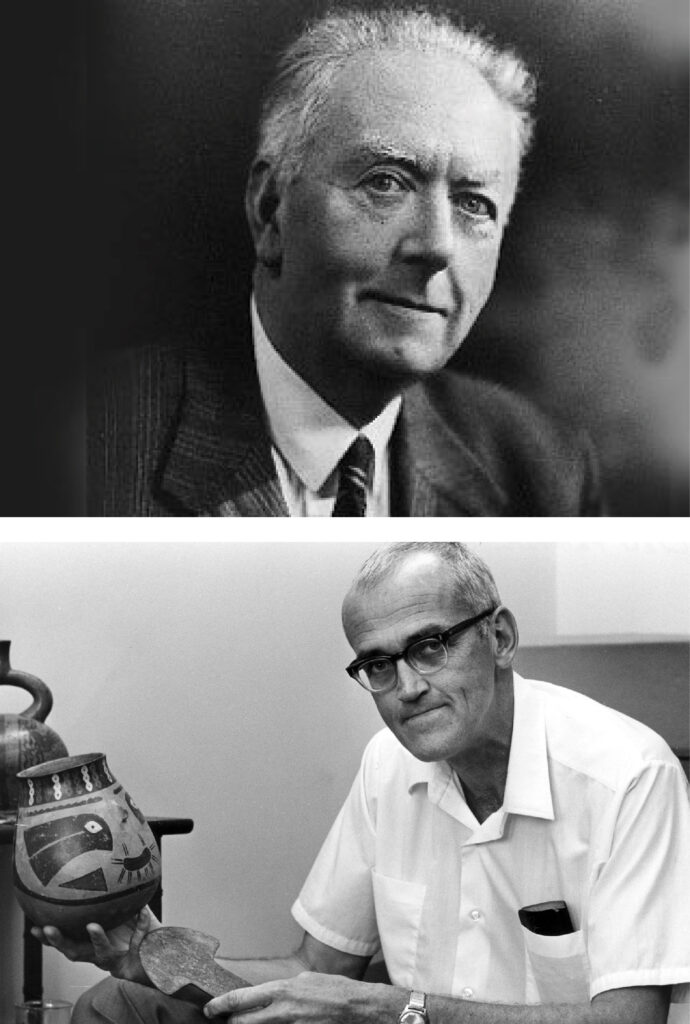

C’est à cela que s’attachera le géologue Arthur Holmes (fig. 2) pendant plus de trois décennies [5]. Dès 1911, Holmes entreprend de dater, à l’aide du chronomètre uranium-plomb (U-Pb), les roches caractéristiques des différentes strates (ou couches) géologiques. Jusqu’à l’avènement des datations radiochronologiques, la succession de ces couches offrait une chronologie relative permettant de classer les événements du plus jeune au plus ancien, mais pas de donner un âge à la Terre. En 1935, Holmes publie une échelle absolue jusqu’au début du Cambrien (qu’il estime à 510 Ma ; à comparer avec la valeur aujourd’hui admise de 542 Ma). Il remarque aussi que certaines roches (précambriennes) sont âgées de 1,9 Ga et plus, et que par conséquent la Terre et le Système solaire sont encore plus vieux. Toutefois, la précision de la méthode utilisée par Holmes repose sur l’hypothèse que tous les isotopes du plomb sont issus de désintégrations radioactives, ce qui est inexact. À partir des années 1940, géologues et physiciens cherchent donc un moyen de contourner ce problème. Holmes remarque qu’en utilisant conjointement les chaînes de désintégration des isotopes 235U et 238U, qui aboutissent chacune à un isotope différent du plomb, il est possible de déduire un temps absolu sans que l’on ait besoin de connaître les teneurs initiales relatives en ces isotopes. C’est essentiellement cette idée qui est mise en œuvre dans le chronomètre Pb-Pb (plomb-plomb), que nous allons maintenant décrire plus en détail.

2. À partir du chronomètre uranium-plomb (U-Pb), Arthur Holmes (en haut) a réalisé les premières datations absolues des séquences stratigraphiques établies par les géologues. Vers le milieu des années 1940, il a également développé le chronomètre plomb-plomb (Pb-Pb), simultanément et indépendamment mis au point par le physicien Friedrich Houtermans. Vers le milieu des années 1950, le géochimiste Clair Patterson (en bas) a affiné les méthodes de mesure, ce qui lui a permis de déterminer l’âge de la Terre en appliquant le chronomètre Pb-Pb aux météorites de Canyon Diablo. (Crédits : Geological Society of Glasgow et California Institute of Technology)

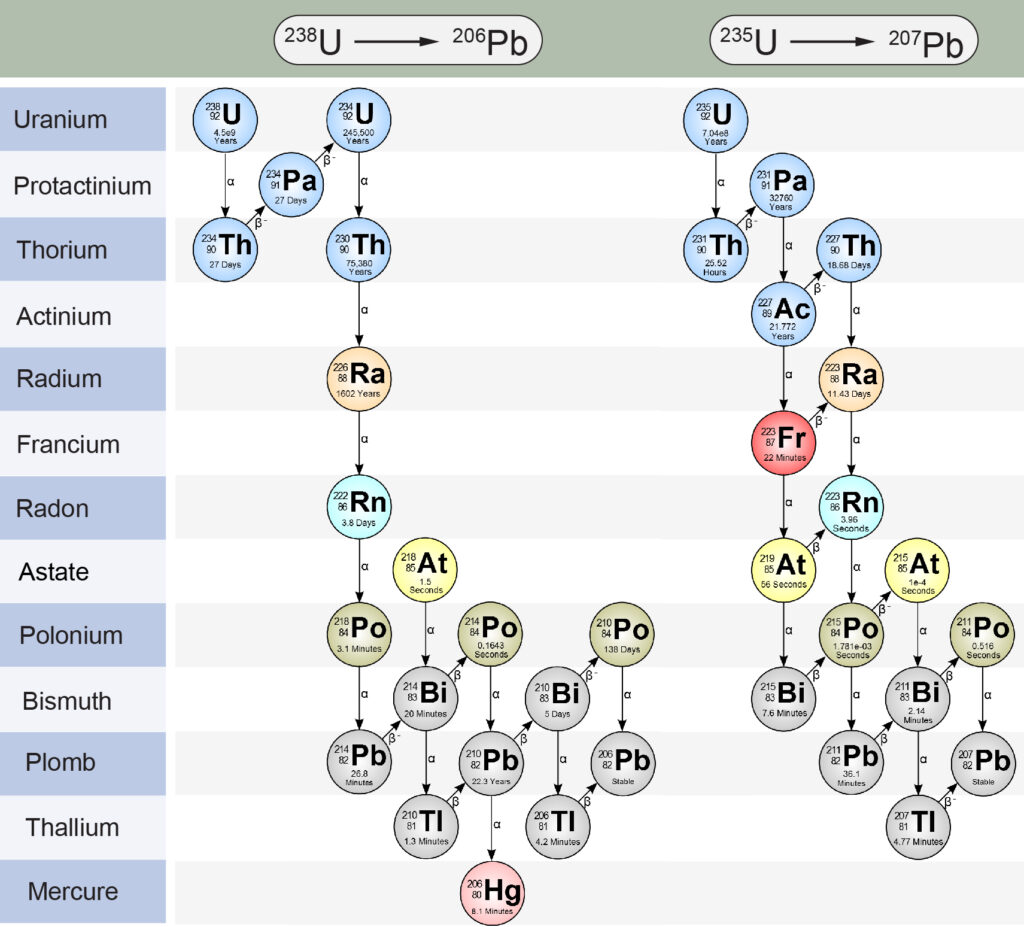

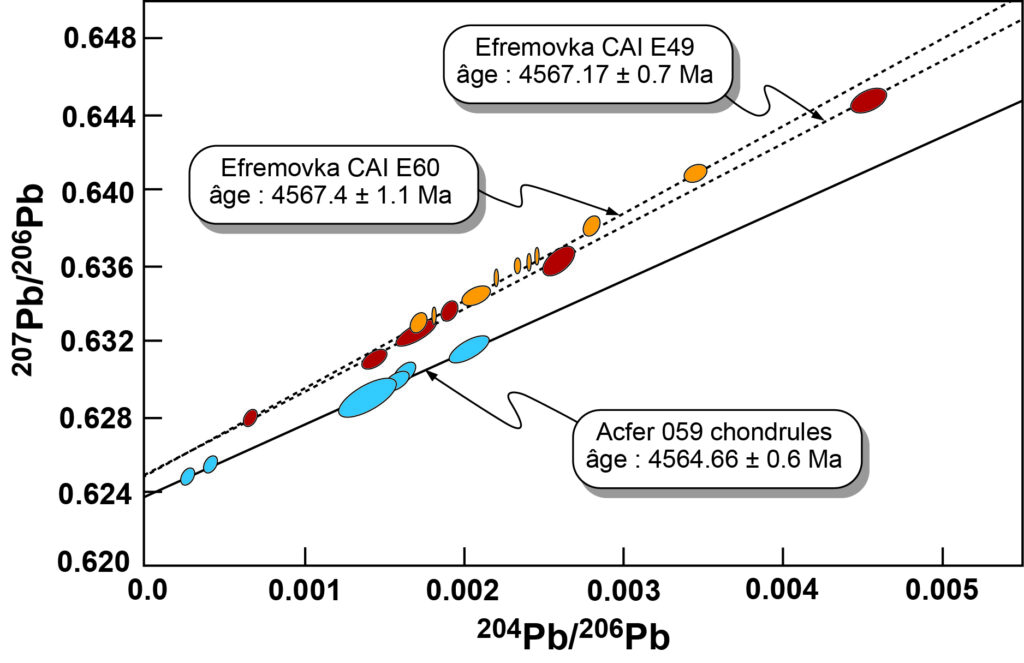

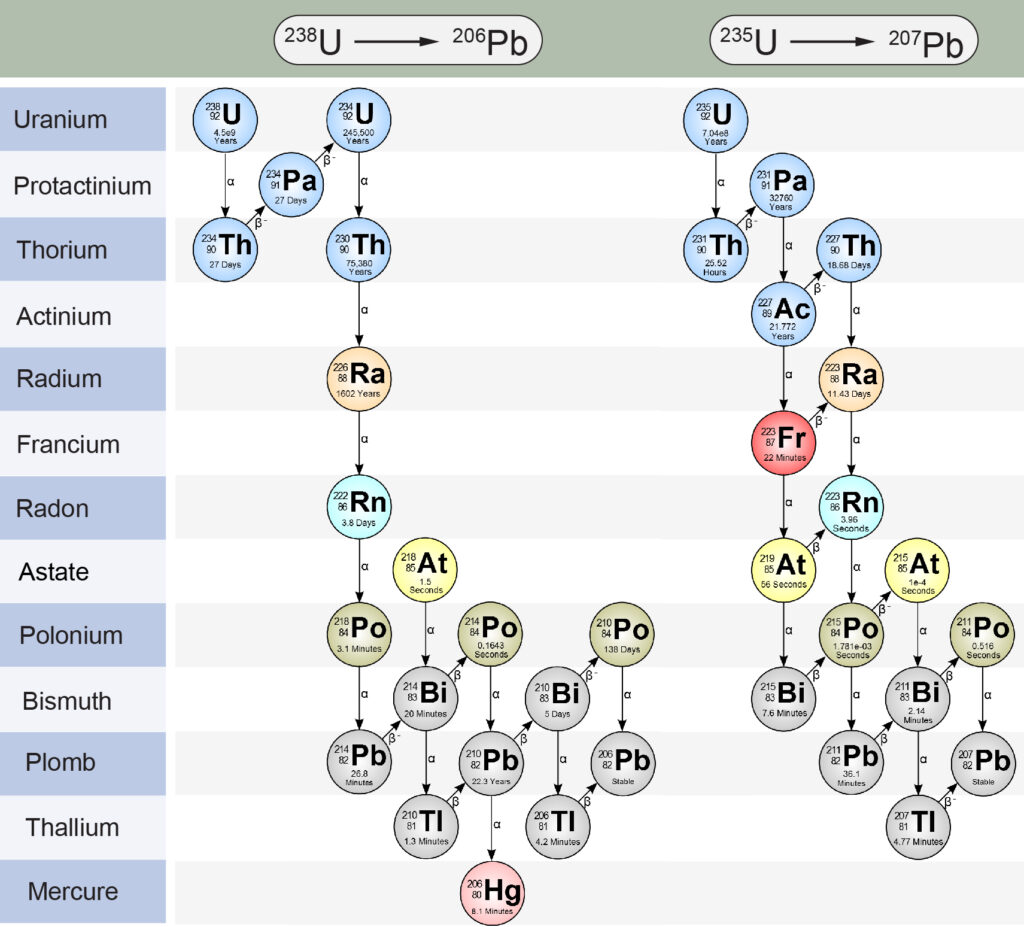

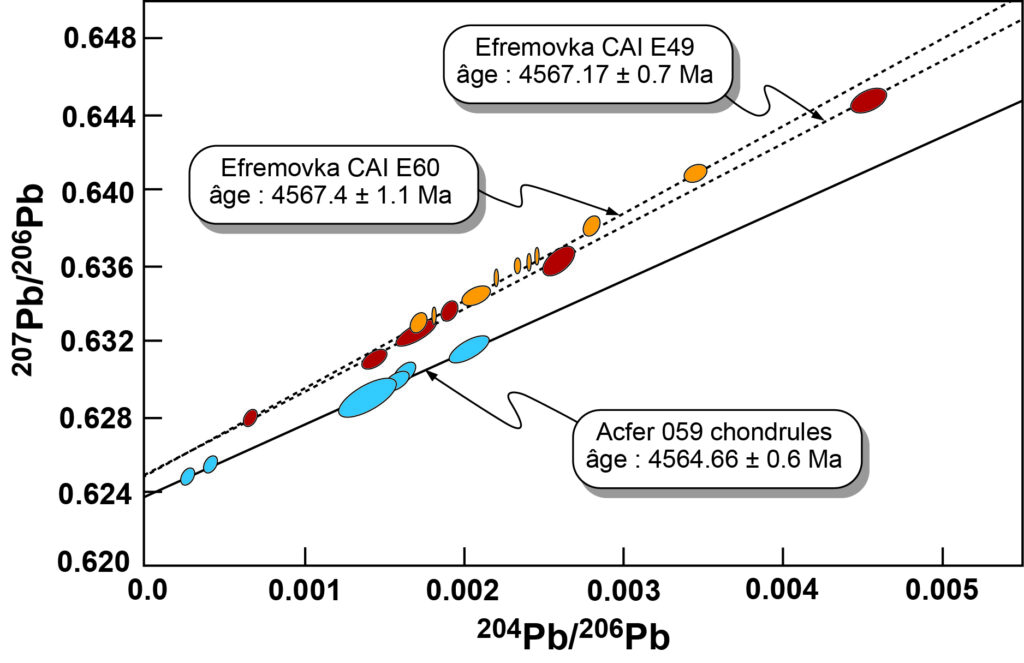

Le chronomètre Pb-Pb

Le chronomètre Pb-Pb, mis au point simultanément et indépendamment par Arthur Holmes et par le physicien Friedrich Houtermans dans les années 1940, est l’un des chronomètres les plus utilisés par les scientifiques pour dater les roches. Comme il est basé sur la désintégration des isotopes 235U et 238U de l’uranium (dont on a vu que les demi-vies sont très longues), ce chronomètre est particulièrement adapté à la datation des événements très anciens. Ainsi, c’est ce chronomètre que Clair Patterson (fig. 2) a utilisé en 1956 pour déterminer l’âge de la Terre à partir des météorites de Canyon Diablo. Il a également été utilisé pour dater les échantillons de roches lunaires rapportés par les missions Apollo et, plus récemment, par la sonde chinoise Chang’e-5. Pour contourner le problème des teneurs initiales en éléments père et fils (ici, les isotopes de l’uranium et du plomb), la méthode Pb-Pb combine deux chaînes de désintégrations radioactives (fig. 3) : d’une part, la désintégration de 235U en 207Pb via une dizaine de désintégrations intermédiaires, et d’autre part la désintégration de 238U en 206Pb, en passant, là aussi, par une quinzaine de réactions intermédiaires. Les isotopes 207Pb et 206Pb, dont on mesure les teneurs actuelles dans l’échantillon (roche terrestre ou météorite) que l’on souhaite dater, sont, évidemment, tous deux stables. Chacune de ces deux chaînes radioactives fait intervenir de nombreux isotopes intermédiaires, tous radioactifs, mais de demi-vies très inférieures aux demi-vies de 235U et 238U. Autrement dit, c’est la première étape de chacune de ces chaînes (désintégrations de 235U en 231Th, et de 238U en 234Th) qui contrôle les temps nécessaires à la formation et l’accumulation de 207Pb et 206Pb dans les roches. L’astuce consiste à mesurer aussi la teneur en 204Pb, un autre isotope du plomb, puis à calculer les rapports d’abondance 207Pb/204Pb et 206Pb/204Pb. Le 204Pb est lui aussi stable et surtout il n’est le produit d’aucune chaîne de désintégration radioactive. Sa teneur est donc restée la même au cours du temps, depuis la formation de la roche et jusqu’au moment de la mesure. Les mesures des teneurs en 204Pb, 206Pb et 207Pb sont ensuite répétées en différents points (minéraux) de la roche. On obtient alors des valeurs des rapports 207Pb/204Pb et 206Pb/204Pb a priori différentes pour chaque point, mais qui doivent s’aligner le long d’une droite. Cela tient au fait que lors de la formation de la roche, l’abondance totale en plomb (c’est-à-dire la somme des abondances de tous les isotopes de cet élément) a pu varier d’un endroit à l’autre de cette roche, tandis que les abondances relatives de chaque isotope étaient, elles, constantes. On peut alors montrer que la pente de cette droite ne dépend que du rapport actuel entre les isotopes 235U et 238U (235U/238U, lequel est remarquablement constant à 1/137,88 d’une roche ou d’une météorite à l’autre), et… du temps écoulé depuis la formation de la roche. La mesure de la pente de la droite 207Pb/204Pb vs 206Pb/204Pb, que l’on appelle aussi isochrone, permet ainsi de mesurer l’âge d’une roche. À noter que certains travaux préfèrent représenter 207Pb/206Pb en fonction de 204Pb/206Pb : la présentation est différente, mais la méthode reste la même.

3. Les chaînes de désintégration radioactives du 238U vers le 206Pb et du 235U vers le 207Pb impliquées dans le chronomètre Pb-Pb. Chacune de ces chaînes fait intervenir une succession de désintégrations α (émission d’un noyau d’hélium) et β– (transformation d’un neutron en proton), avec des demi-vies différentes (temps indiqué au bas de chaque case). Les demi-vies du 238U et du 235U étant beaucoup plus longues que celles des autres isotopes impliqués, la durée totale nécessaire pour aboutir au 206Pb et au 207Pb est largement dominée par la première désintégration de chaque chaîne (238U en 234Th et du 235U en 231Th). (Crédit : modifié d’après Washington University in St-Louis)

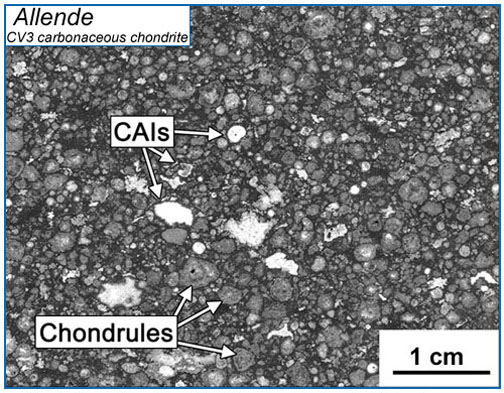

L’âge du Système solaire

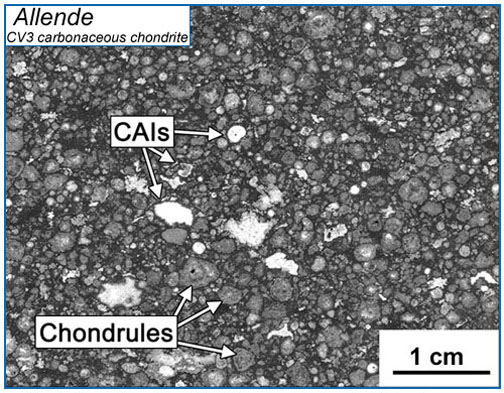

Il est maintenant temps de répondre à la question posée dans le titre de cet article. Le petit détour par le chronomètre Pb-Pb n’aura pas été inutile, car c’est précisément avec cette méthode appliquée aux inclusions calcium-aluminium (les fameuses CAI ; fig. 4) contenues dans certaines chondrites carbonées que plusieurs équipes ont pu, au début des années 2010, déterminer l’âge du Système solaire (fig. 5). Comme leur nom l’indique, les CAI sont composées de minéraux riches en calcium et en aluminium, qui sont très réfractaires (au sens physique de ce terme), car ils condensent à des températures supérieures à 1 700 K. C’est pourquoi on pense que ces grains sont les premiers matériaux à avoir condensé dans la nébuleuse protosolaire, et que cela a dû se produire très peu de temps après l’allumage du Soleil, alors que ce dernier était très actif. Par extension, leur formation est un excellent jalon pour dater la naissance du Système solaire, et ce d’autant plus que l’on peut, grâce au chronomètre Pb-Pb, mesurer leur âge de façon absolue.

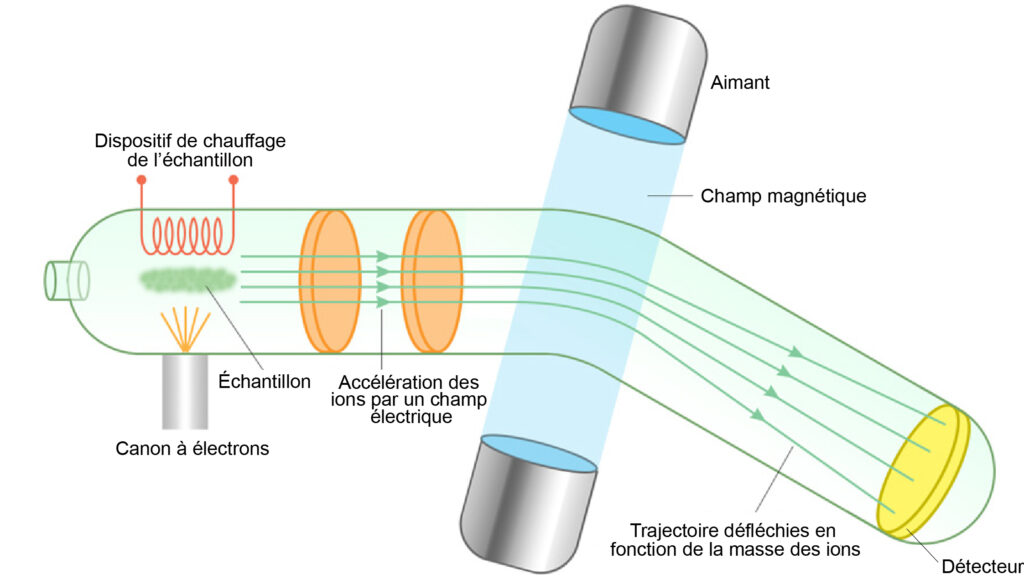

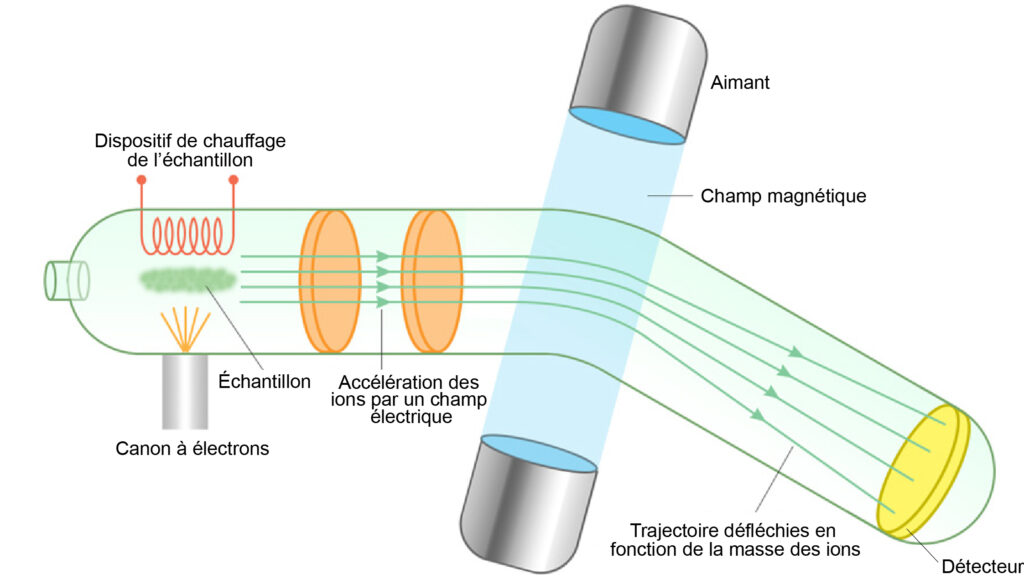

D’autres systèmes isotopiques que le chronomètre Pb-Pb ont également été utilisés pour dater les CAI. Ceux-ci parviennent à des résultats quasiment identiques. Par exemple, le chronomètre néodyme-uranium (Nd-U), qui représente le rapport 235U/238U en fonction du rapport 144Nd/238U, donne un âge légèrement supérieur (4,566 Ga), mais compatible avec les âges prédits par le chronomètre Pb-Pb. Les barres d’erreur sur les mesures (que l’on oublie parfois de mentionner) sont de quelques centaines de milliers d’années, donc très petites. Cette précision élevée est l’occasion de dire un mot sur les mesures des rapports isotopiques elles-mêmes. Celles-ci sont réalisées avec des spectromètres de masse (fig. 6), dont le principe est de séparer les ions contenus dans un gaz ou un fluide en fonction de leur masse (plus exactement en fonction du rapport entre leur masse et leur charge électrique, m/q), d’abord en les accélérant grâce à un champ électrique, puis en les faisant passer à travers un champ magnétique avant de les envoyer vers un réseau de détecteurs. La trajectoire de ces ions est fonction du rapport m/q, si bien que des ions de masses différentes arrivent sur différents détecteurs. On peut ainsi compter les quantités respectives de différents isotopes (ionisés) contenus dans un matériau donné, et déterminer la composition isotopique de ce matériau. Lorsque l’on souhaite déterminer l’âge d’un échantillon rocheux, il faut au préalable ajouter un système de chauffage permettant de vaporiser et d’ioniser cet échantillon. Les isotopes des éléments impliqués dans les chronomètres géochimiques sont souvent présents en très petites quantités (quelques millionièmes de la masse totale). Cela nécessite des mesures très précises, auxquelles les spectromètres de masse modernes ont accès.

4. Détail de la météorite d’Allende montrant des inclusions riches en calcium et en aluminium (CAI). (Crédit : G. J. McPherson et A. Boss, 2011)

5. Détermination de l’âge du Système solaire à partir de la mesure des rapports isotopiques du plomb (chronomètre Pb-Pb) dans les inclusions calcium-aluminium (CAI) de météorites chondrites carbonées (ici Efremovka). Les mesures effectuées sur différents échantillons d’une CAI donnée s’alignent le long d’une droite dont la pente permet de déterminer l’âge de cette CAI. Les âges mesurés pour deux CAI de la météorite Efremovka sont quasiment identiques, à 4,567 Ga. La datation de chondrules dans d’autres météorites (ici Acfer), toujours avec le chronomètre Pb-Pb, montre que ces chondrules sont plus jeunes que les CAI de quelques millions d’années. (Crédit : Amelin et al., 2010)

6. Principe du spectromètre de masse. Cet appareil permet de séparer des ions de masses différentes en les accélérant avec un champ électrique, puis en les soumettant à un champ magnétique qui défléchit leur trajectoire en fonction de leur masse (les masses les plus faibles subissant une déflexion plus importante). (Crédit : ChemistryLearnier.com)

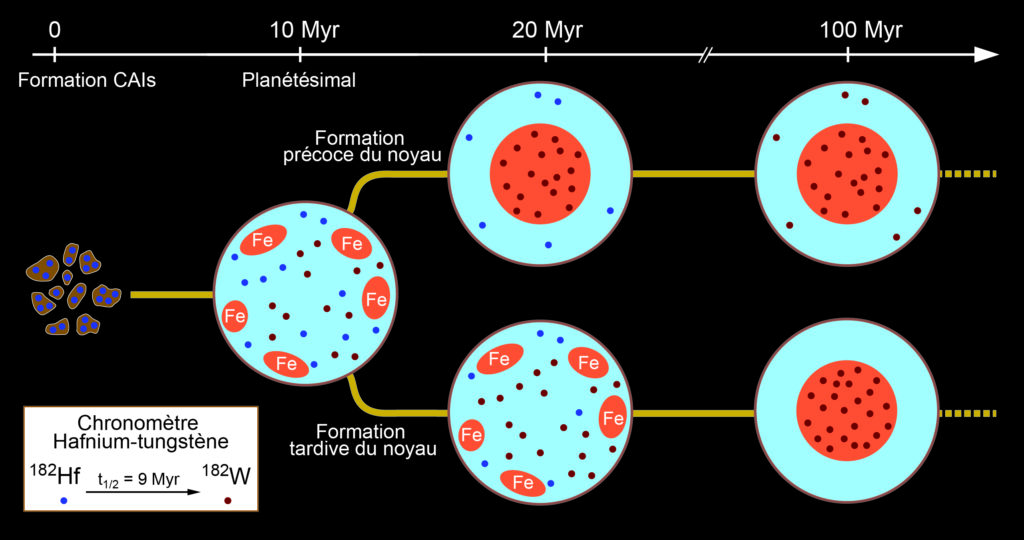

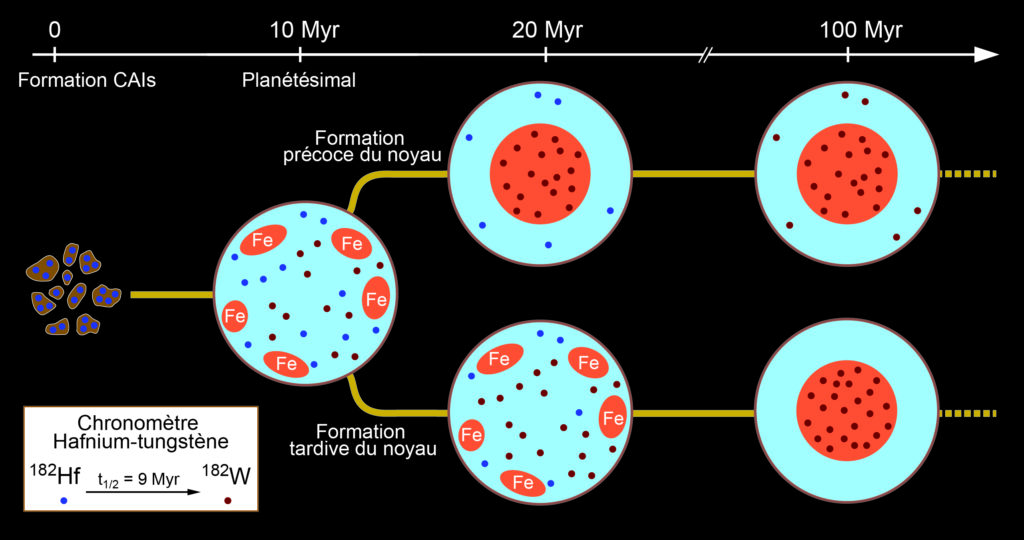

Deux chronomètres relatifs