par Sylvain Bouley | Oct 16, 2023 | Zoom Sur

Le Soleil est une étoile magnétique, dont l’activité intense a un impact direct sur notre société moderne et technologique. Elle est actuellement modulée par un cycle d’activité de 11 ans. En a-t-il toujours été ainsi ? Cet état cyclique du magnétisme solaire perdurera-t-il au cours de son évolution ? Afin de répondre à ces questions clés concernant notre étoile, une équipe internationale, dont des chercheurs français, a mené à bien trois études sur l’origine du magnétisme et de la rotation du Soleil et des étoiles de type solaire (via le mécanisme physique dit de dynamo fluide) dans une approche « Soleil au cours du temps ».

Les grandes étapes de l’existence du Soleil

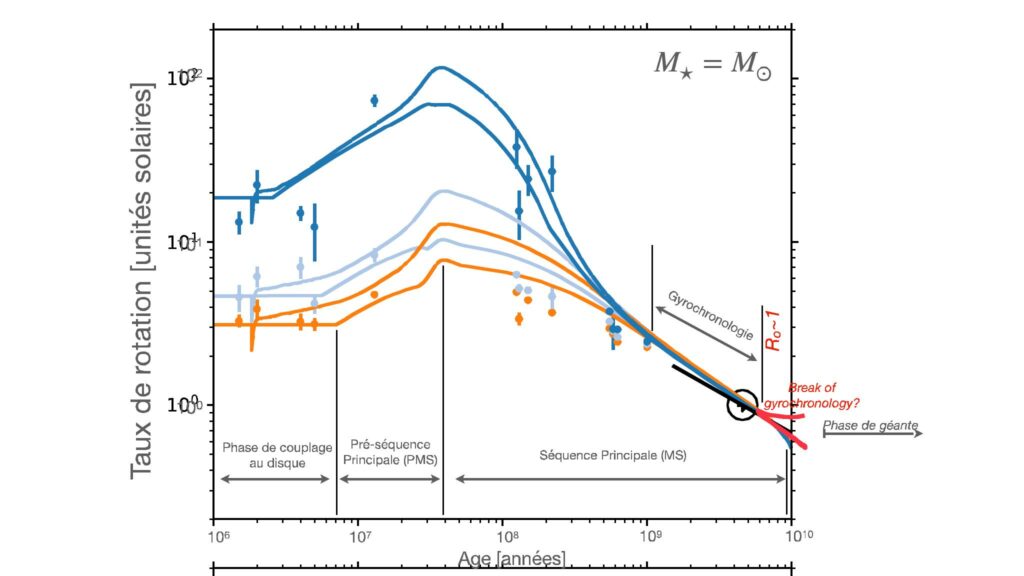

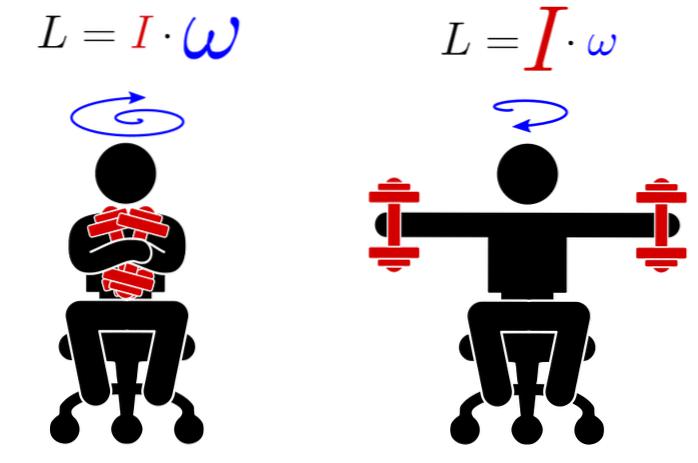

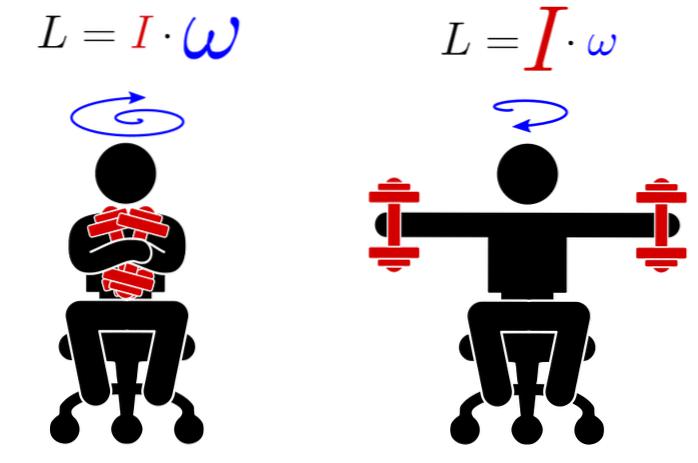

Le Soleil est passé par plusieurs phases au cours de sa vie. Tout a commencé au sein du milieu interstellaire (espace entre les étoiles au sein d’une galaxie) par l’effondrement gravitationnel (contraction sous sa propre masse à la suite d’une déstabilisation) d’un nuage de poussière et de gaz neutre (principalement du dihydrogène), appelé nuage moléculaire. Les mouvements présents au sein du nuage ont alors été amplifiés durant cette contraction originelle par conservation du moment cinétique : l’ensemble a acquis et amplifié sa rotation de la même façon qu’un patineur effectuant une pirouette accélère sa vitesse de rotation en rapprochant les bras de son corps [1] (fig. 2). Une fois que la densité a suffisamment augmenté, les forces de pression se sont opposées à l’effondrement, formant ce que l’on appelle une protoétoile (du grec protos signifiant « premier », « au début de ») et dont nous proposons de suivre l’évolution rotationnelle simplifiée sur la figure 1 :

– Couplage au disque : la rotation de la protoétoile est passée tout d’abord dans sa phase jeune par un plateau, c’est-à-dire un intervalle de temps où elle n’a pas varié. La rotation est demeurée constante sur plusieurs millions d’années tant que l’étoile ne se découplait pas de son disque de matière primordiale (ou disque d’accrétion). Ce dernier se forma autour d’elle par combinaison de la force gravitationnelle et de la force centrifuge durant la contraction du nuage.

– Fin de la contraction : une fois le disque d’accrétion dissipé (par exemple par sublimation ou par formation de planètes), la rotation de l’étoile a de nouveau accéléré par effet de la contraction toujours en cours (phase de pré-séquence principale ou PMS) pour atteindre les vitesses de rotation les plus élevées [2]. Une fois que les conditions de température et pression en son cœur furent suffisantes pour déclencher la fusion de l’hydrogène par réactions nucléaires, l’effondrement s’est arrêté et la protoétoile est devenue ce que l’on appelle communément une étoile. Ce point critique dans l’évolution stellaire s’appelle la ZAMS (zero age main sequence).

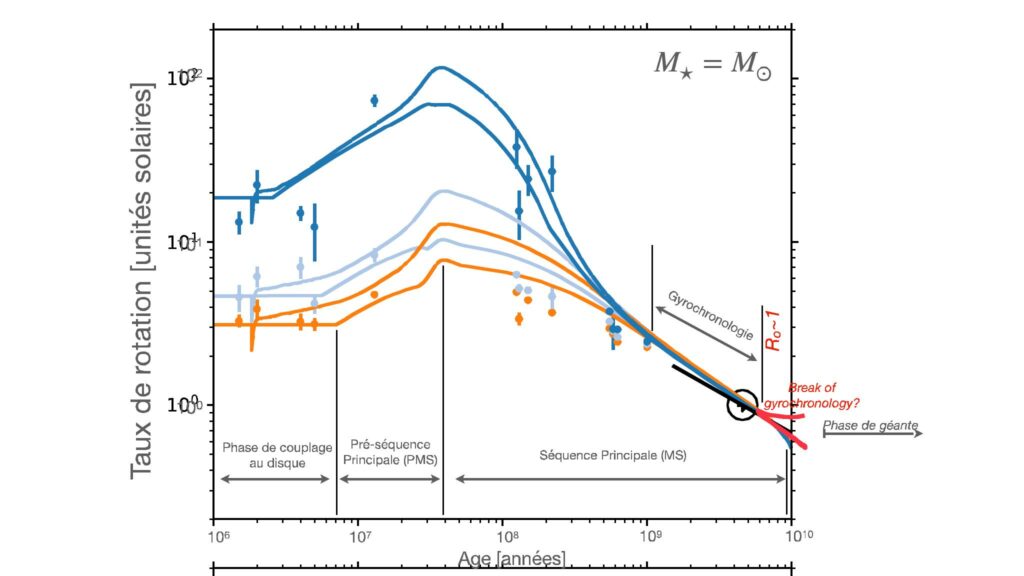

– Vers un lent ralentissement : l’étoile est alors entrée dans une phase, toujours actuelle, nommée séquence principale, où elle transforme son hydrogène en hélium. Cette phase durera 10 milliards d’années dans le cas du Soleil. Sa rotation ralentit maintenant, cette fois-ci par perte de moment cinétique via son vent de particules magnétisé. Ce scénario de l’histoire rotationnelle de notre étoile est confirmé par l’observation d’amas d’étoiles de différents âges, que nous représentons sur la figure 1 par les petits disques de couleurs avec barres d’erreur. En particulier, il a été proposé par Skumanich en 1972, puis Barnes en 2003, que le ralentissement des étoiles de type solaire suit une loi du type Ω(t) ~ t–1/2, laquelle implique qu’elles convergent toutes vers une même rotation à partir de l’âge des Hyades (soit environ 650 à 800 millions d’années). Cette relation directe entre âge et taux de rotation des étoiles de type solaire a été dénommée gyrochronologie (des mots grecs gyros, « rotation », chronos, « âge » et logos, « étude »).

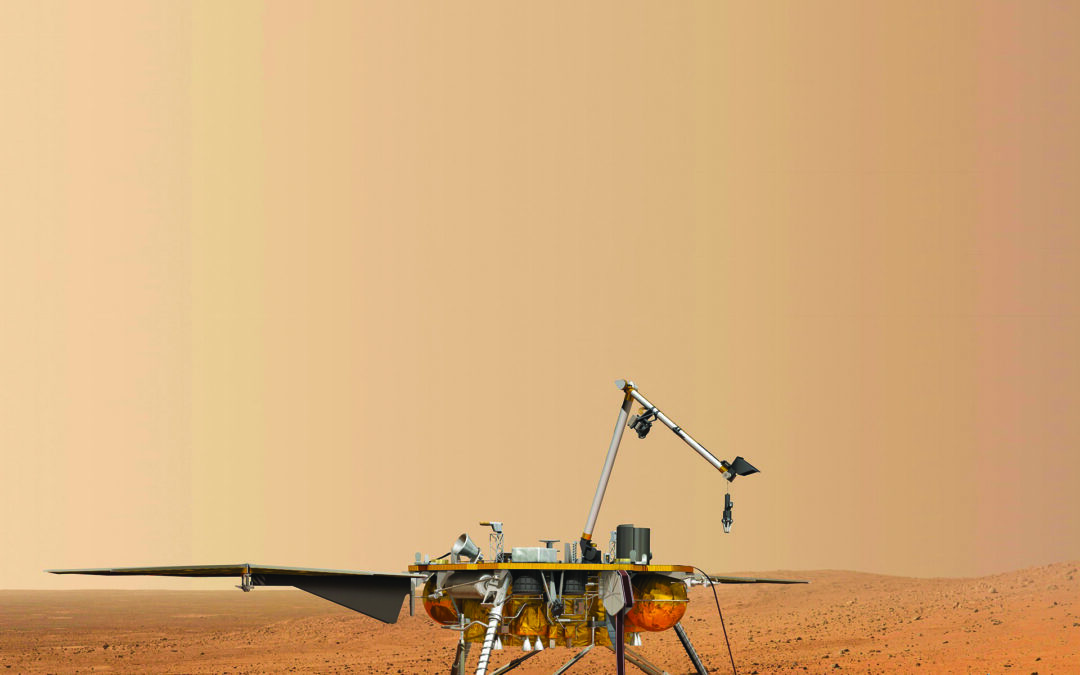

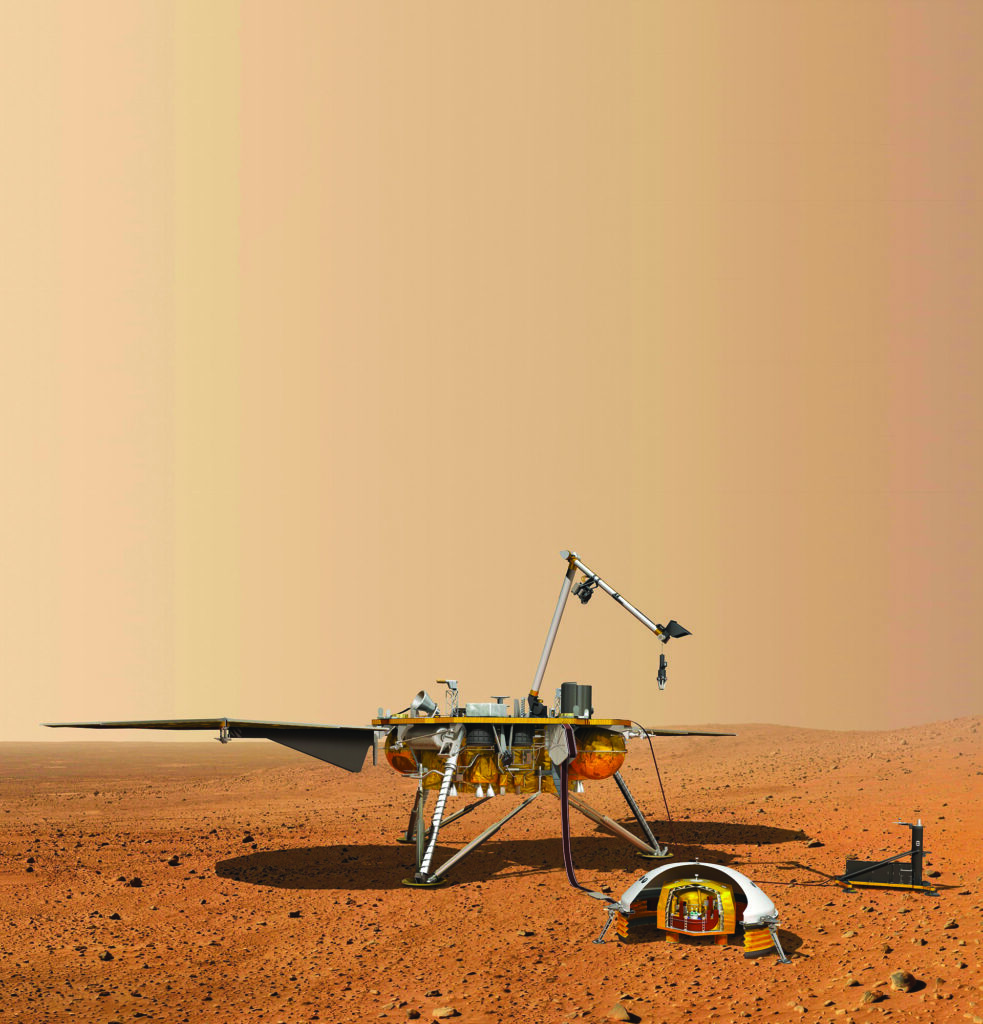

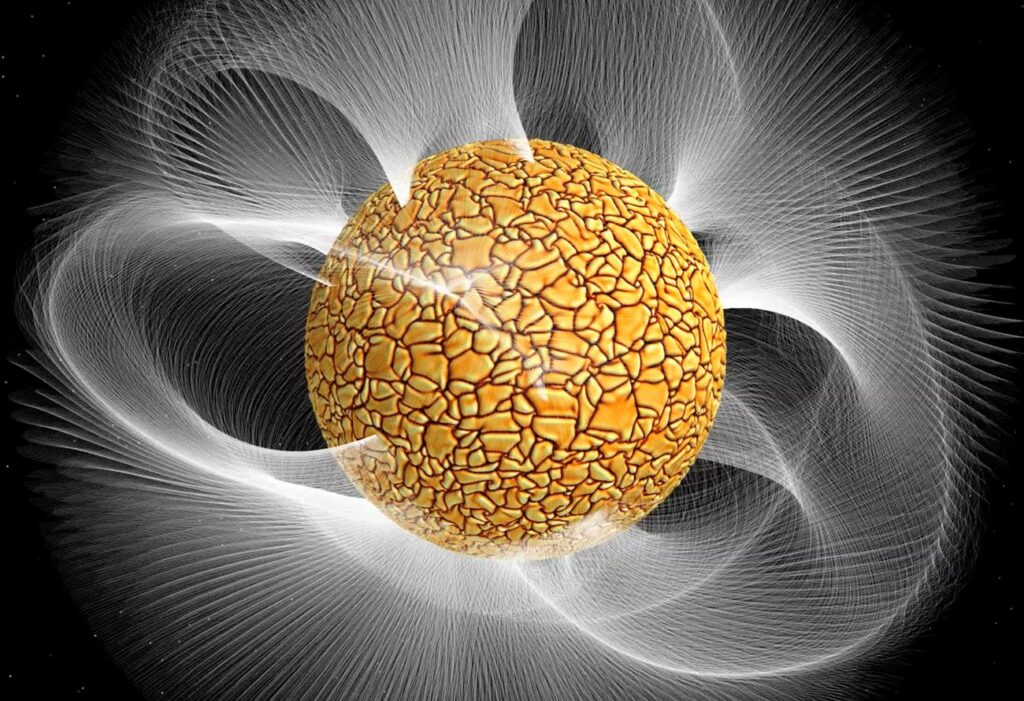

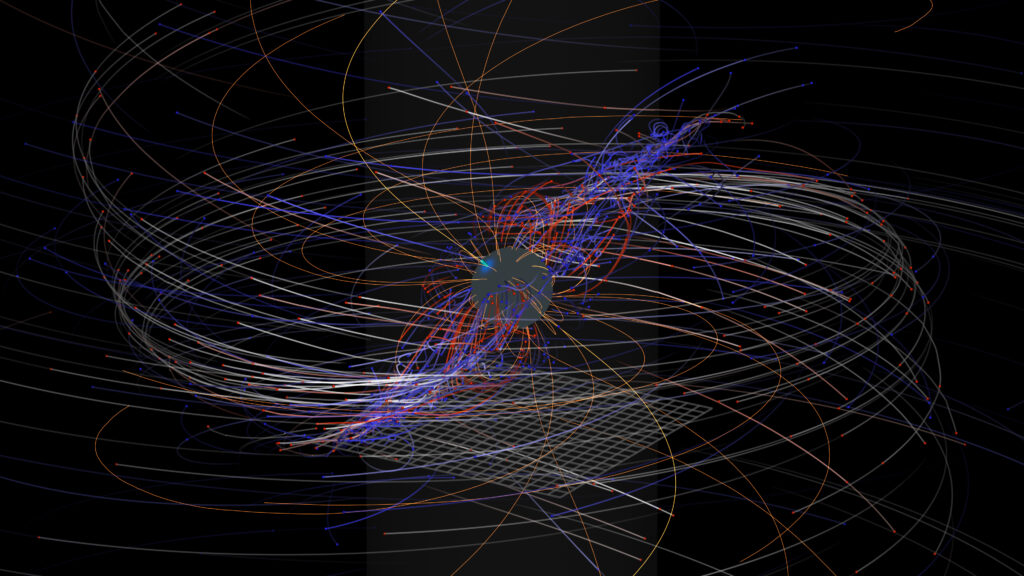

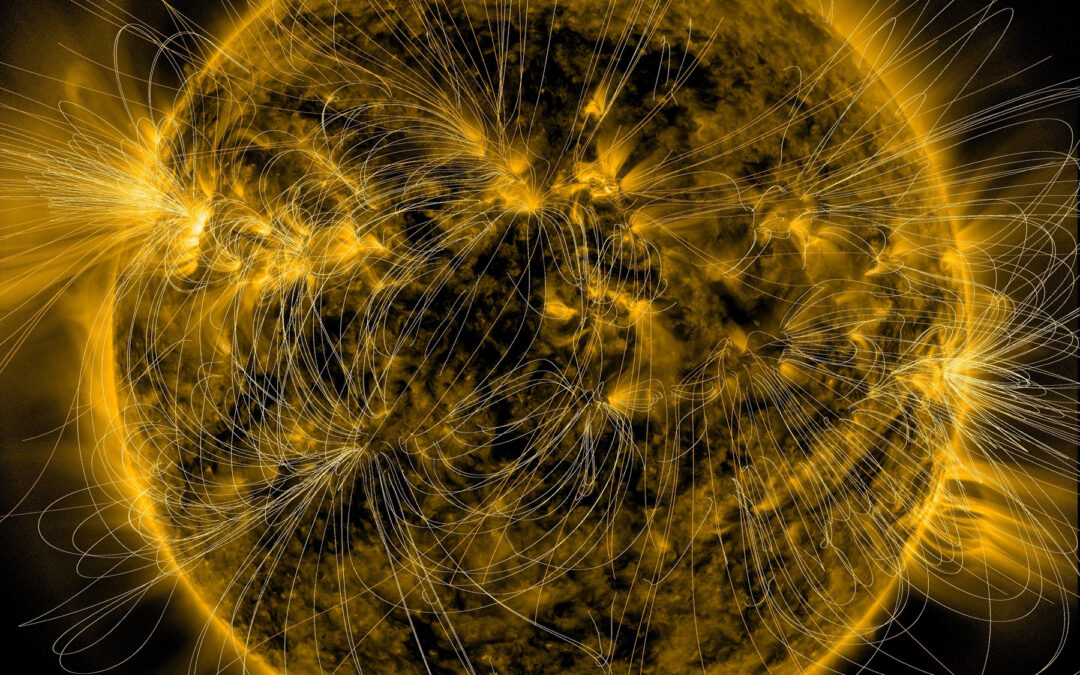

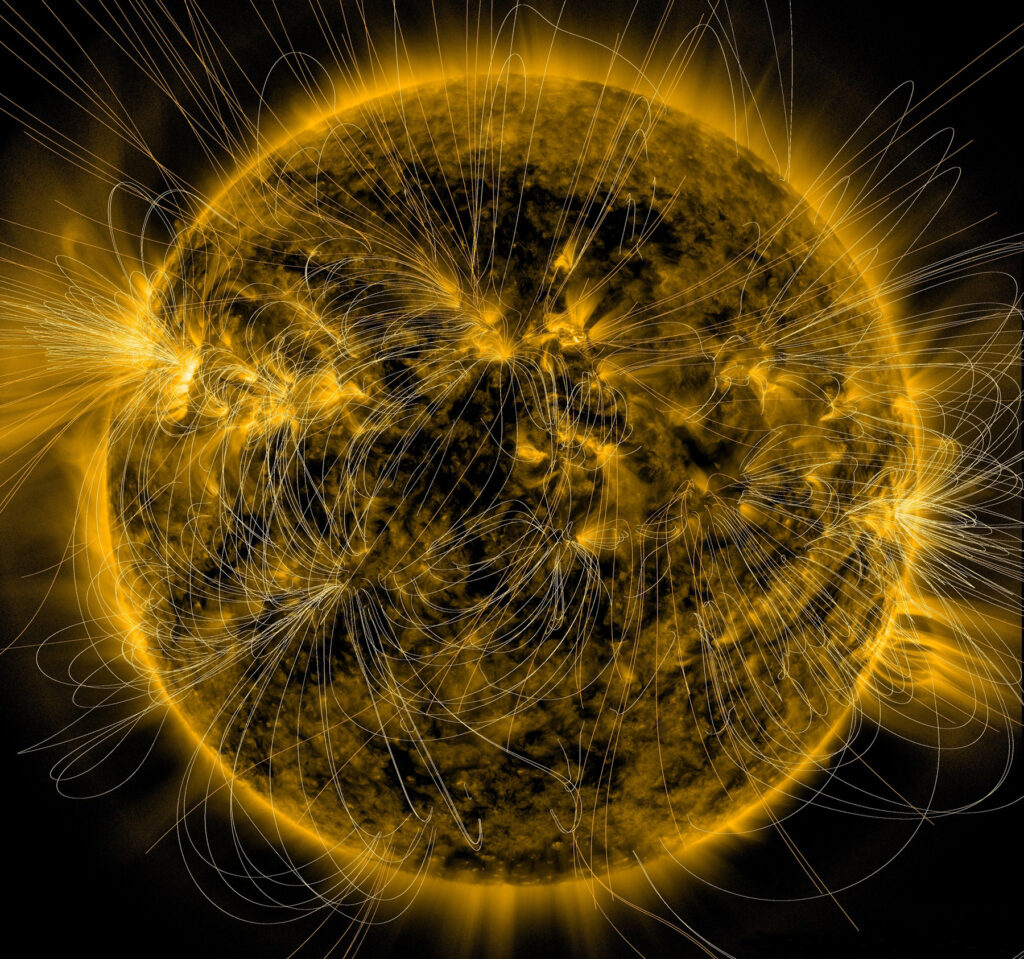

Simulation 3D de la convection et de la dynamo d’une étoile semblable au Soleil pour comprendre l’évolution de la rotation interne et du magnétisme. En jaune/marron : vitesse radiale de la convection (montée/descente) ; en blanc : lignes de champ magnétique obtenues par extrapolation des valeurs en surface de la simulation. (A. Strugarek, Q. Noraz, A. S. Brun)

Figure 1. Évolution rotationnelle d’une étoile de 1 masse solaire sur les temps séculaires. Trois rotations initiales représentatives de la distribution observée dans les amas ouverts d’étoiles sont utilisées (rotateurs lents en orange, médians en bleu clair et rapides en bleu foncé). Les lignes solides représentent la rotation de l’enveloppe convective et celles pointillées de leur intérieur radiatif. Les petits cercles pleins avec barres d’erreur représentent les observations d’amas d’étoiles. Plusieurs phases rotationnelles sont identifiables : constante par ancrage à un disque de matière, en accélération par effet de contraction de l’étoile, puis décélération par freinage par vent magnétisé stellaire. La phase où toutes les courbes (quelle que soit leur vitesse initiale) convergent est la période évolutive où la gyrochronologie (la datation des étoiles par leur taux de rotation) est a priori possible, sauf si celle-ci s’arrête pour les étoiles âgées ayant un nombre de Rossby plus grand que 1 comme proposée récemment par certains auteurs. (Adapté de Ahuir et al., 2021)

La rotation non uniforme du Soleil

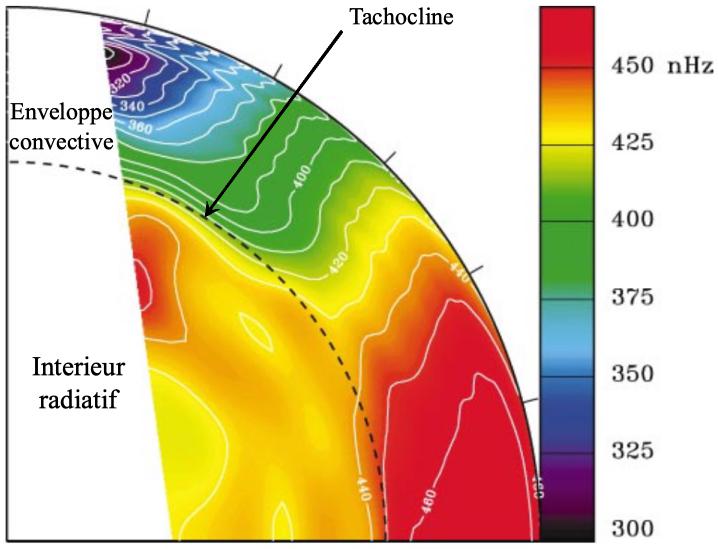

Cependant, la rotation globale d’une étoile de type solaire ne suffit pas à caractériser entièrement comment celle-ci tourne. En effet, le Soleil est constitué de plasma, qui est un état fluide de la matière [3]. Différentes parties de l’étoile peuvent alors avoir des mouvements indépendants les unes des autres, via une subtile redistribution de moment cinétique (nécessitant des simulations 3D pour leur étude et caractérisation), qui implique que tout ne tourne pas d’un bloc du centre à la surface. Ainsi, l’étoile présente un profil de rotation dite différentielle. Ces différentes vitesses s’organisent en fonction de la structure thermique de l’étoile, qui se décompose en deux grandes régions dans le cas du Soleil :

– L’intérieur radiatif : après que l’énergie thermique a été créée au centre par les réactions de fusion nucléaire, elle est évacuée vers la surface de l’étoile. Dans cet intérieur profond, la température et la densité sont très élevées et cela rend la matière transparente à la lumière : l’énergie thermique est alors principalement transportée par le rayonnement (c’est-à-dire par les photons)[4]. Cette zone est dite stable et possède une rotation dite « solide » : le taux de rotation est majoritairement constant, faisant tourner la zone interne radiative d’un seul bloc en 28 jours.

– L’enveloppe convective : à mesure que l’on s’éloigne du centre de l’étoile, l’opacité de la matière au rayonnement augmente, diminuant le libre parcours moyen [5] des photons, jusqu’à atteindre une localisation où les photons ne transportent plus l’intégralité de l’énergie thermique en direction de la surface. L’interaction des photons avec la matière dépose alors assez d’énergie pour modifier localement le gradient de température au point de déclencher l’instabilité convective. Le processus de convection transporte l’énergie thermique par mouvements macroscopiques de matière dans l’enveloppe externe du Soleil. À la manière d’une casserole d’eau frémissante lorsqu’elle est suffisamment chauffée par-dessous, la matière chaude monte jusqu’à la surface, tandis que la matière froide plus dense redescend. La zone convective du Soleil s’étend depuis la surface sur 30 % du rayon de l’étoile, mais cette profondeur change en considérant des étoiles de masses différentes. Cette enveloppe s’étend plus profondément pour les étoiles moins massives, tandis qu’elle est plus fine pour des étoiles plus massives, et disparaît totalement pour les étoiles dont la masse dépasse deux fois celle du Soleil. La convection redistribue le moment cinétique, et donc modifie les vitesses de rotation au sein de cette zone. Dans le cas du Soleil, on observe par exemple que la zone équatoriale tourne en 25 jours, tandis que les régions polaires tournent en 35 jours.

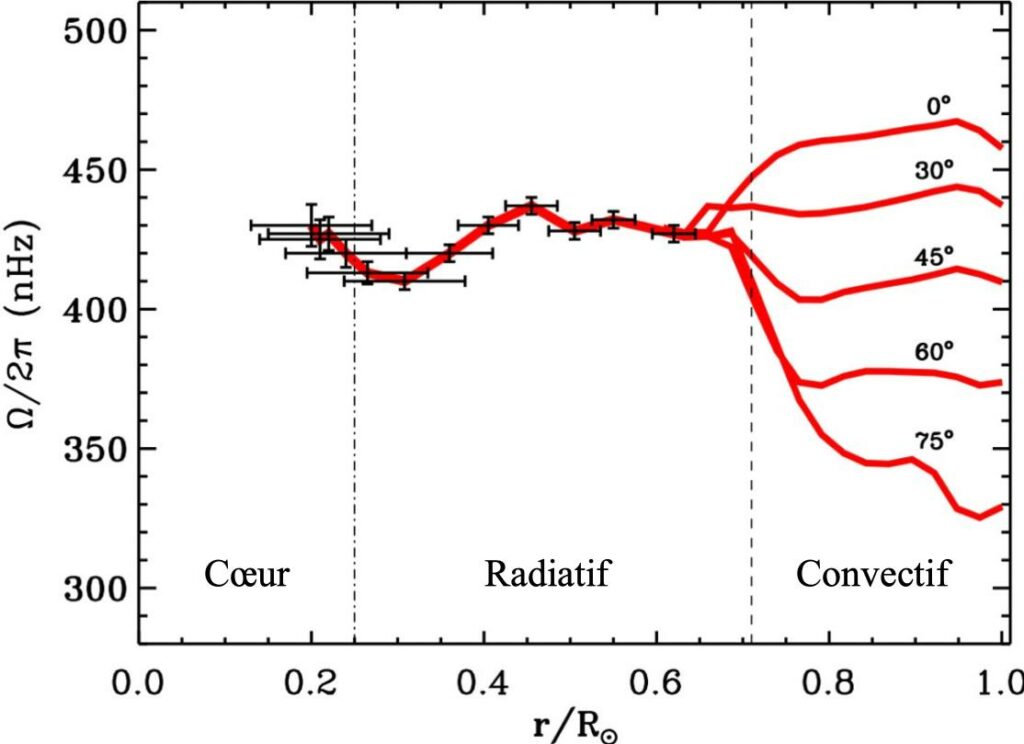

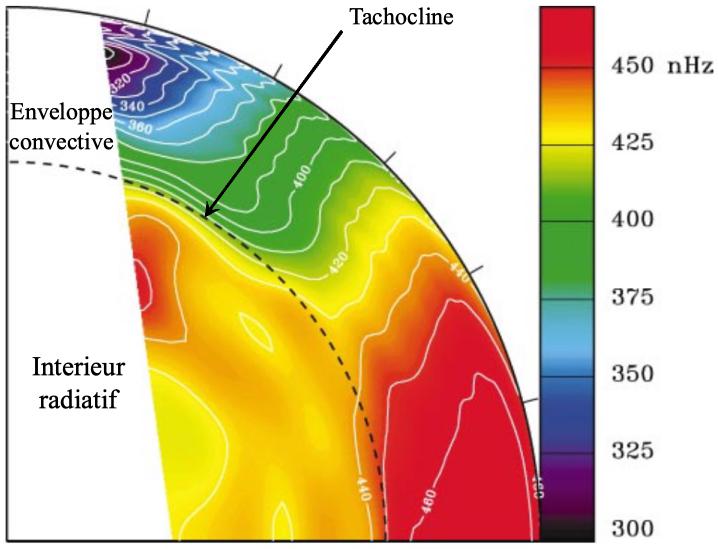

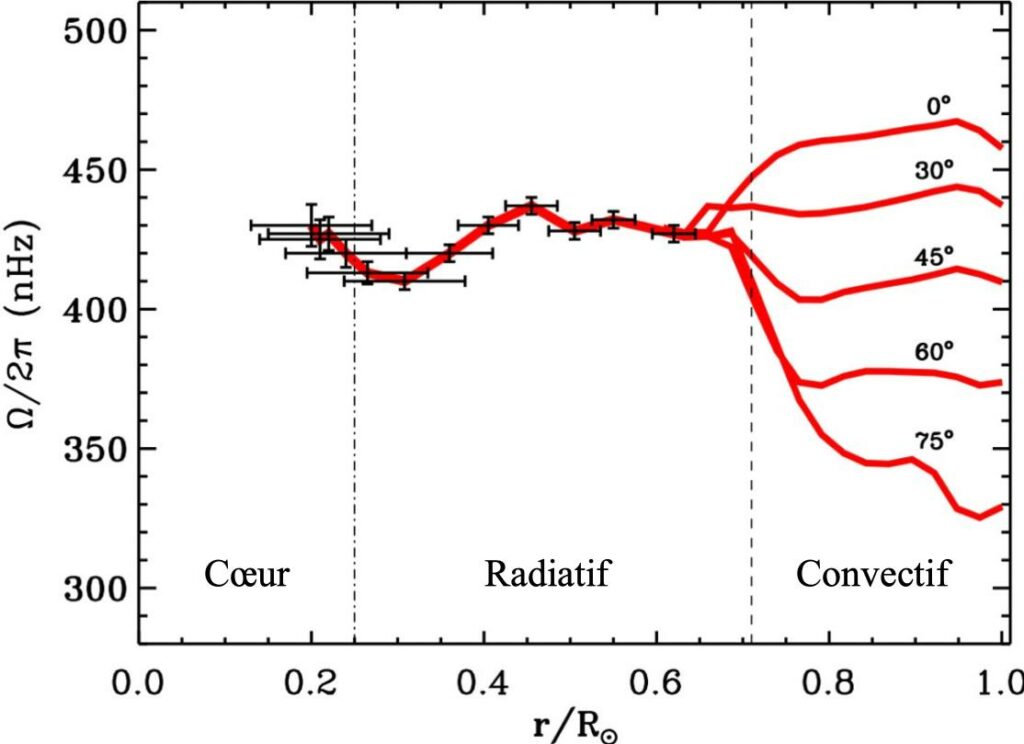

L’interface entre la zone radiative en rotation solide et la zone convective externe en rotation différentielle est ainsi une région où les vitesses de rotation changent fortement. Elle est nommée en ce sens tachocline (du grec táchos et klínô, signifiant « vitesse » et « inclinaison/pente ») et est visible sur le profil de rotation solaire illustré en figure 3.

Figure 2. En considérant la conservation du moment cinétique L du système (humain + haltères), l’augmentation (la diminution) du moment d’inertie I, en écartant (regroupant) les bras, diminuera (augmentera) la vitesse angulaire de rotation w. (Source : fr.differbetween.com)

La production de champ magnétique grâce à la rotation différentielle

Cette rotation différentielle des étoiles favorise notamment la création d’un champ magnétique, grâce au processus de dynamo fluide. De manière similaire à une lampe alimentée par la dynamo d’un vélo, cette dernière permet de transformer l’énergie mécanique en énergie électromagnétique. Dans une étoile, ce processus dynamo fluide est la propriété que possède un plasma de générer par ses mouvements et par auto-induction un champ magnétique et de le maintenir. En effet, s’il n’est pas entretenu, le champ magnétique décroît : les courants électriques de la dynamo, intimement liés au champ magnétique, se dissipent en produisant de la chaleur, comme dans n’importe quel conducteur électrique résistif. On parle de dissipation du champ magnétique par diffusion ohmique. Seuls certains écoulements peuvent amplifier et maintenir un champ magnétique contre sa diffusion naturelle, ce qui est le cas des écoulements turbulents au sein du Soleil. En effet, l’association de la convection turbulente et de la rotation différentielle confère au plasma des propriétés d’étirement, de cisaillement et d’enroulement nécessaires à la mise en place de la dynamo fluide.

Figure 3. Rotation différentielle du Soleil. Coupe méridienne du profil de rotation de l’hémisphère Nord solaire. On y remarque la rotation solide de l’intérieur radiatif en jaune (28 jours), séparé par la tachocline (en pointillé) de l’enveloppe convective en rotation différentielle. La partie équatoriale de cette dernière (en rouge) est plus rapide (~25 jours) que celle de la région polaire (en violet/noir), pouvant ralentir jusqu’à 38 jours. Source : Thompson et al. (2003).

Profils radiaux de cette même rotation pour des latitudes particulières (0, 30, 45, 60 et 75°). On remarque le regroupement des différentes courbes, représentant le passage de la rotation différentielle à la rotation solide, et définissant la « tachocline ». (Garcia et al., 2007)

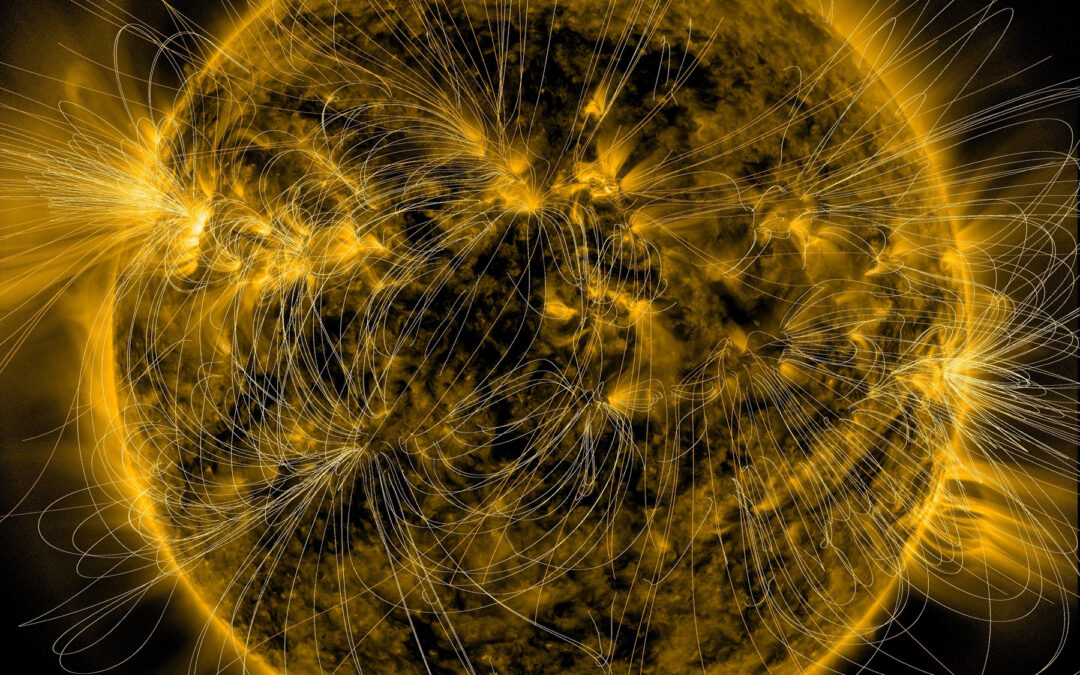

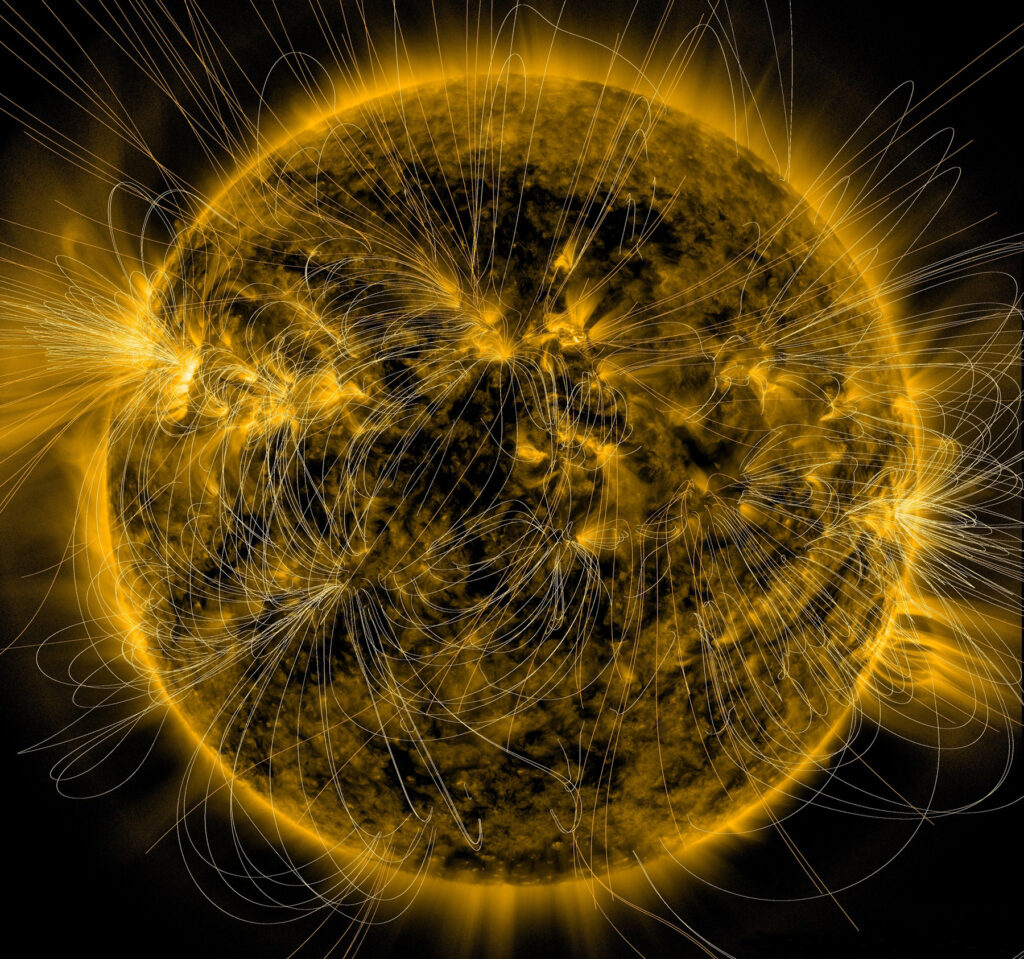

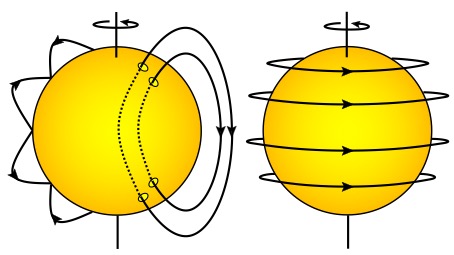

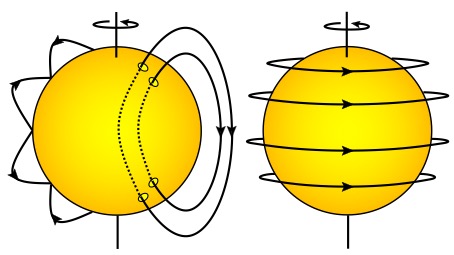

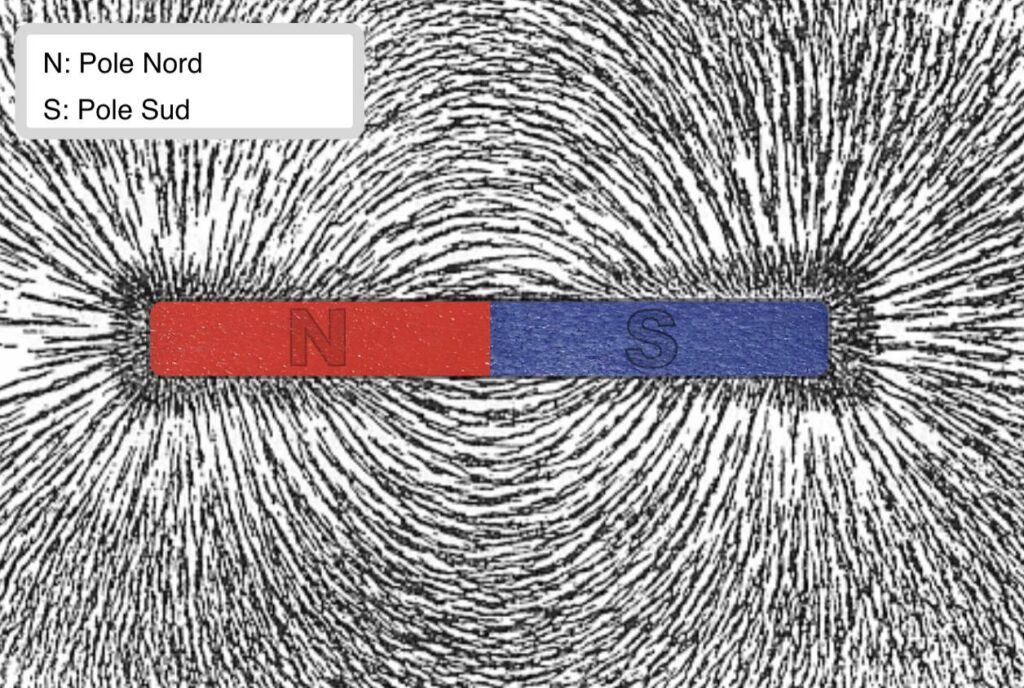

Pour décrire le champ magnétique d’une étoile, les chercheurs ont l’habitude de l’illustrer par l’intermédiaire de lignes de champ magnétique : lignes imaginaires illustrées en figures 4 et 5, indiquant le sens et l’intensité du champ magnétique et le long desquelles se déplacent en s’enroulant (mouvement dit « giratoire ») les particules chargées. On voit en figure 4 le champ magnétique représenté en deux composantes, usuellement utilisées pour le décomposer mathématiquement et l’étudier. La première est la composante dite poloïdale, contenue dans le plan de l’étoile passant par les deux pôles (plan méridien) et comparable à la géométrie des aimants que nous utilisons au quotidien (voir figure 5). La seconde est nommée composante toroïdale, en référence à la forme de « tore/donut » que prend cette dernière, et qui est contenue dans le plan perpendiculaire à l’axe de rotation. La géométrie globale du champ magnétique peut varier selon les étoiles. En particulier, elle structure et guide la couronne solaire, et par conséquent l’éjection de particules chargées, à l’origine du « vent » stellaire magnétisé visible sur la figure 4.

Figure 4. Composantes usuellement utilisées pour décrire le champ magnétique stellaire à grande échelle. À gauche : composante dite

« poloïdale », contenue dans le plan méridien de l’étoile. Le côté droit de l’étoile représente la composante dipolaire (une boucle à grande échelle), tandis que le côté gauche représente une composante multi- polaire (ici la composante hexadécapolaire avec les 4 boucles).

À droite : composante dite « toroïdale », contenue dans le plan perpendiculaire à l’axe de rotation.

Encadré 1. Induction et Dynamo : L’auto-induction magnétique est un phénomène d’induction où la source du champ magnétique, à l’origine d’une force électromotrice dans un circuit, est le courant électrique parcourant ce même circuit. La dynamo est un phénomène physique qui convertit de l’énergie mécanique en énergie magnétique. Dans les corps célestes, elle met en œuvre le phénomène d’induction électromagnétique par le mouvement de régions fluides conductrices qui génère un champ magnétique. Cet effet apparaît lorsque l’écoulement est assez vigoureux pour que le champ magnétique induit soit maintenu malgré la dissipation ohmique du milieu dans lequel il baigne.

Le vent solaire et le ralentissement de la rotation

Au travers de ce vent, l’étoile perd de la masse et donc du moment cinétique. En effet, de façon similaire au patineur écartant ses bras pour ralentir la rotation de sa pirouette, ce vent magnétisé génère un effet de bras de levier. L’amplitude de ce couple dépend notamment de l’intensité et de la géométrie du champ magnétique créé, et abaisse progressivement le taux de rotation de l’étoile, comme nous le voyons en figure 1. Une rotation plus rapide a tendance à générer un champ magnétique plus intense, et donc un freinage par vent magnétisé d’autant plus important (courbe bleu foncé). À l’inverse, une rotation plus faible est à l’origine d’un champ généralement moins intense, il est donc impacté par un freinage plus faible (courbe orange). Cette boucle de rétroaction « rotation -> dynamo -> magnétisme -> vent -> freinage -> rotation » est à l’origine de la convergence des étoiles de même masse (ici une masse solaire) vers la loi de Skumanich Ω(t) ~ t–1/2, et permet ainsi la gyrochronologie.

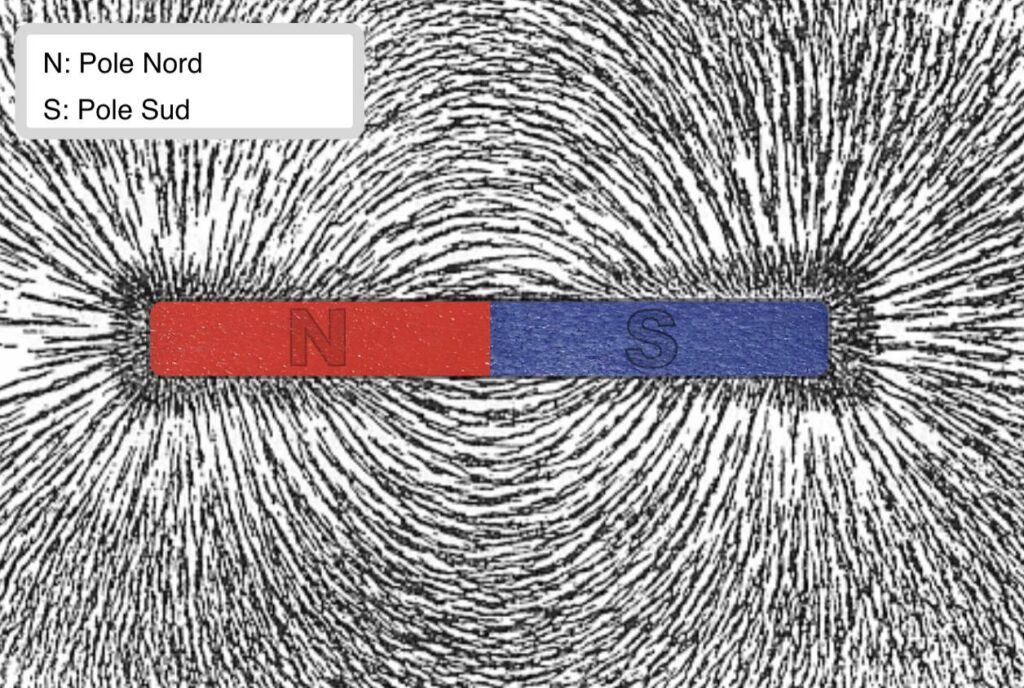

Figure 5. Illustration du champ magnétique d’un aimant usuel en utilisant de la limaille de fer. Cette limaille est alors orientée par le magnétisme, en traçant les « lignes de champ ». (Newton Henry Black, Practical Physics, 1913)

Les cycles d’activité du Soleil ont-ils toujours existé ?

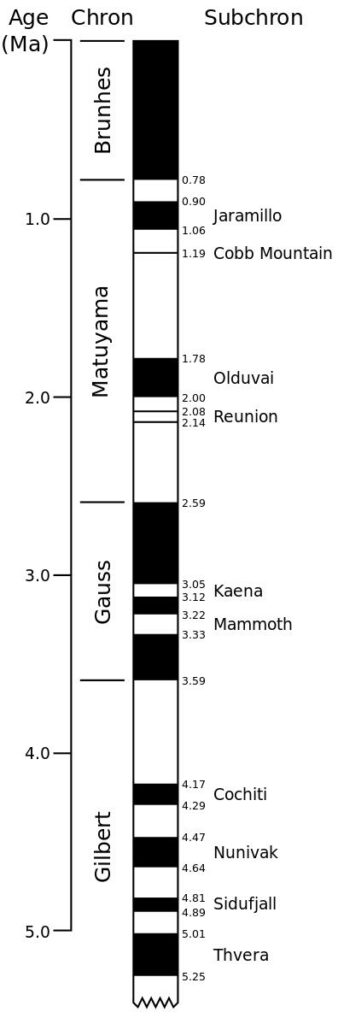

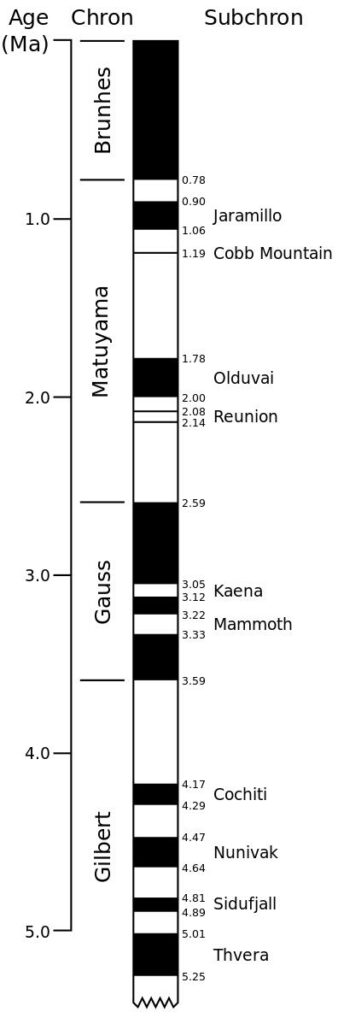

Ainsi, pendant que la rotation de l’étoile diminuait sur des durées de l’ordre du milliard d’années, l’intensité globale du champ magnétique en faisait généralement de même. Cependant, la dynamo fluide a pu parfois conduire à des variabilités cycliques de l’intensité et l’orientation de ce champ sur des temps bien plus courts ! De tels changements de polarité et d’intensité ont tout d’abord pu être mis en évidence pour la dynamo terrestre, avec des traces d’inversions passées des pôles magnétiques, observées dans l’aimantation de certaines roches volcaniques et illustrées en figure 6 (lire l’encadré 2 et la note [6]).

Figure 6. Polarité géomagnétique pendant la fin de l’ère cénozoïque (de –5 millions d’années à nos jours). Les zones sombres indiquent les périodes de polarité dite « normale », tandis que les zones claires indiquent une polarité « inverse ». Les transitions noir/blanc correspondent donc au renversement global de la composante poloïdale (voir figure 4) du champ magnétique terrestre. On remarque que le dernier renversement remonte à 780 000 ans. (U.S. Geological Survey Open-File Report 03-187)

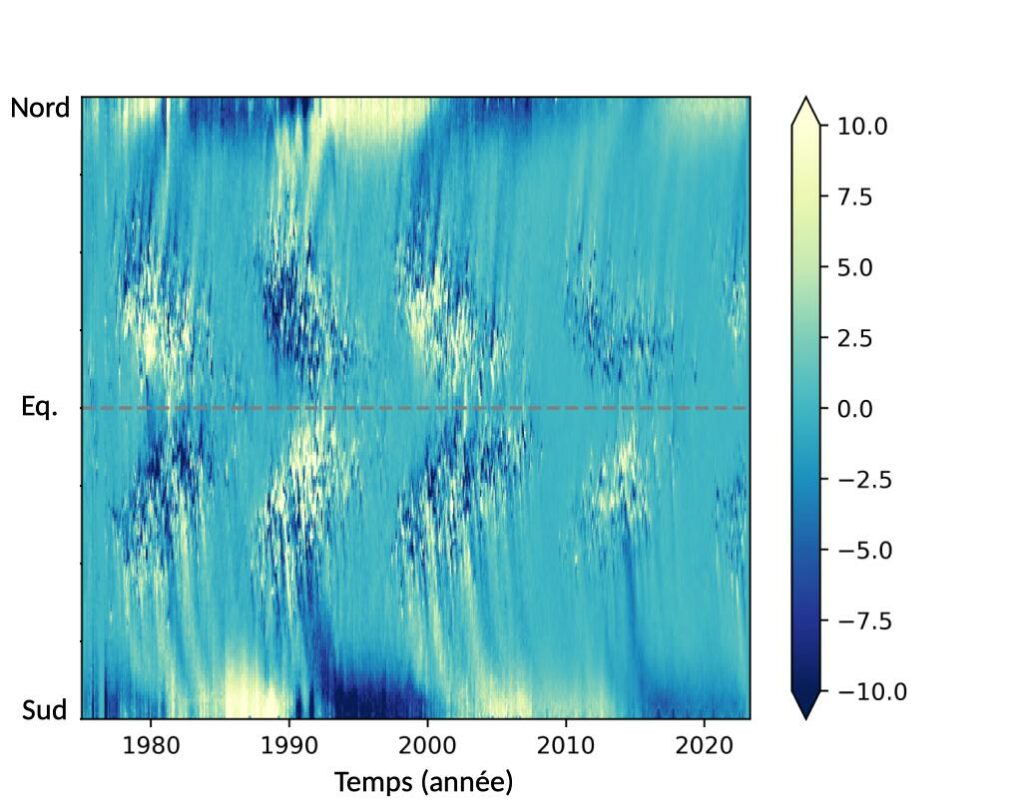

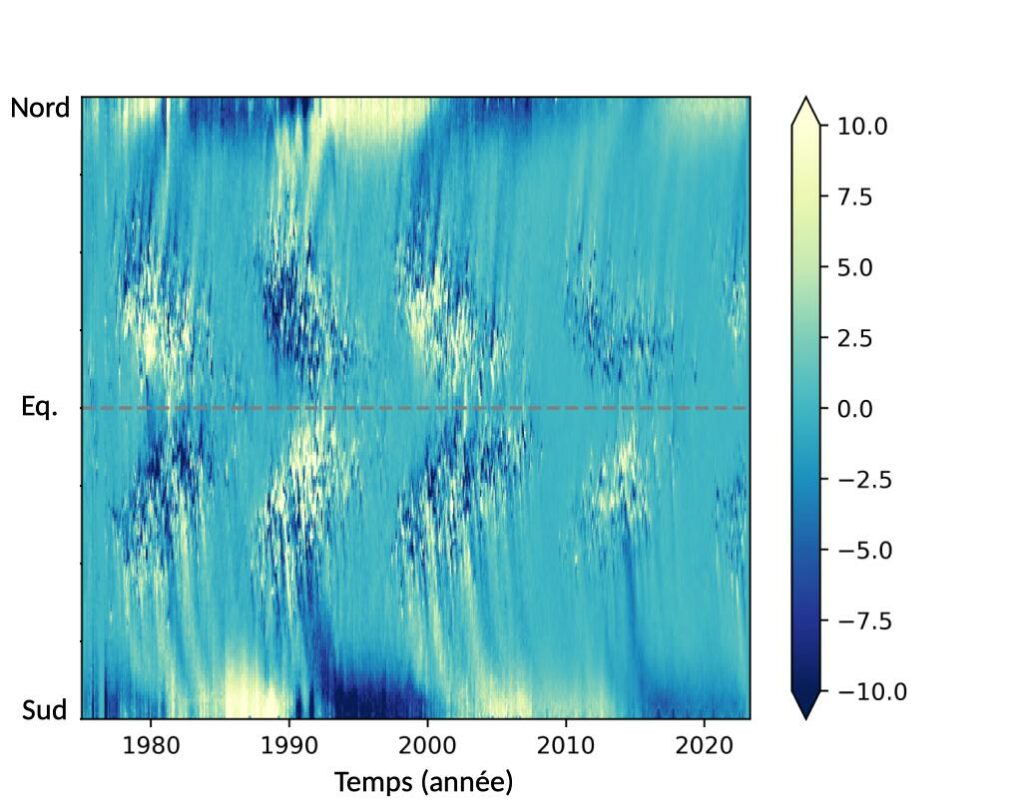

Sur le Soleil, des inversions similaires de l’orientation magnétique globale (dite « polarité ») sont observées de manière cyclique tous les 11 ans, et sont illustrées en figure 7 (sur la figure 4, leur effet revient à inverser le sens des flèches). On observe aussi durant ces cycles un changement de la fréquence d’apparition des structures magnétiques à sa surface, les tâches solaires, dont le nombre atteint son maximum tous les 11 ans. On parle de « maximums d’activité », et ceux-ci sont séparés par des « minimums d’activité » pendant lesquels ces structures sont absentes de la surface. Le dernier minimum solaire est survenu en décembre 2019, date depuis laquelle l’activité repart à la hausse, et atteindra un prochain pic, attendu autour de 2025. Des traces de cycles magnétiques ont également été détectées pour d’autres étoiles de type solaire, allant de quelques années à quelques dizaines d’années. Il est alors important de comprendre comment ces cycles sont contrôlés dans leur ensemble, afin de mieux comprendre l’activité du Soleil et l’impact qu’elle pourrait avoir sur nos sociétés technologiques. En effet, rappelons que la Terre baigne dans la lointaine atmosphère du Soleil, laquelle est turbulente et magnétique.

Figure 7. « Diagrammes papillon » du Soleil de 1976 à 2022. Il s’agit d’une représentation temps-latitude du champ magnétique de surface. La couleur blanc/bleu représente un champ pointant vers l’extérieur/l’intérieur du Soleil (une polarité positive/négative), mesuré ici en gauss (10 000 gauss = 1 tesla). Nous voyons différents maximums d’activité en 1981, 1991, 2000 et 2012, dessinant des formes d’ailes, et séparés par les minimums d’activité de 1976, 1986, 1996, 2008 et 2019. (Construit à partir des données KPNO, GONG, SOLIS & MDI)

Ainsi, allant de pair avec le changement du taux de rotation de l’étoile, le niveau d’activité magnétique de l’étoile est lui aussi modifié au cours de sa vie. On observe en effet que les étoiles jeunes tournent rapidement et sont très actives, tandis que les plus vieilles semblent moins actives et plus lentes. Cependant, la gyrochronologie a possiblement été remise en cause par les données du satellite Kepler (van Saders et al. 2016). Comme illustré en figure 1, le freinage des étoiles de type solaire s’arrêterait vers l’âge du Soleil (environ 4,5 milliards d’années), ce qui signifie que le vent ne serait plus aussi efficace pour extraire le moment cinétique des étoiles âgées. Cela pourrait s’expliquer par exemple par un changement de géométrie globale du champ magnétique solaire/stellaire, ou une modification de leur perte de masse. Il faut donc mieux caractériser la boucle complexe de rétroaction « dynamo -> magnétisme -> vent -> freinage -> rotation -> dynamo » pour comprendre l’évolution séculaire du magnétisme des étoiles de type solaire, et la possible existence d’un changement de régime magnéto-rotationnel.

Encadré 2. Des inversions magnétiques reproduites en laboratoire : Des scientifiques ont déjà pu reproduire en laboratoire des inversions du champ magnétique similaires à celle produite sur Terre. L’expérience Von-Karman Sodium (VKS, Monchaux et al., 2009), menée au centre CEA-Cadarache, consiste en une cuve remplie de sodium liquide (fluide conducteur), mis en mouvement entre et par deux hélices. Tout ce système était par la suite mis en rotation suivant un autre axe (précession), ce qui a permis de mettre en évidence différents états de dynamo. Suivant les vitesses mises en jeu, le processus dynamo (1) n’a pas lieu, (2) se produit en générant un champ magnétique à grande échelle et statique, (3) générant un champ magnétique variable à petite échelle et irrégulier, (4) mais pouvant aussi générer un champ magnétique dont la structure globale oscille de façon similaire à celui de la Terre. Néanmoins, la géométrie cylindrique de cette expérience reste différente de celle des étoiles que nous schématisons sur la figure 3. The Madison Experiment (Cooper et al., 2014, en cours de construction) nous permettra de continuer ces explorations en laboratoire avec la géométrie sphérique.

Un nombre clé pour caractériser l’évolution de la rotation et du magnétisme solaires

En ce sens, il a récemment été montré que ces changements de régimes peuvent être délimités via une quantité appelée nombre de Rossby « Ro » (lire l’encadré 3). Ce nombre permet de caractériser comment la rotation globale d’une étoile influence sa dynamique convective interne. À masse équivalente, les étoiles jeunes en rotation rapide auront un nombre de Rossby plus faible, tandis que les étoiles plus âgées tournant lentement auront un nombre de Rossby plus élevé. Si l’on regarde maintenant des étoiles de masses différentes, une étoile aura un nombre de Rossby d’autant plus élevé qu’elle est massive.

Grâce à des simulations numériques menées sur les supercalculateurs situés dans les centres français, une équipe de chercheurs français accompagnés de collègues internationaux a développé des simulations de la dynamo des étoiles de type solaire avec ce but précis (résultats publiés dans Brun et al., 2022). En changeant la masse et la rotation, et donc le nombre de Rossby des étoiles simulées (au nombre de 15), ils ont pu explorer différents états de rotation interne de l’étoile, et par conséquent de son magnétisme.

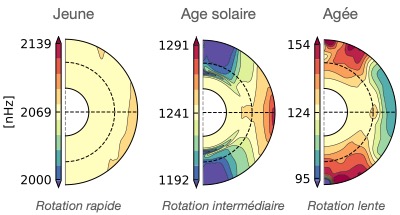

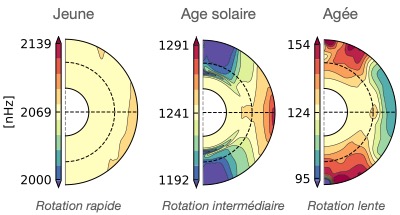

Figure 8. Profils de rotation dans une coupe méridienne de trois simulations dynamos convectives 3D d’une étoile de type solaire à différents taux de rotation globale (nombres de Rossby Ro : Ro < 0,2 (gauche), Ro ~0,2-0,7, Ro > 1 (droite)). Les régions rouges représentent un taux de rotation plus grand que la rotation globale (jaune pâle), tandis que les régions bleues représentent des taux de rotation plus faibles. (Adapté de Noraz et al., 2022b)

Pour illustrer cela, nous montrons sur la figure 8 trois états de rotation caractéristiques de l’étude :

– Un état de rotation quasi solide pour les rotateurs rapides : Ro faible – étoile jeunes.

– Un état de rotation dit solaire, avec un équateur rapide et des pôles lents : Ro et âges intermédiaires. Il est caractéristique du Soleil, mais aussi d’étoiles comme Ɛ Eridani ou 61 Cygni A.

– Un état de rotation dit antisolaire, avec des pôles rapides et un équateur lent : Ro élevé – étoiles potentiellement âgées. De tels profils ont déjà été détectés pour des étoiles géantes rouges, mais restent à confirmer pour des étoiles de type solaire.

Encadré 3. le nombre de Rossby: Le nombre de Rossby est un nombre clé pour comprendre la dynamique des systèmes en rotation. Du nom du célèbre physicien suédois, il compare l’influence du transport par la convection à celle de la force de Coriolis. Cette force est caractéristique des systèmes tournants au même titre que la force centrifuge, et a pour effet de dévier un objet en mouvement vers sa droite dans l’hémisphère Nord et vers sa gauche dans l’hémisphère Sud. Bien connue des météorologues, elle est la cause des mouvements cycloniques et anticycloniques sur Terre. Dans le Soleil, elle influence la convection de façon similaire, rendant alors ses mouvements « hélicoïdaux » (en forme de spirale ascendante ou descendante). Le nombre de Rossby sera d’autant plus faible que cette influence de la rotation est grande. Cependant, cette influence ne s’applique qu’aux plus grands mouvements, au-delà d’une extension spatiale appelée « rayon de déformation de Rossby ». Cela explique par exemple que sur Terre, les cyclones ont toujours un rayon supérieur à 100 km. Dans l’enveloppe convective solaire, ce rayon se situe entre 10 000 et 100 000 km en fonction de la profondeur, ce qui permet de délimiter les échelles de la turbulence convective ressentant, ou non, les effets de la rotation.

Certains profils de rotation favorisent les cycles d’activité magnétique, d’autres pas

Ce changement de profil de rotation interne affecte alors directement le comportement de la dynamo, certaines dynamos présentant alors des cycles et d’autres non. Sur la figure 9, nous montrons un diagramme de synthèse de l’état magnétique des étoiles selon leur nombre de Rossby, obtenu grâce à l’étude paramétrique publiée en 2022. On peut remarquer trois grandes classes :

– des dynamos cycliques à période courte (< 2 ans) pour les petits nombres de Rossby (en haut) ;

– des cycles longs pour les nombres de Rossby intermédiaires similaires au Soleil (au milieu) ;

– et enfin des dynamos sans cycle (« stationnaires ») pour les nombres de Rossby supérieurs à 1 (en bas).

Figure 9. « Diagrammes papillon » simulés pour les 3 types de dynamos. Il s’agit d’une représentation temps- latitude des polarités du champ magnétique poloïdal (en haut) et toroïdal (au milieu et en bas). La couleur rouge/bleu représente une polarité positive/négative. Trois cas de dynamos sont ainsi illustrés, soit avec un cycle magnétique court pour les plus faibles Ro (en haut), un cycle long de type solaire (au milieu) et sans cycle (en bas) pour les Ro les plus élevés. (Adapté de Brun et al., 2022)

« Antisolaire » : les étoiles dont le pôle tourne plus vite que l’équateur

Il semblerait donc que pour les rotateurs lents, un état de rotation antisolaire amène bien à la perte du cycle de la dynamo, qui devient alors stationnaire. Afin de confirmer cet état stationnaire dans le cas d‘une rotation antisolaire, l’équipe de chercheurs a entrepris une étude spécifique des dynamos antisolaires (publiée dans Noraz et al. 2022a), à partir d’un modèle à 2 dimensions réduit, mais plus rapide en temps de calcul, afin d’étendre l’espace des paramètres couverts.

Une partie de cette étude est résumée dans la figure 10, où sont illustrés différents chemins pour la boucle dynamo. Les conclusions confirment, comme dans le cas des simulations 3D, que les profils de rotation antisolaire donnent en majorité des dynamos sans cycle. Dans le cas solaire (ligne du bas #3), la boucle dynamo annule et renverse le champ aux pôles. On voit que les flèches du champ poloïdal se sont renversées entre la première et la dernière image de la rangée (dirigées vers le haut initialement, puis vers le bas finalement). Dans le cas antisolaire (ligne du haut #1), la boucle dynamo renforce au contraire, dans la plupart des cas, le champ aux pôles, et les flèches du champ poloïdal ne se renversent alors pas (elles restent orientées vers le haut). Néanmoins, des cycles magnétiques restent possibles avec rotations antisolaires, pour des modèles de dynamo spécifiques (ligne du milieu #2). Une détection de cycles magnétiques pour de telles étoiles (ou l’absence de cycles) serait donc une contrainte énorme pour différencier quel type de dynamo agit réellement au sein du Soleil, et prédire comment celui-ci évoluera. En attendant, il semble donc que les rotateurs lents aient une réelle probabilité d’avoir un magnétisme non cyclique.

Figure 10. Différents chemins possibles pour une dynamo stellaire. L’effet dit Ω à gauche, transforme les lignes de champ magnétique poloïdales (voir figure 4) en champ toroïdal par la rotation différentielle (cisaillement grande échelle). Son sens dépend du type de profil de rotation (solaire ou antisolaire). L’effet-α, à droite, permet de représenter l’impact de la convection hélicoïdale, transformant à l’inverse les lignes de champ toroïdales en composante poloïdale. En bas #3 : cas de référence solaire où la polarité magnétique globale est inversée à la fin de la boucle (dynamo AC). En haut #1 : cas de référence antisolaire où le cisaillement Ω est inversé, tout en considérant une paramétrisation α similaire. Cela conduit à une dynamo stationnaire sans cycle (dynamo DC). Au milieu #2 : cas antisolaire où le sens de l’effet-α est inversé, considérant alors le changement de nature de la convection à la base de l’enveloppe convective (passage d’un mouvement cyclonique à anticyclonique dans l’hémisphère Nord, et inversement pour l’hémisphère Sud). Ce cas très particulier conduit à une solution cyclique, comme dans le cas solaire. (Adapté de Noraz et al., 2022a).

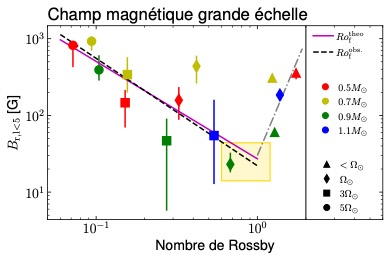

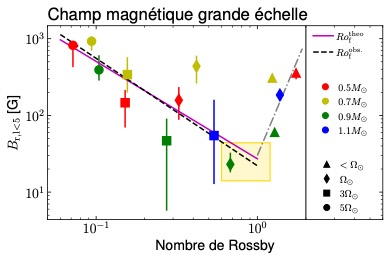

Cela veut-il dire pour autant que la géométrie magnétique globale principale de la simulation a changé ? Par exemple, passant de la domination d’un dipôle grande échelle (structures poloïdales de droite, schématisées en haut à gauche de la figure 4) à une structure de champ magnétique petites échelles, dite multipolaire (structures poloïdales de gauche schématisées en figure 4) ? Si tel était le cas, l’efficacité du freinage de la rotation par le vent en serait fortement réduite, car la taille du bras de levier appliqué par le champ magnétique le serait tout autant. Quand l’équipe de chercheurs étudie la géométrie magnétique globale des dynamos antisolaires et la compare aux rotateurs rapides, elle ne remarque cependant pas de changement flagrant de l’amplitude du dipôle (ou des autres composantes grandes échelles du champ magnétique). En effet, la figure 11 représente l’amplitude du dipôle dans les 15 simulations en fonction du nombre de Rossby, et la compare aux observations astronomiques. On remarque bien que, pour les Ro < 1, l’accord entre simulations et observations (courbes violette et noire) est très bon, confortant les auteurs que les simulations sont robustes et réalistes.

Figure 11. Amplitude du champ magnétique à grande échelle en fonction du nombre de Rossby dans les 15 simulations de dynamo convective stellaire. Les différentes couleurs/formes représentent les différentes masses/taux de rotation des étoiles simulées (exprimées en unité solaire ☉). Les barres reliées aux points représentent l’amplitude de variation de ce champ à grande échelle, qui peut être forte pour les cas à dynamo cycliques. Enfin, les courbes violette et noire représentent la tendance des simulations/observations pour Ro < 1. Le carré jaune pâle représente un possible minimum magnétique où certaines étoiles pourraient être piégées un certain temps, s’écartant ainsi de la relation classique rotation-âge (ou gyrochronologie). (Adapté de Brun et al., 2022)

A contrario, quand on considère les cas à Ro > 1, on remarque que l’amplitude de ceux-ci ne suit pas la même tendance, ni même une baisse encore plus abrupte de l’amplitude du dipôle. Bien au contraire, on voit une possible remontée du champ magnétique dipolaire. Le dipôle magnétique de la dynamo stationnaire au sein des rotateurs lents n’est donc pas négligeable ; au contraire, il semble même dominant. Dès lors, il semble peu probable que ce soit la disparition du dipôle magnétique qui mette en pause le ralentissement des étoiles suggéré par l’étude Kepler citée plus haut. Il est cependant intéressant de noter sur la figure 11 l’existence possible d’un minimum local du champ magnétique grande échelle vers l’âge du Soleil, indiqué par la petite boîte jaune. On peut donc se poser la question de savoir si des étoiles pourraient y rester « coincées », expliquant ainsi leur inefficacité à ralentir selon la loi de Skumanich en Ω(t) ~ t–1/2 (c.-à-d. la rotation de l’étoile ralentit comme l’inverse de la racine carrée du temps : plus l’étoile est âgée, moins elle tourne vite sur elle-même). Mais une fois ce minimum passé, les étoiles retrouvent a priori un freinage plus intense. La durée de cette phase de « calage/décrochage » (stalling en anglais) dépend de la forme du minimum, soit pour faire simple en forme de U ou de V. Cela peut avoir des conséquences sur l’âge des étoiles vieilles auquel on devrait ajouter cette période de stalling, pour corriger la gyrochronologie.

Figure 12. Représentation des étoiles candidates au profil antisolaire dans les observations Kepler, après filtrage et diagnostic en nombre de Rossby. On y retrouve notamment KIC 7189915, une étoile très similaire au Soleil, ainsi que KIC 12117868, une cible intéressante pour l’astéro-sismologie. (Adapté de Noraz et al., 2022b)

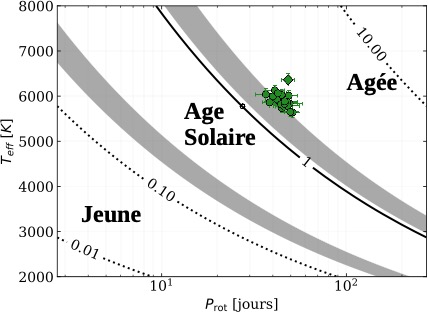

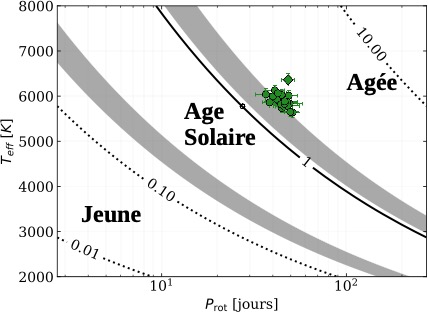

Dans ce contexte, l’équipe de chercheurs a entrepris l’identification d’étoiles candidates dans les données du satellite Kepler, dont le profil de rotation pourrait être antisolaire, afin de confirmer dans cette première étape l’existence de ce profil dans les vieilles étoiles de type solaire (Noraz et al., 2022b). La figure 12 représente ainsi un diagramme de la température de surface (effective) en fonction de la période de rotation en jour. Les étoiles de l’échantillon Kepler ayant un grand nombre de Rossby observationnel, et donc susceptibles de posséder une rotation antisolaire, sont marqués d’un symbole vert. Il s’agira maintenant de dédier un programme d’observations pour vérifier leur possible profil de rotation inversé, mais aussi pour caractériser leur champ magnétique. Cela nous apportera alors des informations sur la forme exacte du minimum de la figure 11, et donc sur le potentiel écart à la gyrochronologie illustré en figure 1. Cela permettra enfin de suivre leur activité magnétique sur le long terme, afin de savoir si elle est stationnaire ou cyclique.

Ce scénario magnéto-rotationnel des étoiles guidera en partie la mission spatiale de l’ESA PLATO pour lequel la France est fortement impliquée. En effet, la compréhension du magnétisme et de ses variabilités améliore la détection d’exoplanètes, souvent perturbée par l’activité magnétique de l’étoile hôte. L’étude sur le magnétisme des étoiles permet non seulement de reconstruire leur histoire magnéto-rotationnelle, mais peut également aider à mieux caractériser les nombreuses exoplanètes présentes dans notre environnement proche, et ainsi mieux contraindre nos connaissances sur les possibilités de vie au sein de notre Galaxie.

Par Quentin NORAZ, Allan Sacha BRUN & Antoine STRUGAREK, DAp-AIM/OSUPS

Publié dans le magazine L’Astronomie Juin 2023

Notes :

- Le moment cinétique est une grandeur utilisée pour décrire l’état général de rotation d’un système physique. Ainsi, comme la quantité de mouvement (« l’élan ») d’un système en translation uniforme ne sera pas modifiée si aucune force nette ne lui est appliquée (3e loi de Newton : principe d’inertie), le moment cinétique d’un système en rotation n’est pas modifié si aucun couple ne lui est appliqué. En considérant une conservation de cette grandeur, la vitesse de rotation peut être modifiée de façon caractéristique si la répartition des masses autour de l’axe de rotation l’est aussi (voir l’exemple de la pirouette du patineur et illustration en figure 2).

- La sublimation est le changement d’état d’un corps depuis l’état solide vers l’état gazeux, sans passer par l’état liquide.

- Le plasma est considéré comme le quatrième état de la matière, en plus de solide, liquide et gazeux. Il s’agit plus exactement d’un gaz ionisé, c’est-à-dire au sein duquel les électrons ont assez d’énergie pour se séparer des atomes. Au sein du Soleil, cet état est atteint grâce aux conditions extrêmes de température en son sein, allant de quelques milliers de degrés à sa surface, jusqu’à plusieurs millions en son centre.

- Le transport de l’énergie thermique par conduction (contact direct entre un corps chaud et un corps froid) est négligeable au sein des étoiles de type solaire.

- Le libre parcours moyen est la distance moyenne parcourue par une particule ou un photon, entre deux impacts successifs.

- Lorsque la croûte terrestre se forme au niveau d’une dorsale océanique par remontée de magma, certaines roches de ce dernier enregistrent l’aimantation globale présente lors de leur solidification. Les mouvements tectoniques engendrés vont alors éloigner progressivement ces roches de la dorsale par formation de nouvelles roches plus récentes, et permettent ainsi de remonter l’histoire du champ magnétique terrestre à mesure que l’on regarde des roches de plus en plus éloignées de la dorsale.

Références :

■ Noraz Q., Breton S. N., Brun A. S., García R. A., Strugarek A., Santos A. R. G., Mathur S., Amard L., 2022, Astronomy & Astrophysics, 667, A50, 2022.

■ Brun A. S., Strugarek A., Noraz Q., Perri B., Varela J., Augustson K., Charbonneau P., Toomre J., 2022, Astrophysical Journal, 926, 21, 2022.

■ Noraz Q., Brun A. S., Strugarek A., Depambour G., Astronomy & Astrophysics, 658, A144, 2022.

■ Ahuir J., Strugarek A., Brun A.-S., Mathis S., Astronomy & Astrophysics, 650, A126, 2021.

■ Strugarek A. et al., Science, 357, 185, 2017.

■ Van Saders J. L. et al., Nature , 529, 2016.

■ Thompson M. J. et al., « The Internal Rotation of the Sun », Annual Review of Astronomy and Astrophysics, 41, 2003, 599.

■ Garcia R. A. et al., « Tracking Solar Gravity Modes: The Dynamics of the Solar Core », Science, 316, 2007, 1591.

■ Monchaux R. et al., Physics of Fluids 21, 035108, 2009.

■ C. M. Cooper et al., Physics of Plasmas 21, 013505, 2014.

■ Newton Henry Black, Practical Physics, 1913.

par Sylvain Bouley | Oct 16, 2023 | Zoom Sur

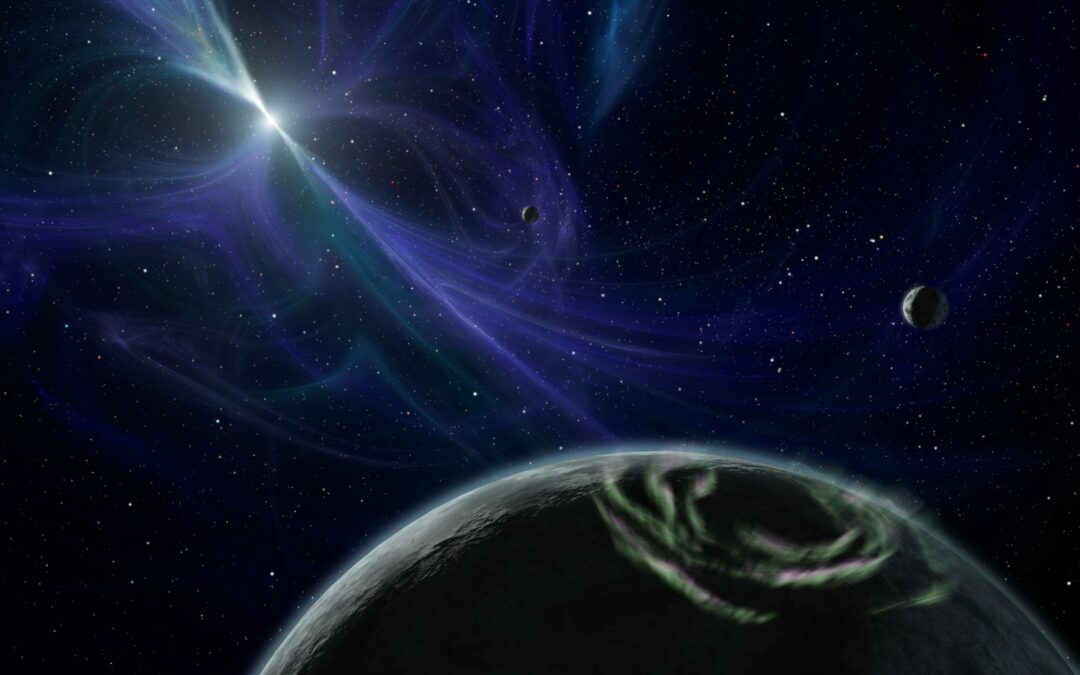

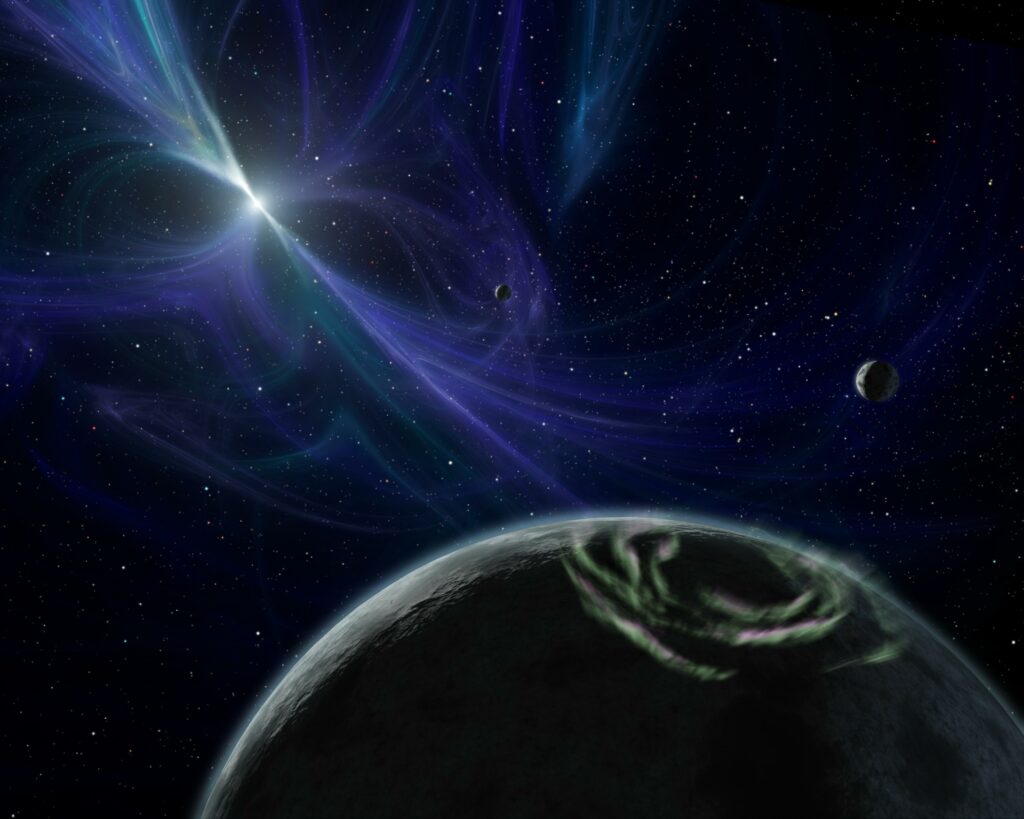

Samedi 25 mars, Jocelyn Bell Burnell a reçu à Paris le prix Jules-Janssen 2022 de la Société astronomique de France. En 1967, Jocelyn Bell préparait une thèse en radioastronomie sous la direction d’Antony Hewish. Sans l’avoir cherché, elle découvrit un signal d’un genre encore jamais observé, et qu’elle analysa. C’était le premier pulsar ; il fut baptisé CP 1919. Sa découverte allait prouver l’existence des étoiles à neutrons, objets de spéculations rigoureuses remontant aux années 1930, mais à l’observation desquelles tous les astronomes avaient renoncé. Nous allons montrer ici le lien entre les étoiles à neutrons et les pulsars.

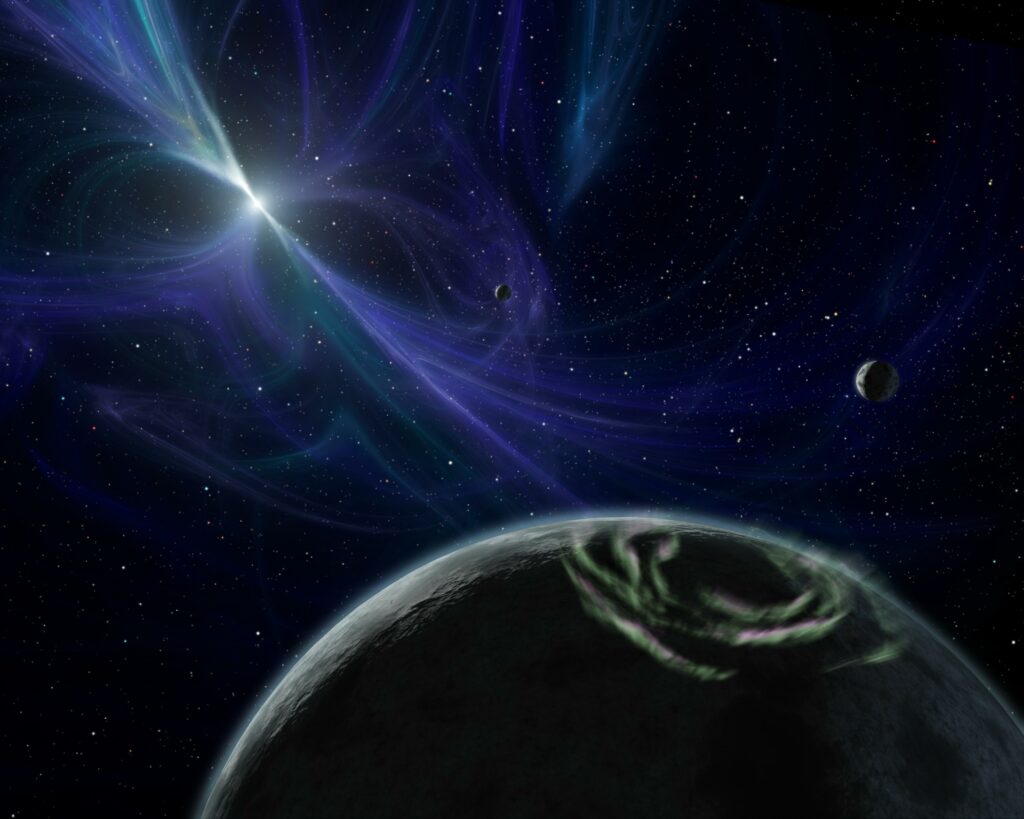

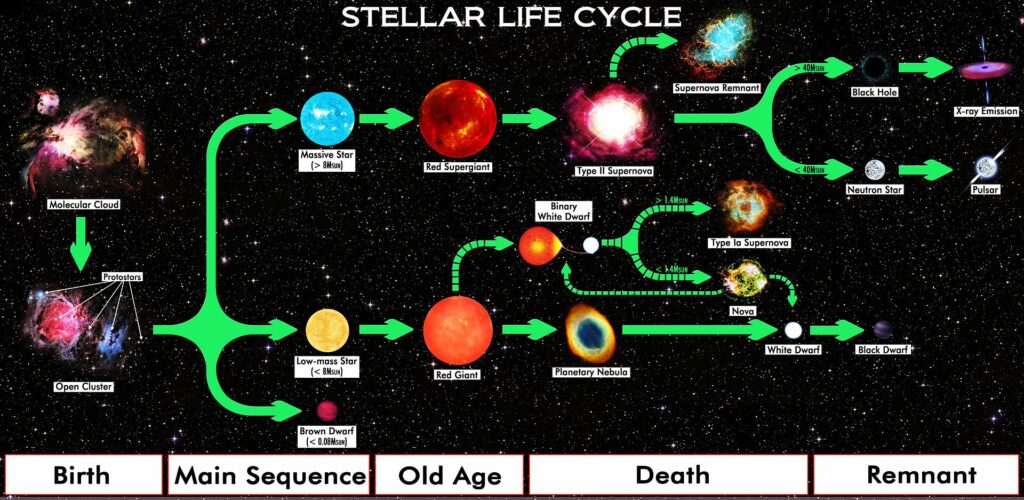

Dans les livres d’initiation à l’astronomie, il est très courant de décrire les étapes de l’existence d’une étoile comme celles d’une vie : elles commenceraient par naître, subir une sorte d’enfance, puis une vie d’adulte plus routinière mais active, et finissant par mourir. Dans les cours d’astronomie, les auteurs emploient plutôt les mots formation, évolution, catastrophes, et phase de dégénérescence. Mais parfois, dans le résumé d’un chapitre, le parallèle biologique peut revenir soudain avec une phrase comme : « Les étoiles de grande masse initiale finissent leur vie en supernovas [1]. » Pourquoi pas ? Mais de quoi parle-t-on en évoquant la mort ? Pour un animal, un humain, c’est une cessation totale d’activité, suivie, sauf dans de rares cas, d’un recyclage complet de la matière l’ayant composé, au bénéfice d’autres êtres vivants. D’un mort il ne reste rien sur Terre, sinon des souvenirs, et éventuellement une descendance.

Alors, si l’on fait ce parallèle, quand une étoile meurt-elle ?

Représentation de l’évolution d’une étoile en la comparant à celle d’un être vivant avec les phases de naissance (birth), vieillesse (old age) et mort (death). Selon cette terminologie, pour les étoiles de masse initiale supérieure à 8 masses solaires (massive stars), les étoiles à neutrons sont les restes (remnant) d’une étoile morte. Pourtant, ces restes présentent une activité observable parfois plus longtemps que celle de l’étoile lorsqu’elle était dans la séquence principale. (R.N. Bailey – CC BY 4.0, Wikimedia)

La mort nucléaire d’une étoile

Les étoiles dont la masse dépasse huit fois celle du Soleil brillent à peine plus de 20 ou 30 millions d’années. C’est peu en comparaison des dix milliards d’années attendues pour une étoile comme le Soleil. En effet, plus les étoiles sont massives, plus leur matière est comprimée sous leur propre poids, et moins leurs épaisses couches de matière empêchent le cœur de refroidir. Leurs régions internes sont donc très denses et chaudes, et cela favorise l’accomplissement rapide d’une succession de réactions nucléaires.

Les premières réactions qui font passer l’étoile de l’obscurité à la lumière transforment l’hydrogène en hélium. Ce faisant, elles libèrent de l’énergie sous forme de rayonnement gamma. Comme l’étoile est opaque, cette lumière de très haute énergie s’échappe difficilement des régions internes, ce qui fait monter la température. D’autres réactions nucléaires deviennent alors possibles. L’hélium se transforme en carbone, en azote, en oxygène. Ces réactions exigent des températures plus élevées, mais elles produisent aussi plus d’énergie par nouvel atome produit. à chaque fois, l’énergie libérée chauffe de plus en plus l’étoile. La pression est de plus en plus forte et pousse la matière vers l’extérieur. Si l’étoile a une masse de plus de huit fois celle du Soleil, le poids de l’étoile suffit à équilibrer les forces de pression. Bien que l’étoile passe par des phases de gigantisme où la pression l’emporte un peu sur la gravité, le cœur continue de chauffer, toujours écrasé sous la même masse de matière. Alors, l’hélium se transforme par fusion nucléaire en carbone, lui-même transformé en oxygène ; enfin, d’autres réactions nucléaires plus exigeantes en énergie permettent la fabrication d’éléments plus lourds, comme du silicium, de l’aluminium, et d’autres métaux.

La dernière étape est la formation de noyaux d’atomes de fer qui est un élément thermonucléairement inerte. Aucune libération d’énergie ne va plus dès lors s’opposer au processus de contraction du noyau. Les réactions nucléaires qui pourraient permettre de produire des atomes plus massifs que le fer libèrent moins d’énergie qu’elles n’en demandent. Alors, sous leur effet, la matière refroidit. En conséquence, les conditions de température exigées pour la poursuite des réactions nucléaires ne sont plus remplies et les réactions nucléaires cessent. Il n’y a donc plus de production de chaleur, ce qui diminue la pression. Sous l’effet de son propre poids qui n’est plus compensé par une pression suffisante, l’étoile commence à s’effondrer.

Il s’ensuit une explosion que l’on nomme « supernova ». Et comme cette explosion commence par l’effondrement de l’étoile sous son poids, ce sont les forces de gravitation qui initient le processus. On désigne donc cet événement comme une « supernova gravitationnelle ».

C’est à ce stade que le noyau de l’étoile massive se transforme en étoile à neutrons.

C’est aussi là que dans la métaphore avec le vivant, on fait mourir l’étoile. Pourtant, comme nous le verrons, ce qui reste après une supernova gravitationnelle n’est pas seulement la fin d’une histoire, ni un simple souvenir.

Mais pour comprendre d’où vient cette idée d’étoile à neutrons, faisons un saut de cent ans en arrière.

La découverte du neutron

James Chadwick (1891-1974), physicien atomiste anglais, travaillait à Cambridge sous la direction d’Ernest Rutherford. Rutherford avait découvert le proton en 1919, dont la masse était correctement estimée à environ 1 836 fois celle de l’électron.

On savait aussi qu’un atome est composé d’un noyau contenant des protons, entouré, bien plus loin, d’un cortège d’électrons ; or, la masse du noyau excède de beaucoup celle de ses protons. Par exemple, un noyau d’hélium a une masse proche de 4 (en masses de protons) mais seulement 2 protons. Il manque en masse l’équivalent de deux protons.

Fallait-il renoncer à la conservation de la charge, en considérant un noyau d’hélium formé de 4 protons, soit 2 protons « normaux » et 2 protons en plus annihilant leur charge ? Une autre solution moins révolutionnaire, proposée entre autres par Rutherford, supposait la présence de particules neutres dans le noyau. Chadwick les appela les neutrons. Il restait à les découvrir, et à les caractériser. Chadwick reprit une expérience menée par d’autres physiciens quelques années auparavant, et réalisa ce programme. Il publia en 1932 un article sobrement intitulé : « Possible Existence of Neutron ». En 1935, cette découverte lui valut le prix Nobel (lire l’encadré 1).

Mais bien avant 1935, seulement quelques mois après la publication de l’article de Chadwick, des astronomes se demandèrent si l’existence d’une étoile entièrement constituée de neutrons serait possible.

La découverte du neutron

Chadwick s’intéressa à une expérience initialement menée en 1930 par Walter Bothe* et Herbert Becker, où du béryllium est bombardé par des noyaux d’hélium issus du rayonnement cosmique. On avait constaté que les rayons cosmiques arrivant sur des éléments légers émettent des rayonnements « ultra-pénétrants », c’est-à-dire dont les effets se font sentir même à travers plusieurs centimètres de matière solide. Chadwick allait caractériser ces rayonnements. Ces derniers activent des réactions nucléaires. Quelle était leur nature ? Irène et Frédéric Joliot-Curie (1931)** développèrent une théorie supposant des rayons gamma de 50 MeV. En 1932, Chadwick reprit l’expérience. Avec l’hélium et le béryllium, les collisions produisent un noyau de carbone, et ce fameux rayonnement inconnu. Chadwick conclut de son étude que ces « rayonnements » étaient en fait des particules neutres (les neutrons), et la réaction observée était la suivante : 4He + 9Be → 12C + 1 neutron. Cette formule a le mérite de conserver le nombre de protons, le nombre de neutrons, de conserver la charge électrique. Son bilan énergétique permit à Chadwick de conclure que la masse des neutrons est 1,001 masse du proton, donc à peine supérieure à celle du proton. Il montra aussi que le neutron n’est pas la réunion d’un proton et d’un électron (comme le serait une sorte d’atome d’hydrogène ultra-compact), mais bien une particule en soi***.

* Lauréat du prix Nobel de physique en 1954. – ** Tous deux lauréats du prix Nobel de chimie en 1935. – *** Si un proton était la somme d’un électron et d’un proton, sa masse serait inférieure à la somme des deux masses – une partie de celle-ci étant prise par l’interaction entre les deux particules. Mais en fait, la masse du neutron est supérieure à celle des deux particules isolées. Après l’expérience de Chadwick, on a découvert que la fusion d’un proton et d’un électron produit un neutron plus un neutrino. Le neutrino de cette réaction est une autre manière de se convaincre que le neutron n’est pas la simple somme d’un proton et d’un électron.

Le cœur dégénéré des étoiles froides

Les années où l’on découvrit l’existence du neutron furent aussi celles où l’on posa les fondements de la physique quantique. La physique quantique permit de mettre en évidence deux grandes familles de particules, les bosons dont font partie les photons, et les fermions dont font partie les électrons, les protons et les neutrons ainsi que les neutrinos. Or, les fermions sont des particules qui doivent toutes être dans un état différent ; autrement dit, il n’y a pas deux neutrinos dans tout l’Univers qui soient dans le même état. Un état étant caractérisé par leur énergie, leur position et leur spin, il est impossible d’empiler un nombre quelconque de fermions (d’énergie finie) dans un petit espace (lire l’encadré 2).

Notons une propriété plutôt contre-intuitive : les fermions les plus légers sont ceux qui réclament le plus d’espace. Ainsi, l’espace qui permettra d’empiler N électrons devra être plus grand que l’espace permettant d’empiler N neutrons. Dans une étoile, lorsqu’elle refroidit quand il n’y a pas de réactions nucléaires pour la chauffer, cela prend une grande importance. En effet l’étoile ne s’effondre pas totalement puisque les fermions qui la constituent s’opposent à ce que toute la matière soit rassemblée dans un minuscule volume.

En raison de cette impossibilité, les assemblées de fermions (solides, liquides ou gazeuses) réagissent comme si elles étaient soumises à une force de pression pouvant devenir très forte quand on atteint de hautes densités. Cet effet est une pression, mais elle n’est plus contrôlée par la température. Elle dépend principalement de la densité des fermions les plus légers. On l’appelle la pression de Fermi, et la matière contrôlée par la pression de Fermi est dite « dégénérée ».

Considérons par exemple une étoile de masse semblable au Soleil, qui aurait cessé son activité nucléaire. La matière tombe vers le centre, augmentant sa densité, jusqu’à ce que la pression de Fermi devienne importante. Ce sont les électrons, les plus exigeants en espace, qui contrôlent cette pression. Donc, pour une étoile dégénérée comme le deviendra le Soleil, on atteint sous l’effet de la pression de Fermi des électrons une densité d’environ une tonne par centimètre cube. Les étoiles régies par la pression de Fermi des électrons sont bien connues des astronomes : ce sont les naines blanches, que les astronomes ont découvertes dans les années 1910. L’explication de leur extrême densité et du rôle de la pression de Fermi des électrons fut donnée par l’astronome britannique Ralph Fowler en 1927.

Mais voilà qu’au début des années 1930, un étudiant indien de Fowler, Subrahmanyan Chandrasekhar, décida d’appliquer les lois de la relativité restreinte aux naines blanches. Il découvrit qu’au-delà de 1,4 masse solaire, la pression de Fermi ne peut contrer les forces de gravité. Le physicien soviétique Lev Landau [2] découvrait indépendamment la même limite en 1932. Au-delà de cette masse, l’étoile doit s’effondrer. Mais en quoi ?

L’astronome (génial) qui régnait alors sur l’astronomie britannique, Sir Arthur Eddington, n’était pas convaincu de l’effondrement des naines blanches au-delà de 1,4 masse solaire. Il fit cette remarque demeurée célèbre, lors d’un congrès en 1935 : « Je pense qu’il doit exister une loi de la nature qui empêche une étoile de se comporter de façon aussi absurde. »

Cependant, d’autres physiciens s’étaient convaincus, suite à la découverte de Chadwick, qu’en éliminant les électrons, la nature pourrait former des gaz comportant uniquement des neutrons. Ce serait un gaz neutre, donc dépourvu de forces électriques, mais contrôlé par la pression de Fermi. Et comme celle-ci permet de mettre plus de neutrons dans un même volume, un gaz de neutrons serait beaucoup plus dense. Ainsi, l’on pourrait former des étoiles extrêmement denses composées uniquement, ou presque, de neutrons.

En 1932, Lev Landau s’était demandé si le cœur des étoiles, même les plus normales, pourrait être constitué d’un tel gaz de neutrons. La découverte quelques années plus tard des réactions nucléaires opérant au sein des étoiles lui donna tort. Mais si les bonnes idées meurent quelque part, elles renaissent souvent ailleurs. En 1934, deux astronomes travaillant aux États-Unis, Walter Baade et Fritz Zwicky, écrivirent un article très court, sans démonstration, où ils proposaient qu’il existerait des étoiles uniquement composées de neutrons, qu’elles seraient la phase ultime de l’évolution stellaire, que les supernovas seraient la transition entre les étoiles normales et les étoiles à neutrons, et (cerise sur le gâteau) que les supernovas seraient à l’origine des rayons cosmiques. Géniale intuition : bien que rien ne fût prouvé dans cet article, l’histoire allait montrer que les auteurs « avaient tout bon ».

Les particules qui se laissent empiler, et celles qui résistent

Les fondations de la mécanique quantique ont mis en évidence deux familles de particules, les bosons et les fermions. Elles se distinguent en pratique par leur capacité à « se laisser empiler ». Plus précisément, on considère les caractéristiques possibles des particules : leur vitesse ou leur énergie, leur position, et une grandeur qui ne se manifeste qu’en mécanique quantique : l’orientation de leur spin. Le spin, c’est comme si les particules étaient de minuscules toupies, et l’orientation du spin caractériserait leur axe de rotation. Par ailleurs, le spin de chaque particule a une valeur bien déterminée. Par exemple, 0 pour les photons, et 1/2 pour les électrons, les protons… et les neutrons. Cette valeur de spin est très importante, et les physiciens ont donné le nom de « bosons » aux particules ayant un spin entier, comme le photon, et le nom de « fermion » aux particules à spin demi-entier. La théorie de la mécanique quantique et les expériences montrent qu’il peut exister plusieurs bosons ayant exactement les mêmes caractéristiques. Donc, on peut en mettre beaucoup, avec la même énergie au même endroit. Par exemple, on peut (avec des lasers) avoir de grandes concentrations de photons ayant à peu près tous la même énergie. En revanche, il ne peut y avoir deux fermions ayant exactement les mêmes caractéristiques. C’est la propriété importante qui les distingue des bosons. On nomme souvent cette propriété « le principe d’exclusion de Pauli ». Il ne peut y avoir deux fermions au même endroit avec la même énergie, avec la même orientation de spin. Comme l’orientation de spin peut prendre deux valeurs, en considérant des neutrons de faible énergie, on ne peut pas en empiler un nombre infini dans un petit espace.

Comment une étoile peut-elle être formée majoritairement de neutrons ?

Une étoile normale est formée d’atomes. Ceux-ci contiennent des protons, des neutrons et des électrons. Comment cela peut-il donner à la fin une étoile formée seulement de neutrons ?

Sous l’effet des pressions formidables que subissent les étoiles dont le cœur dépasse la masse fatidique de Chandrasekhar de 1,4 masse solaire, il se produit une réaction au cours de laquelle un proton et un électron fusionnent, pour produire un neutron et un neutrino. Le neutrino est une particule extrêmement légère, électriquement neutre, soumise seulement à l’interaction faible.

Les supernovas gravitationnelles, comme mentionné au début du présent article, caractérisent le moment où ces réactions ont lieu. La majorité des neutrons soumis à l’effet de leur masse, à l’écrasement par la matière de l’étoile qui continue à leur tomber dessus et à des interactions de type nucléaire avec d’autres neutrons, restent dans l’étoile. En revanche, les neutrinos s’échappent. Il reste donc à la fin une étoile majoritairement formée de neutrons. On l’appelle donc simplement « une étoile à neutrons ».

Bien entendu, une étoile massive et dense comme une étoile à neutrons est soumise à des effets de gravitation extrêmement forts. Or, depuis 1916, on savait que dans le régime de gravitation forte, il faut renoncer à la théorie classique de Newton, mais appliquer la relativité générale d’Einstein. Alors, trois physiciens, Richard Tolmann, Robert Oppenheimer (le futur directeur du programme de la bombe atomique américaine) et George Volkoff, posaient les équations de l’équilibre d’une étoile sphérique uniquement composée de neutrons, dans le régime de la relativité générale. Ils les publièrent en 1939, ainsi que les solutions qu’ils obtenaient. On les considère toujours comme valides, et on les nomme les équations TOV, initiales des noms des trois auteurs. Les solutions qu’ils trouvaient donnaient une densité en effet assez proche de la densité du noyau atomique. D’un point de vue astronomique, c’était cependant assez décevant : une étoile à neutrons ne pouvait excéder 0,7 masse solaire (limite révisée depuis), et une telle étoile tiendrait dans une sphère d’une dizaine de kilomètres de rayon. Or, la luminosité d’une étoile, si elle dépend de la puissance 4 de sa température, est aussi proportionnelle à sa surface. Une si petite étoile a une surface minuscule. Même chauffées à quelques millions de degrés, les étoiles à neutrons s’avéraient inobservables avec les télescopes de l’époque.

Les étoiles à neutrons entrèrent donc dans le placard des idées théoriques un peu folles et invérifiables expérimentalement. On les plaçait même, vu leurs propriétés incroyables et excessives, sur l’étagère des monstres. Puis la Seconde Guerre mondiale donna aux physiciens des occupations plus urgentes (et monstrueuses également). Quelques années plus tard, même avec la fin de cette guerre, les étoiles à neutrons demeuraient hors du champ des préoccupations des astronomes « normaux[3] ».

Le sujet survivait cependant, avec des chercheurs comme John Archibald Wheeler, Fritz Zwicky qui ne renonçait pas à son idée, et Andrew Cameron.

Ils s’intéressaient par exemple au problème de la masse limite de 0,7 masse solaire. Si une supernova causait l’effondrement d’un cœur plus massif, qu’adviendrait-il des neutrons correspondant à la masse excédentaire ? Seraient-ils expulsés lors de l’explosion ? évaporés ? ou bien l’étoile continuerait-elle de s’effondrer… en trou noir ? un concept encore plus spéculatif à cette époque.

Ces auteurs comprirent que si l’étoile à neutrons atteint la densité du noyau atomique, alors les effets de l’interaction nucléaire devaient s’ajouter à la pression de Fermi des neutrons. Le problème était la relative ignorance que l’on avait (et que l’on a encore en partie) de l’interaction forte. Cependant, on fit des calculs en se fondant sur ce qu’on avait appris dans les accélérateurs de particules avec des interactions à trois neutrons… en les extrapolant avec astuce à un très grand nombre de neutrons. La masse limite des étoiles à neutrons fut repoussée à 2 ou 3 masses solaires. Cela ne les rendait toujours pas observables, mais au moins cela leur donnait une plus grande étendue de masses possibles, donc de plus grandes chances d’exister.

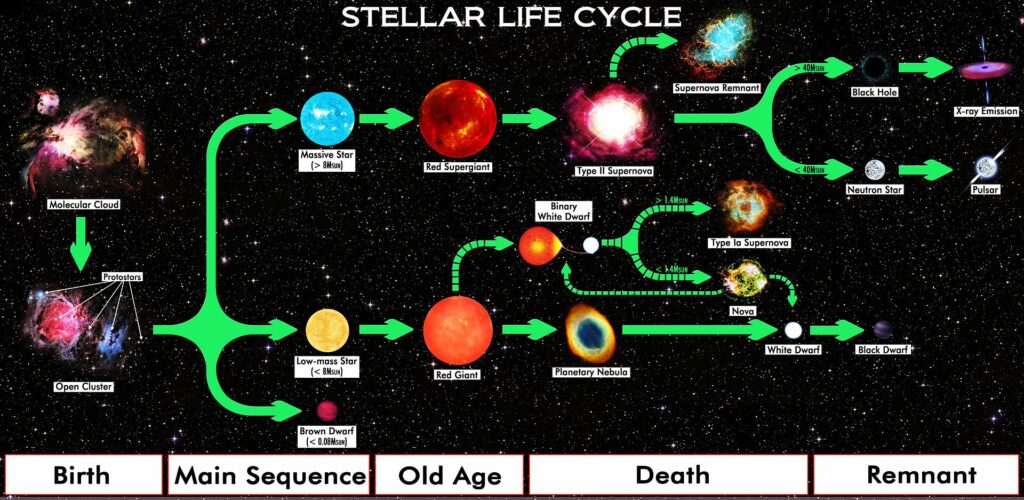

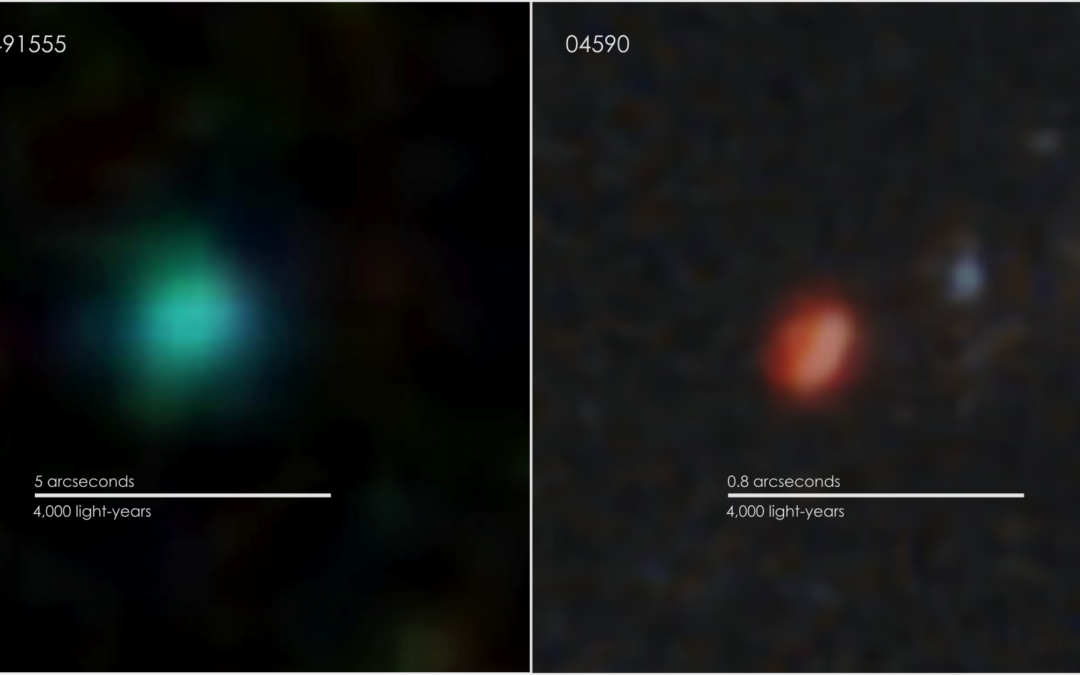

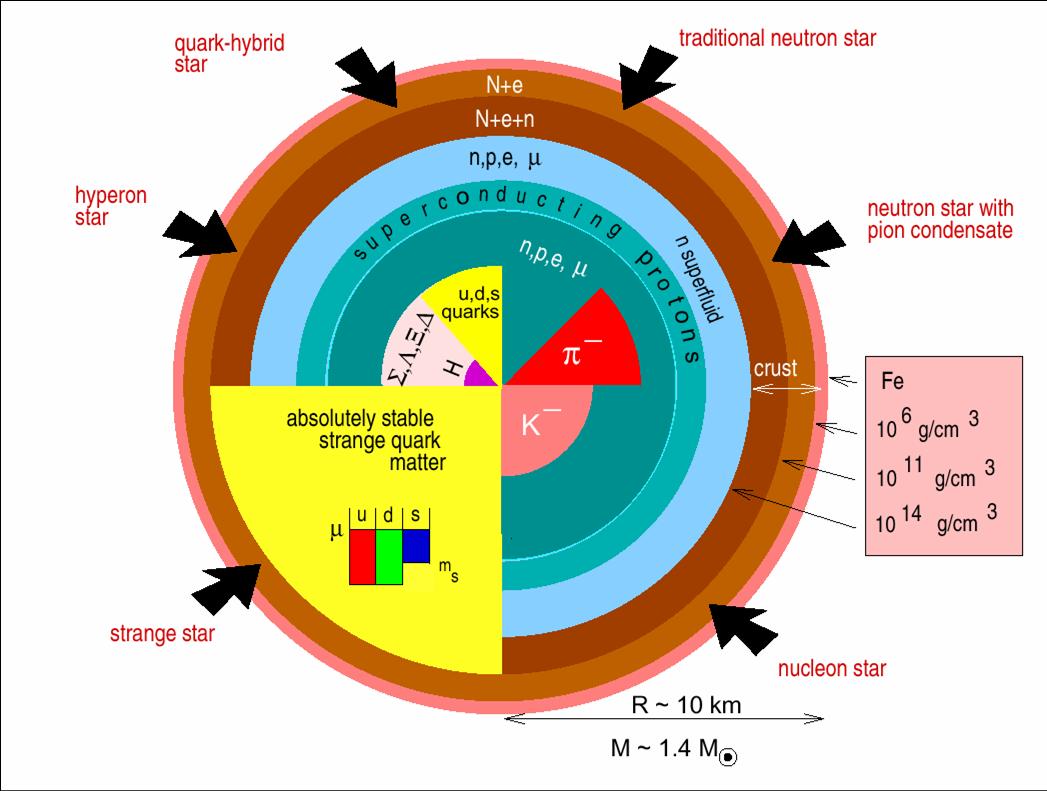

De nos jours, plusieurs modèles possibles d’intérieurs d’étoiles à neutrons ont été développés. Des observations ont déjà permis d’en éliminer certains, mais il en reste un très grand nombre, et tous ne supposent pas que le cœur d’une étoile à neutrons soit uniquement formé de neutrons. Il pourrait y avoir d’autres particules, considérées comme instables dans des conditions de pression moindres. Parmi tous ces modèles, il est possible que plus d’un soit correct, et qu’il existe en fait plusieurs types d’étoiles à neutrons. Notons que les neutrons sont formés de l’association de trois particules élémentaires, appelées des quarks up et down. Sous des densités encore plus élevées que dans les étoiles à neutrons, les neutrons se seraient eux-mêmes effondrés, laissant place à leurs composants élémentaires et formant un vaste mélange de quarks, que l’on appellerait une étoile à quarks, qui aurait une masse proche de celle des étoiles à neutrons et un rayon légèrement plus petit.

Plusieurs modèles existent sur la composition interne d’une étoile à neutrons.

Coupe d’une étoile à neutrons, du centre vers la surface, pour plusieurs modèles d’étoiles à neutrons, dont le nom associé aux particules « exotiques » qu’on y trouve est signalé en rouge : étoile à nucléons, avec condensat de pions, modèle « traditionnel », avec un noyau de quarks, avec des hypérons, et étoile étrange presque entièrement composée de quarks. Selon les connaissances actuelles sur les interactions régissant les particules de la famille des neutrons (les hadrons), encore incomplètes, plusieurs modèles font intervenir d’autres particules que les neutrons. Ces particules sont très instables dans des milieux de plus faible densité, et on ne les observe que brièvement dans les collisionneurs dédiés à l’étude de la physique des particules élémentaires. Il se pourrait même que les neutrons s’effondrent eux-mêmes en des particules plus élémentaires, les quarks, et forment un mélange de quarks, contenant notamment des quarks dits « étranges » (une des 6 catégories de quarks connues), qui donneraient leur nom d’étoiles à quarks ou étoiles étranges à ces astres assez semblables (du dehors) à des étoiles à neutrons.

La surface des étoiles à neutrons

Notons que si les neutrons constituent la composante essentielle de ces étoiles, c’est seulement dans les parties internes, où les électrons sont maintenus sous l’effet énorme de leur poids. Mais dans les parties externes, on s’attendait à un mélange d’atomes de fer (noyaux très enrichis en neutrons), mêlés à des protons et à des électrons circulant librement, et peut-être à d’autres noyaux atomiques. Puis il fut établi que sous l’effet d’écrasement du fer par la gravité extrême de l’étoile, malgré des températures élevées (estimées aujourd’hui à des centaines de milliers de degrés), le fer serait sous forme solide, cristalline. Donc, cette étoile serait recouverte d’une croûte métallique extrêmement dense et chaude.

La découverte des pulsars et le questionnement sur leur nature

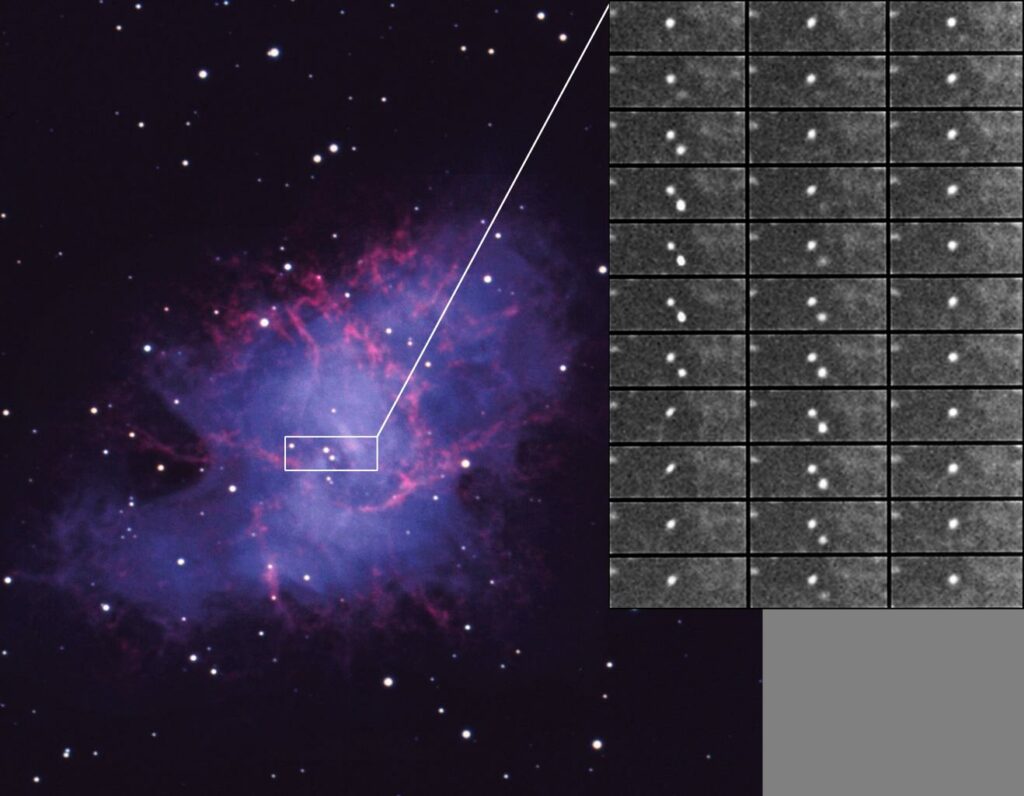

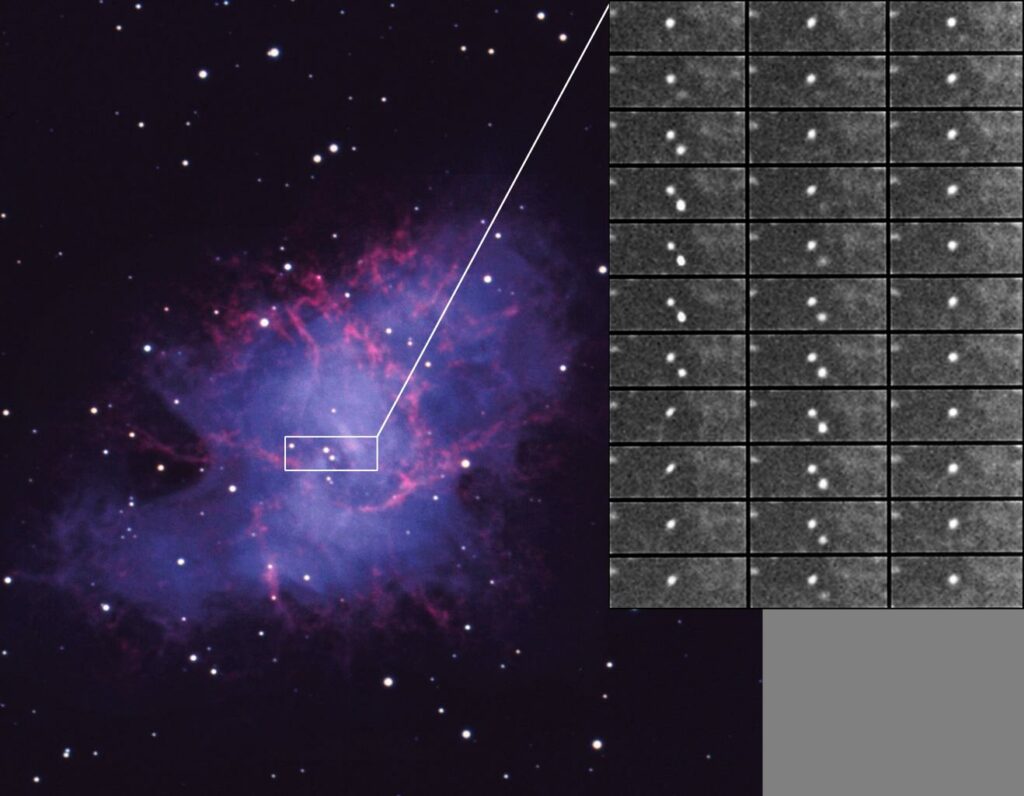

Andrew Cameron émit l’idée, vers 1966, que la petite étoile atypique découverte au cœur de la nébuleuse du Crabe, vestige d’une explosion de supernova, pouvait effectivement être une étoile à neutrons. Mais il ne proposa pas d’en chercher les émissions radio.

Dans les années 1930 et 1940, du temps des premières théories des étoiles à neutrons, la radioastronomie était une science balbutiante, et l’on ne se doutait pas que c’est grâce aux ondes radio que l’on prouverait leur existence. De plus, jusqu’au milieu des années 1960, les spécialistes des étoiles à neutrons s’intéressaient surtout à ce qu’il y avait dedans. Or, la cause de leur rayonnement puissant est liée à ce qu’il y a autour.

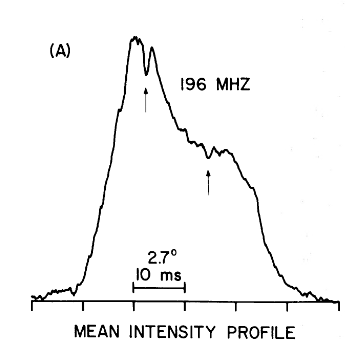

En 1967, une étudiante en thèse sous la direction d’Antony Hewish, Jocelyn Bell, découvrait, en cherchant tout autre chose, un signal radio se répétant périodiquement, avec une période de 1,33 seconde. Intriguée, elle fit les tests habituels : cette source, si elle était cosmique, devait réapparaître au même endroit apparent du ciel avec une périodicité d’un jour sidéral, 23 h 56 min, comme les étoiles. Ce fut le cas. Cette source fut nommée CP 1919, car elle se trouvait à une ascension droite de 19 heures et 19 minutes.

Pendant quelques mois, l’équipe ne publia pas cette découverte. Il fallait d’abord proposer des explications.

Un peu par dérision, on appela ce signal « petits hommes verts », comme si c’était les manifestations d’une civilisation extraterrestre. Mais on envisagea plus sérieusement la possibilité de rayonnement associé à une étoile variable pulsante à très courte période (1,33 seconde) : une « pulsating star ». Seul succès de ce modèle, le mot composé « pulsating star » est resté, mais agrégé en un seul mot : « pulsar ». Pour qu’une étoile oscille aussi rapidement, elle devait probablement être très petite.

Il y avait d’autres idées : on pensa (à raison) que ces impulsions pouvaient provenir d’une étoile en rotation rapide qui émettrait continûment des ondes radio dans un faisceau de directions assez restreint, à la manière d’un phare. À chaque tour, lorsque nous passerions dans le faisceau, nous capterions ces ondes radio, et cela donnerait une impulsion. Pour qu’une étoile tourne sur elle-même en 1,33 seconde sans être détruite par les forces centripètes, il fallait qu’elle soit petite. Ce pouvait être une naine blanche… ou une de ces fameuses étoiles à neutrons.

L’article fut publié avec l’énonciation de ces hypothèses [4].

Ce fut un véritable succès. Très rapidement, des astronomes pointèrent leurs radiotélescopes à la recherche d’autres sources. Et bien entendu, ils voulurent vérifier l’hypothèse de Cameron à propos de la nébuleuse du Crabe. Et dans cette région, ils découvrirent une émission pulsée avec une période de seulement 33 millisecondes. En admettant qu’il s’agissait d’un objet tournant, il ne pouvait avoir les dimensions d’une naine blanche (quelques milliers de kilomètres) trop grande pour résister à l’effet centrifuge. Ce devait être un astre plus petit : une étoile à neutrons.

Les radioastronomes, dans la foulée de CP 1919 et du Crabe, détectèrent un pulsar associé à la nébuleuse des Voiles (Vela), qui est également un reste de supernova. Et l’on en découvrit une dizaine d’autres. Aujourd’hui, on en connaît plus de 2 000, et on estime leur nombre dans notre Galaxie à plus de 100 000.

Le Crabe a une période de 33 millisecondes, ce qui correspond à une fréquence d’environ 30 Hz. Vela a une période de 89 ms, soit une fréquence de 11 Hz, et CP 1919 a une période de 1,33 s, soit une fréquence de 0,75 Hz. Il y eut encore des travaux sur des émissions pulsées non liées à la rotation d’une étoile, de plus en plus souvent pour en contester la validité. La grande régularité des pulsations était facilement explicable pour un objet tournant et très massif, mais moins pour des oscillations, dont le spectre de fréquences n’a quasiment jamais une seule fréquence, comme c’était observé, ni la même stabilité.

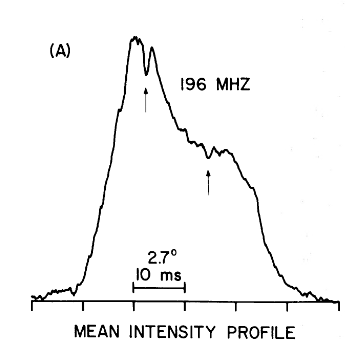

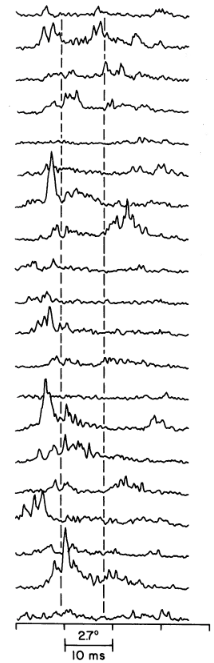

Le profil d’émission radio du pulsar PSR 1919+21, pour une bande de fréquences centrée sur 196 MHz, résulte de la moyenne d’observations sur un ensemble de 1 300 périodes du pulsar. Faire des moyennes de ce type est généralement le seul moyen pour mettre en évidence le profil d’émission d’un pulsar. Cela suppose de connaître à l’avance sa période. C’est pour cela que la découverte de nouveaux pulsars (donc de période inconnue) ne va pas de soi, surtout s’ils nous envoient un signal de faible intensité. Cela demande l’application de méthodes spécifiques d’analyse du signal et des traitements numériques significatifs. (L. J. Cordes, The Astrophysical Journal 195:193-202, 1975)

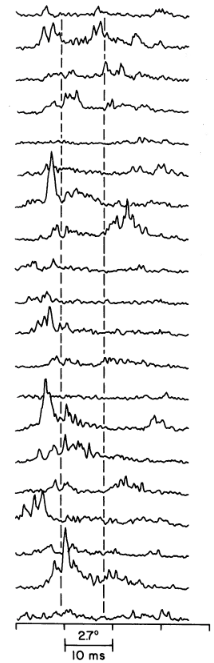

Observation du pulsar PSR 1919+21, découvert par Jocelyn Bell. Le temps est en abscisses, et l’intensité du signal est en ordonnées. Dans cette séquence, les observations à 20 instants différents sont présentées, toutes recalées sur la périodicité de 1,33 seconde du pulsar. Ces observations ont été centrées sur la fréquence de 111,5 MHz. Il est difficile de remarquer la périodicité du signal au premier coup d’œil, d’abord parce que le pulsar, s’il a la régularité d’une horloge, n’émet pas forcément avec la même intensité à chaque période, et d’autre part à cause d’effets de propagation du signal à travers le milieu interstellaire, notamment des effets de scintillation. C’est donc en effectuant une moyenne sur plusieurs périodes que l’on peut faire clairement apparaître la forme du signal d’un pulsar (cf. la figure suivante). (L. J. Cordes, The Astrophysical Journal 195:193-202, 1975)

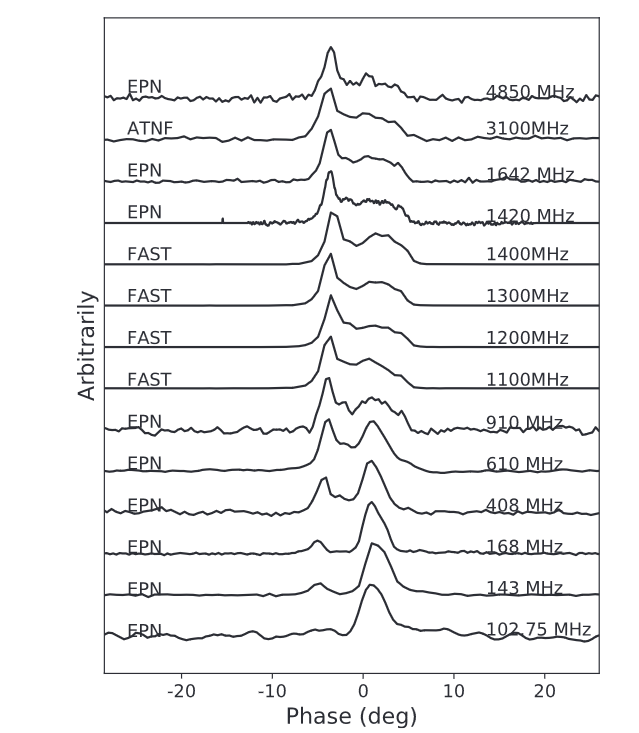

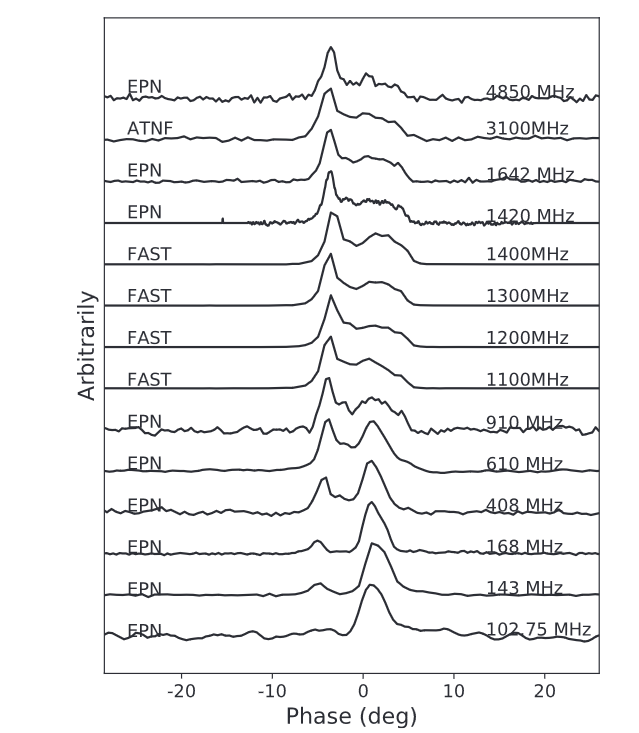

Profil radio moyen du pulsar B1737+13, à différentes fréquences du domaine radio. L’axe horizontal indique le temps divisé par la période du pulsar, et centré au maximum de l’émission. La période est de 0,803 seconde. Seulement 50 % de la période est montrée, car il n’y a pas de signal le reste du temps. L’axe vertical indique l’intensité du rayonnement radio, dans une bande de fréquence centrée sur la valeur indiquée. Ces observations ont été faites avec trois radiotélescopes (chacun d’entre eux ne couvrant pas toutes les fréquences), en Europe, en Australie et en Chine. Ce pulsar est un des rares dont le profil d’émission possède pas moins de 5 maxima d’émission.

(Q. J. Zhi et al., The Astrophysical Journal 926:73, 2022)

Les étoiles à neutrons sortent de l’oubli incrédule

Les radioastronomes étaient frappés par le caractère extrêmement régulier des pulsations. Alors, afin d’en éprouver les limites, ils en firent un chronométrage sur le long terme à l’aide d’horloges atomiques. Et l’on découvrit une variation continue de la période qui consistait en un accroissement très lent et régulier. Par exemple, chaque seconde, la période du pulsar du Crabe s’accroît de 10-12 seconde. L’accroissement est analogue pour le pulsar Vela. Mais pour la plupart des autres pulsars alors découverts, dont la période était de l’ordre d’une seconde, la dérive est comprise entre 10-14 et 10-16 seconde par seconde. C’est très peu, mais en quelques mois d’observation avec de bonnes horloges, c’était mesurable.

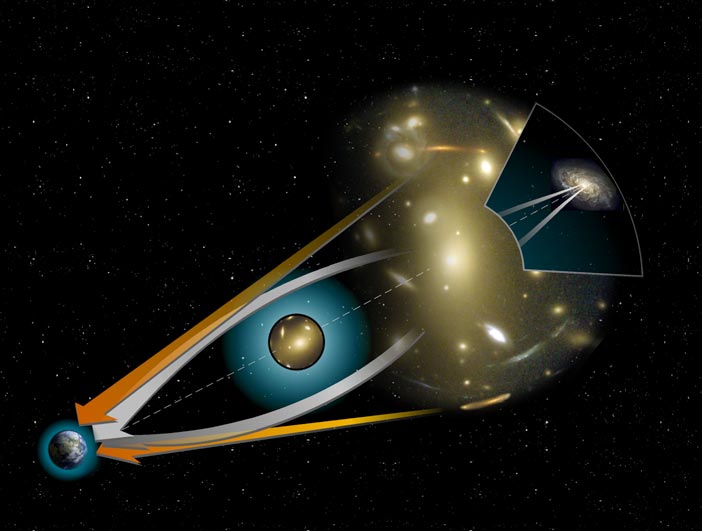

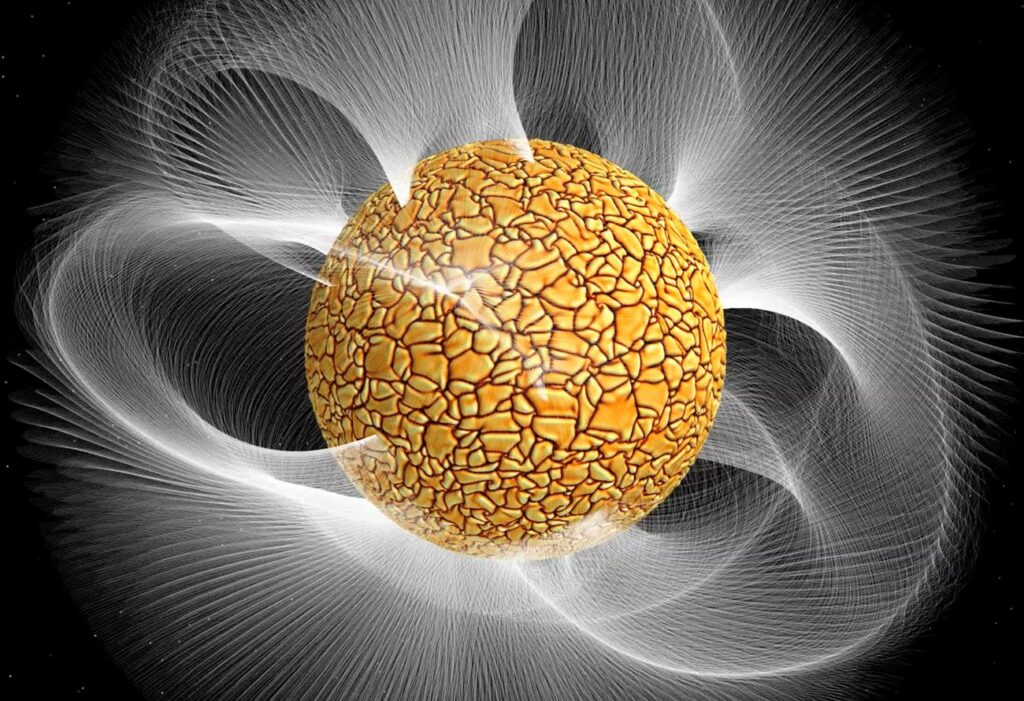

Le physicien italien Pacini, alors aux États-Unis, s’intéressait beaucoup à l’hypothèse des étoiles à neutrons pour expliquer les pulsars. Il remarqua en 1968 que si une étoile géante avec un champ magnétique en surface typique de ce genre d’étoiles s’effondre, alors le champ magnétique est entraîné avec la matière [5]. Plus précisément, le flux magnétique est conservé, c’est-à-dire que le champ magnétique multiplié par la surface de l’étoile est constant. Comme la surface de l’étoile devenait minuscule, le champ magnétique devait être énorme. Pour une étoile à neutrons, il estima un champ de l’ordre de 10-8 teslas [6]. Quelques mois plus tard, il publiait un autre article reprenant les travaux conduits vers 1950 par un autre astronome, Armin Deutsch, où il était expliqué (calculs à l’appui) qu’une étoile en rotation avec un champ magnétique non aligné (c’est-à-dire que l’axe de symétrie du champ magnétique ne coïncide pas avec l’axe de rotation) se comporte comme une antenne électrique rayonnant à la fréquence correspondant à la rotation de l’étoile. Avec les pulsars, Pacini montrait qu’on avait donc des antennes avec un champ très puissant émettant des ondes à des fréquences de l’ordre de 1 à 100 Hz (par exemple 30 Hz pour le pulsar du Crabe). Il calcula une puissance émise par ces antennes, et il montra qu’elle était compatible avec la puissance perdue avec le ralentissement de la rotation des étoiles, pourvu qu’elles aient les caractéristiques d’une étoile à neutrons. Autrement dit, le rayonnement électromagnétique associé à la rotation des étoiles à neutrons expliquait leur ralentissement progressif.

A ce stade, il était quasiment prouvé que les pulsars observés en ondes radio étaient une manifestation des étoiles à neutrons.

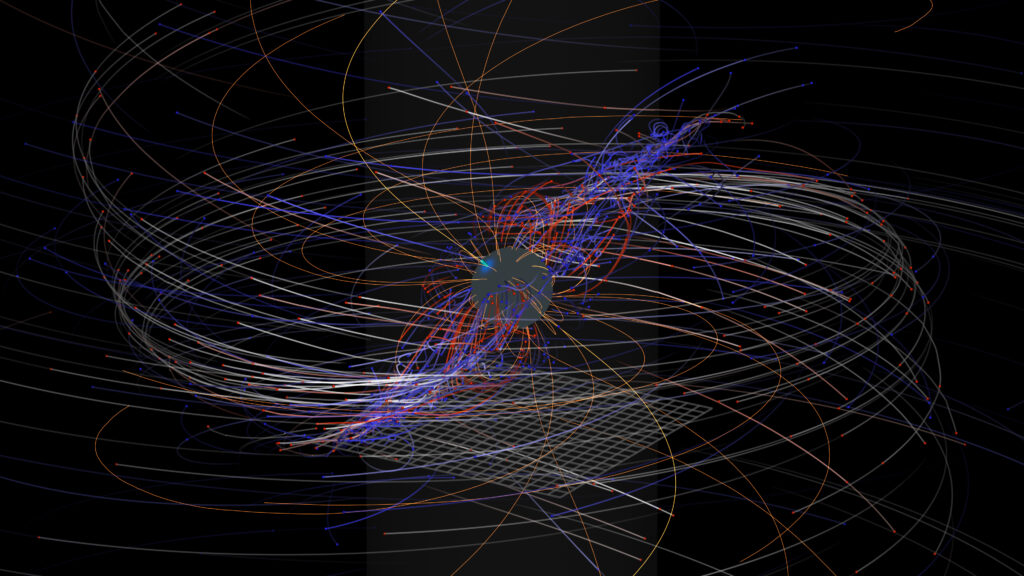

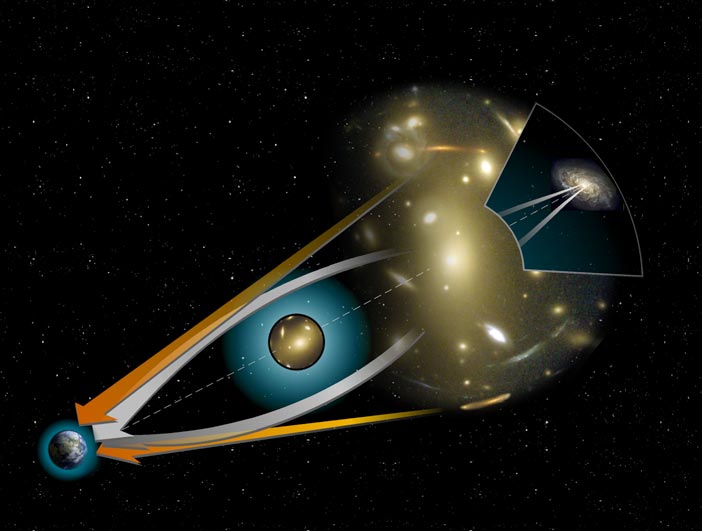

La même année, deux astronomes américains, Peter Goldreich et William Julian, publiaient un article où l’hypothèse de Pacini d’une étoile à neutrons entourée de vide était contestée, sans revenir pour autant sur la validité de ses conclusions. Lorsque de la matière conductrice comme la surface d’une étoile à neutrons ou son éventuelle atmosphère tourne dans un champ magnétique, des champs électriques se développent. C’est un résultat bien connu des spécialistes d’électromagnétisme. Goldreich et Julian calculaient pour les pulsars des champs électriques si forts, que forcément des particules électriquement chargées (comme des électrons ou des ions) doivent être arrachées de l’étoile, formant ainsi un plasma. Ils prouvaient même qu’en l’absence d’atmosphère, les forces électriques auraient été un million de fois plus fortes que la gravitation énorme de l’étoile. Donc, il devait y avoir une atmosphère, et vu la température de l’étoile, elle ne pouvait contenir que de la matière ionisée : électrons, ions et autres particules électriquement chargées. Un gaz composé de matière ionisée est appelé un « plasma ». Ainsi, l’étoile à neutrons était dotée d’un champ magnétique très intense, dans lequel circule un plasma. Un tel environnement a un nom : c’est une « magnétosphère ». Des magnétosphères existent au voisinage de nombreuses planètes, dont la Terre, et d’étoiles [7]. Cependant, la magnétosphère des pulsars a une importante différence avec celle des planètes et des étoiles standard : le plasma qui la constitue n’est pas neutre. Autrement dit, dans un petit volume autour d’une étoile à neutrons, le nombre de charges électriques négatives et le nombre de charges électriques positives sont inégaux. Un calcul simple montrait même quelle devait être la densité de charges électriques résultante près de l’étoile au voisinage des pôles : on atteignait l’équivalent de 1012 fois la charge d’un électron par centimètre cube. Cela était en cohérence avec l’existence des champs électriques très forts.

Ces travaux et des centaines d’autres qui allaient suivre durant les décennies à venir montraient que l’environnement des étoiles à neutrons est un milieu extrêmement énergétique où des particules, en particulier des électrons, arrachées de l’étoile sont accélérées par des champs électriques de l’ordre de 1014 volts par mètre, atteignant en quelques centimètres des vitesses comparables à la vitesse de la lumière. On étudia les processus de rayonnement de ces particules, et l’on définit un nouveau concept : le « rayonnement de synchro-courbure » que l’on ne rencontre que là (et peut-être au voisinage de trous noirs). Ce rayonnement est causé par des particules de très haute énergie se propageant le long des lignes de champ magnétique. Ce rayonnement est essentiellement dans la gamme d’énergie des rayons gamma. On chercha donc à détecter les pulsars avec des télescopes gamma. Mais avant même les observations en rayonnement gamma (qui viendront dans les années 2000), l’astrophysicien anglais Peter Sturrock montra en 1971 que chaque photon gamma émis par ces particules, en interagissant avec le champ magnétique très puissant de l’étoile, ou avec d’autres photons, devait se transformer en un électron et un anti-électron, aussi appelé « positon ». La conclusion décevante de son article était donc que les rayonnements gamma des étoiles à neutrons seraient en grande partie absorbés par ces créations de paires d’électrons et de positons, donc pas si faciles à observer. Mais la chose formidable était de constater que quelques électrons arrachés très brutalement à l’étoile par des champs électriques extrêmes émettent des rayonnements gamma qui ensuite se transforment en matière (des électrons et des positons). Ces nouveaux électrons et positons sont à leur tour accélérés, ils rayonnent d’autres rayons gamma, ce qui produit encore d’autres paires d’électrons et de positons.

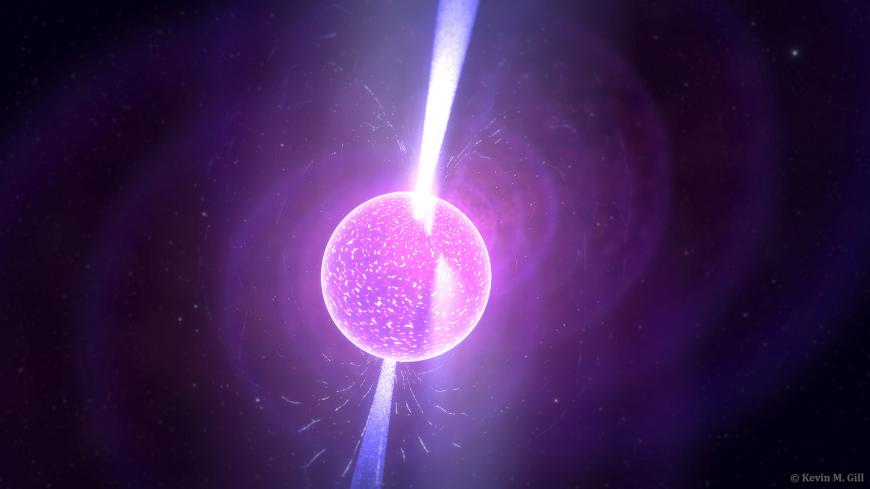

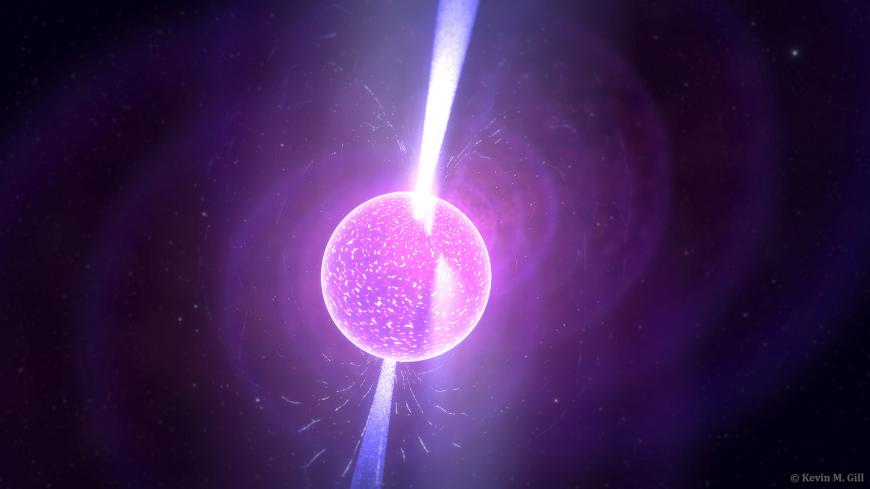

Une étoile à neutrons est un émetteur d’ondes radio. Ces ondes sont émises principalement au voisinage des pôles magnétiques de l’étoile, et dans des directions formant des faisceaux assez étroits. Quand l’étoile tourne, ces faisceaux balayent l’espace, comme le ferait le faisceau d’un phare. Quand nous passons dans le faisceau, nous voyons le signal du pulsar apparaître, et s’éteindre autrement, et cela cause l’aspect pulsé des émissions. Les émissions à d’autres longueurs d’onde (visible, X, gamma) sont également émises dans des faisceaux plus ou moins étroits, et ils montrent également un aspect pulsé périodique.

Des astres morts ?

On estime aujourd’hui qu’un électron (dit « primaire ») arraché à la surface de l’étoile à neutrons produit ainsi environ 100 000 autres électrons et positons (dits « secondaires »).

Normalement, lorsqu’un électron et un positon se rencontrent, ils peuvent s’annihiler et se transformer à nouveau en rayon gamma. C’est ce qu’on appelle la recombinaison. Mais pour que celle-ci ait lieu, il faut que les particules aient le temps d’interagir, car cette opération n’est pas instantanée. Or, dans la magnétosphère des pulsars, les champs électriques très forts accélèrent les électrons et les positons à des vitesses opposées très grandes : tout d’abord, deux particules d’une même paire s’écartent, donc elles ne se recombinent pas. Et d’une manière générale, les positons croisant des électrons allant à des vitesses très différentes, ils se « voient » très brièvement, ils n’ont pas le temps d’interagir, ils ne se recombinent pas.

Ainsi, la magnétosphère d’un pulsar est une véritable source de matière. Une partie retombe sur l’étoile à neutrons (et là, la recombinaison peut se produire), mais une autre partie du plasma est envoyée dans l’espace, constituant un vent formé d’électrons et de positons. Ce vent se propage quasiment à la vitesse de la lumière [8].

De plus, si les rayons gamma produits près de l’étoile sont effectivement absorbés par ce processus, comme prévu par Sturrock, d’autres rayons gamma et X sont produits plus loin, notamment dans ce vent ultra-rapide… Et aujourd’hui, on peut les observer, notamment avec des instruments comme le télescope X Nicer à bord de la Station spatiale internationale, le télescope gamma du satellite Fermi, et les télescopes à effet Tcherenkov.

Si un astre est « vivant » tant qu’il rayonne, il est clair que la « vie » d’une étoile très massive ne cesse pas au moment de la supernova. S’il reste une étoile à neutrons, la « vie » continue. Mais combien de temps ?

Pour répondre à cette question, il faut faire un bilan des puissances rayonnées. Le rayonnement vient principalement de la magnétosphère, et pas de l’étoile. La magnétosphère fonctionne grâce à un champ magnétique très fort et à une rotation rapide de l’étoile. Mais dans l’étoile à neutrons, le champ magnétique n’est pas produit dynamiquement, comme avec une dynamo. C’est un champ magnétique rémanent, comme celui d’un aimant en acier, même si les processus de rémanence, liés à des phénomènes de supraconductivité, sont différents. Donc, petit à petit, ce champ magnétique diminue.

En outre, comme nous l’avons vu, la magnétosphère, en tournant, se comporte comme une antenne émettant une onde à très basse fréquence qui rayonne, c’est-à-dire qu’elle envoie de l’énergie vers l’extérieur, et cela cause le ralentissement progressif de la rotation. Toute la dynamique de la magnétosphère (le rayonnement X et gamma, la création de matière et l’accélération du vent de pulsar) est alimentée en énergie par la rotation de l’étoile.

Ainsi, en quelques millions d’années, le pulsar s’épuise. La champ magnétique devenant trop faible (104 à 106 T), la rotation devenant trop lente (une période de quelques secondes), la machinerie s’éteint. L’étoile à neutrons existe toujours, mais elle n’alimente plus une magnétosphère assez dynamique pour produire un pulsar. Alors, les spécialistes des étoiles à neutrons reprennent à leur compte la notion de « vie d’une étoile » et déclarent la « mort » du pulsar. Pour désigner le domaine de paramètres caractérisant les étoiles à neutrons trop lentes et trop peu magnétisées pour former un pulsar, les astronomes parlent même de « cimetière ».

Cependant, il arrive que cette mort ne soit pas définitive… ce qui est tout de même atypique ! Pourvu qu’un pulsar fasse partie d’un système d’étoiles doubles, il se peut que la compagne, en perdant de la matière qui tombe sur l’étoile à neutrons, ravive l’activité de ce pulsar qu’on croyait mort. On parle alors de pulsars recyclés. On les distingue des pulsars standard, car ils ont un champ magnétique faible (de l’ordre de 104 à 106 T tout de même), mais ils tournent très vite, avec une période typique de 10 millisecondes. Ceux-là peuvent alors être actifs durant des centaines de millions d’années, excédant largement la durée durant laquelle leur étoile progénitrice a brillé dans sa phase d’étoile de la séquence principale puis de géante.

Simulation numérique de l’environnement d’une étoile à neutrons. L’étoile, d’un rayon de l’ordre de 12 km, est représentée par la sphère bleutée. Son environnement comprend un grand nombre d’électrons et de positons qui ont été créés lors d’interactions entre le rayonnement gamma émis par les particules préexistantes de haute énergie et le champ magnétique, ou entre le rayonnement des particules de haute énergie et le rayonnement thermique de l’étoile (rayonnement de corps noir, ici principalement des rayons X). Sur l’image, un pôle magnétique est représenté en bleu vif sur la sphère. Les lignes représentent des trajectoires d’électrons de faible énergie (en bleu) et de positons de faible énergie (en rouge) ainsi que des électrons et positons de haute énergie (en blanc). Ce sont les particules de haute énergie qui émettent des rayons gamma, eux-mêmes capables de créer de nouvelles paires électron-positon. (Gabrielle Brambilla, université de Milan, Italie, et NASA’s Scientific Visualization Studio)

50 ans de physique des pulsars